La task force ChatGPT sarà istituita dall’Europa

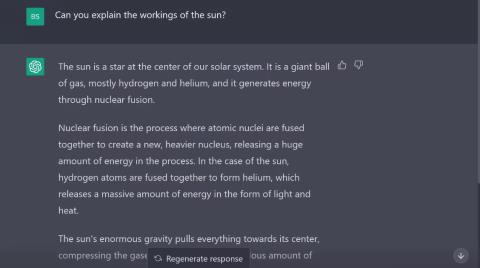

L'organismo che unisce i supervisori nazionali della privacy europei ha dichiarato giovedì di aver istituito una task force dedicata a ChatGPT

L’Unione Europea ha pubblicato oggi ufficialmente una serie di documenti guida su come le imprese e i governi dovrebbero seguire nello sviluppo e nell’implementazione dei loro progetti di intelligenza artificiale in modo che siano veramente trasparenti, giusti ed “etici”.

Questo mi ricorda improvvisamente una legge chiamata Tre Leggi della Robotica menzionata dallo scrittore russo Isaac Asimov nella raccolta di racconti "Runaround" composta nel 1942, qualcosa come la prima: un robot non può danneggiare gli esseri umani o ignorare i pericoli che affrontano gli esseri umani. Articolo 2: Un robot deve obbedire assolutamente agli ordini impartiti dagli esseri umani a meno che questi ordini non contrastino con la prima legge. E terzo: un robot deve proteggersi, a condizione che tale protezione non sia in conflitto con la prima e la seconda legge. Sebbene si tratti solo di un insieme di regole di "finzione" apparse quasi 80 anni fa, è ancora particolarmente attuale quando le persone stanno gradualmente entrando nell'attuale era dell'intelligenza artificiale. Naturalmente, la nuova serie di regole emanate dall’UE non sarà fondamentalmente la stessa della legge “Le tre leggi della robotica” di Isaac Asimov. I legislatori europei non possono fornire un quadro etico flessibile che ci aiuti a affrontare grandi questioni come fermare i robot assassini. Invece, i documenti guida dell’UE aiutano ad affrontare problemi “oscuri e pervasivi” che hanno un impatto negativo sulla società mentre integriamo l’intelligenza artificiale in molti ambiti importanti della nostra vita, come l’assistenza sanitaria, l’istruzione e la tecnologia di consumo.

Per fare un semplice esempio, se un sistema di IA medica diagnosticasse una persona ad alto rischio di sviluppare il cancro in futuro, le linee guida dell’UE contribuiranno a garantire che alcune delle seguenti operazioni debbano essere eseguite: il software non sia distorto o distorto dalle opinioni del paziente razza o sesso, e allo stesso tempo fornire le informazioni più chiare e trasparenti sulla propria condizione medica, e soprattutto non devono interferire o ostacolare le decisioni del medico.

Quindi, sì, queste linee guida si concentrano principalmente sulla limitazione e sul controllo dei modelli di intelligenza artificiale affinché funzionino correttamente, ma solo a livello amministrativo e burocratico, piuttosto che prevenire atti di omicidio secondo l'immaginazione dello scrittore Asimov.

Per produrre questa serie di documenti guida, l’UE ha dovuto convocare un gruppo di 52 esperti, chiedendo loro di discutere, concordare e presentare 7 requisiti che secondo loro i futuri sistemi di intelligenza artificiale dovrebbero essere in grado di rispondere. Tali requisiti sono i seguenti:

Probabilmente noterai che alcune delle affermazioni di cui sopra sono piuttosto astratte e sarebbero difficili da valutare in senso oggettivo (ad esempio, la definizione di cambiamento sociale positivo apportato dall'intelligenza artificiale varierà notevolmente da persona a persona e, più in generale, da un paese all'altro). ). Tuttavia, la maggior parte delle restanti voci sono generalmente più semplici e possono essere controllate e garantite attraverso il controllo delle autorità. Ad esempio, la condivisione dei dati utilizzati per addestrare i sistemi di intelligenza artificiale governativa potrebbe essere un buon modo per combattere algoritmi distorti e opachi.

Le disposizioni di questi documenti guida dell’UE non sono chiaramente giuridicamente vincolanti, ma potrebbero essere utilizzate per modellare qualsiasi futura legislazione elaborata dall’Unione Europea contenente informazioni relative al campo dell’IA. In passato, l’UE ha ripetutamente affermato di voler fare dell’Europa un pioniere nel mondo nell’implementazione di modelli di intelligenza artificiale “etici” e nel lancio di una serie di documenti guida. Ciò dimostra chiaramente che sono pronti a elaborare leggi di vasta portata regolamentazione e tutela dei diritti digitali.

L’UE vuole dare forma a un’industria dell’intelligenza artificiale con al centro standard etici

Nell’ambito degli sforzi per creare un’industria dell’IA “etica”, il documento orientativo dell’UE potrebbe essere visto come un trampolino di lancio verso la creazione di un “elenco di valutazione dell’IA affidabile” – un elenco di termini che può aiutare gli esperti a individuare eventuali punti deboli o potenziali pericoli in un’IA software anche se è stato ampiamente distribuito. Questo elenco può includere domande come: "Puoi dimostrare come funziona il tuo sistema di intelligenza artificiale in situazioni e ambienti complessi?", o "Puoi valutare il tipo e la portata dei dati nel tuo set di dati?" ...

Naturalmente questa lista di valutazione è solo preliminare, l’UE dovrà comunque raccogliere feedback da aziende ed esperti di intelligenza artificiale nel prossimo futuro. Già nel 2020 l’UE pubblicherà un rapporto di sintesi su questo tema.

Anny Hidvégi, policy manager del gruppo per i diritti digitali Access Now e una dei 52 esperti responsabili della stesura dei documenti guida dell'UE, ha affermato che l'elenco di valutazione è la parte fondamentale. Il punto più importante del rapporto: "Questo insieme di documenti aiuta a fornire un quadro pratico , una prospettiva lungimirante su come prevenire e ridurre al minimo i potenziali danni dell'intelligenza artificiale."

“A nostro avviso, l’UE ha abbastanza potenziale e responsabilità per diventare un’organizzazione leader in questo lavoro. Ma oltre a ciò, riteniamo anche che l’Unione europea non debba fermarsi ai principi morali. Dovrebbero prendere in considerazione la possibilità di richiedere alle società minerarie basate sull’intelligenza artificiale di rispettare la legge in futuro”, ha aggiunto Hidvégi.

Altri sono scettici sul fatto che il tentativo dell’UE di modellare il modo in cui l’intelligenza artificiale globale verrà sviluppata attraverso la ricerca etica avrà molto effetto.

“Siamo scettici sull'approccio adottato dalla principale organizzazione europea. L’idea che creando un gold standard per i sistemi etici di IA, l’UE sarà in grado di ritagliarsi un posto nello sviluppo del settore globale dell’IA è relativamente inverosimile. Per diventare leader nella definizione di regole etiche sull’IA, l’UE deve prima diventare leader nel campo dell’IA nel suo complesso”, ha affermato Eline Ch Pivot, analista politico senior presso lo European Data Innovation Center.

Cosa ne pensi di questo argomento? Per favore lascia i tuoi commenti nella sezione commenti qui sotto!

L'organismo che unisce i supervisori nazionali della privacy europei ha dichiarato giovedì di aver istituito una task force dedicata a ChatGPT

Scienziati danesi e americani hanno collaborato per sviluppare un sistema di intelligenza artificiale chiamato life2vec, in grado di prevedere l’ora della morte umana con elevata precisione.

Un algoritmo AI chiamato Audioflow può ascoltare il suono della minzione per identificare in modo efficace e con successo flussi anomali e corrispondenti problemi di salute del paziente.

L'invecchiamento e il calo della popolazione giapponese hanno lasciato il paese privo di un numero significativo di giovani lavoratori, soprattutto nel settore dei servizi.

Un utente Reddit di nome u/LegalBeagle1966 è uno dei tanti utenti innamorati di Claudia, una ragazza simile a una star del cinema che spesso condivide selfie seducenti, anche nudi, su questa piattaforma.

Microsoft ha appena annunciato che altre 12 aziende tecnologiche parteciperanno al suo programma AI for Good.

L'utente @mortecouille92 ha messo a frutto la potenza dello strumento di progettazione grafica Midjourney e ha creato versioni realistiche uniche di famosi personaggi di Dragon Ball come Goku, Vegeta, Bulma e l'anziano Kame. .

Semplicemente aggiungendo alcune condizioni o impostando alcuni scenari, ChatGPT può fornire risposte più pertinenti alle tue domande. Diamo un'occhiata ad alcuni modi in cui puoi migliorare la qualità delle tue risposte ChatGPT.

Midjourney è un sistema di intelligenza artificiale che recentemente ha causato "febbre" nella comunità online e nel mondo degli artisti a causa dei suoi dipinti estremamente belli che non sono inferiori a quelli dei veri artisti.

Alcuni giorni dopo l’annuncio dell’epidemia da parte della Cina, con l’accesso ai dati globali sulle vendite di biglietti aerei, il sistema di intelligenza artificiale di BlueDot ha continuato a prevedere con precisione la diffusione del virus Corona di Wuhan a Bangkok, Seul, Taipei e Tokyo.