La task force ChatGPT sarà istituita dall’Europa

L'organismo che unisce i supervisori nazionali della privacy europei ha dichiarato giovedì di aver istituito una task force dedicata a ChatGPT

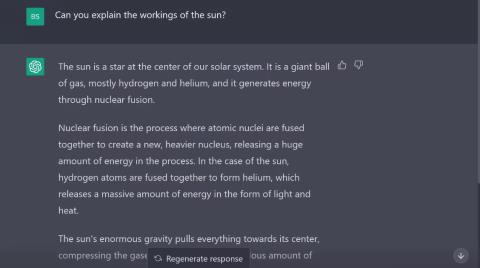

La popolarità dei chatbot IA è aumentata. Sebbene le loro capacità siano impressionanti, è importante riconoscere che i chatbot non sono perfetti. Esistono rischi intrinseci associati all’utilizzo dei chatbot basati sull’intelligenza artificiale, come problemi di privacy e potenziali attacchi informatici. È importante prestare attenzione quando si interagisce con i chatbot.

Esploriamo i potenziali rischi della condivisione di informazioni con i chatbot IA e vediamo quali tipi di informazioni non dovrebbero essere loro divulgate. Per garantire la tua privacy e sicurezza, è essenziale prestare attenzione alle seguenti 5 cose quando si interagisce con i chatbot AI.

1. Dettagli finanziari

I criminali informatici possono utilizzare chatbot IA come ChatGPT per hackerare il tuo conto bancario? Con l’uso diffuso dei chatbot basati sull’intelligenza artificiale, molti utenti si sono rivolti a questi modelli linguistici per ricevere consulenza e gestione finanziaria personale. Sebbene possano aumentare l’alfabetizzazione finanziaria, è importante conoscere i potenziali rischi derivanti dalla condivisione di informazioni finanziarie con i chatbot basati sull’intelligenza artificiale.

Quando utilizzi un chatbot come consulente finanziario, rischi di esporre le tue informazioni finanziarie a potenziali criminali informatici che potrebbero sfruttare tali informazioni per prelevare denaro dai tuoi conti. Sebbene le aziende affermino di rendere anonimi i dati delle conversazioni, terze parti e alcuni dipendenti potrebbero comunque avere accesso a tali dati. Ciò solleva preoccupazioni sulla profilazione, in cui i tuoi dati finanziari potrebbero essere utilizzati per scopi dannosi come campagne di ransomware o venduti ad agenzie di marketing.

Per proteggere le tue informazioni finanziarie dai chatbot AI, devi essere consapevole di ciò che condividi con questi modelli di AI generativa . Le tue interazioni dovrebbero limitarsi alla raccolta di informazioni generali e al porre domande generali. Se hai bisogno di una consulenza finanziaria personalizzata, potrebbero esserci opzioni migliori che affidarsi esclusivamente ai robot IA. Possono fornire informazioni inesatte o fuorvianti, mettendo potenzialmente a rischio i tuoi sudati guadagni. Valuta invece la possibilità di chiedere consiglio a un consulente finanziario in grado di fornire una guida adeguata e affidabile.

2. I tuoi pensieri personali e intimi

Molti utenti si rivolgono ai chatbot basati sull’intelligenza artificiale per cercare una terapia senza conoscere le potenziali conseguenze per la loro salute mentale. Comprendere i pericoli derivanti dalla rivelazione di informazioni personali e riservate a questi chatbot è essenziale.

Innanzitutto, i chatbot mancano di conoscenze pratiche e possono solo dare risposte generali a domande relative alla salute mentale. Ciò significa che i farmaci o i trattamenti consigliati potrebbero non essere adatti alle tue esigenze specifiche e potrebbero essere dannosi per la salute.

Inoltre, la condivisione di pensieri personali con i chatbot basati sull’intelligenza artificiale solleva problemi di privacy. La tua privacy può essere violata poiché segreti e pensieri intimi possono essere divulgati online. Individui malintenzionati potrebbero sfruttare queste informazioni per spiarti o vendere i tuoi dati nel dark web . Pertanto, proteggere la privacy dei pensieri personali quando si interagisce con i chatbot AI è estremamente importante.

È importante avvicinarsi ai chatbot basati sull’intelligenza artificiale come uno strumento di informazione e supporto generale piuttosto che vederli come opzioni alternative per la terapia professionale. Se hai bisogno di consulenza o trattamento sulla salute mentale, dovresti sempre consultare un professionista sanitario qualificato. Possono fornire una guida personalizzata e affidabile dando priorità alla tua privacy e al tuo benessere.

3. Informazioni riservate sul vostro posto di lavoro

Un altro errore che gli utenti devono evitare quando interagiscono con i chatbot AI è condividere informazioni riservate relative al lavoro. Persino famosi giganti della tecnologia come Apple, Samsung, JPMorgan e Google, il creatore di Bard, hanno vietato ai propri dipendenti di utilizzare chatbot AI al lavoro .

Un rapporto di Bloomberg ha evidenziato il caso di dipendenti Samsung che utilizzano ChatGPT per programmare e caricano accidentalmente codice sensibile sulla piattaforma di intelligenza artificiale generativa. Questo incidente ha comportato la divulgazione non autorizzata di informazioni riservate su Samsung, costringendo la società a imporre un divieto sull’uso dei chatbot IA. Come sviluppatore che cerca supporto AI per risolvere problemi di programmazione, ecco perché non dovresti fidarti dei chatbot AI come ChatGPT con informazioni riservate. È essenziale essere cauti quando si condividono codici sensibili o dettagli relativi al lavoro.

Allo stesso modo, molti dipendenti si affidano ai chatbot basati sull’intelligenza artificiale per riassumere i verbali delle riunioni o automatizzare le attività ripetitive, correndo il rischio di esporre accidentalmente dati sensibili. Pertanto, è estremamente importante mantenere la privacy delle informazioni lavorative riservate e limitarne la condivisione con i chatbot basati sull’intelligenza artificiale.

Gli utenti possono proteggere le proprie informazioni sensibili e la propria organizzazione da fughe o violazioni involontarie di dati prestando attenzione ai rischi associati alla condivisione dei dati legati al lavoro.

4. Parola d'ordine

È importante sottolineare che condividere le proprie password online, anche con modelli linguistici, è assolutamente vietato. Questi modelli memorizzano i tuoi dati su server pubblici e rivelare loro la tua password mette in pericolo la tua privacy. In caso di violazione del server, gli hacker possono accedere e sfruttare le tue password per causare danni finanziari.

Nel maggio 2022 si è verificata una grave violazione dei dati che ha coinvolto ChatGPT, sollevando serie preoccupazioni sulla sicurezza della piattaforma chatbot. Inoltre, ChatGPT è stato bandito in Italia a causa del Regolamento generale sulla protezione dei dati (GDPR) dell'Unione Europea. Le autorità di regolamentazione italiane affermano che i chatbot basati sull’intelligenza artificiale non rispettano le leggi sulla privacy, evidenziando i rischi di violazione dei dati sulla piattaforma. Pertanto, proteggere le tue credenziali dai chatbot AI diventa fondamentale.

Limitando la condivisione delle tue password con questi modelli di chatbot, puoi proteggere in modo proattivo le tue informazioni personali e ridurre le possibilità di cadere vittima di minacce informatiche. Ricorda, proteggere le tue informazioni di accesso è un passaggio essenziale per mantenere la tua privacy e sicurezza online.

5. Dati abitativi e altri dati personali

È importante non condividere informazioni di identificazione personale (PII) con i chatbot AI. Le PII includono dati sensibili che possono essere utilizzati per identificarti o localizzarti, inclusa la tua posizione, il numero di previdenza sociale, la data di nascita e le informazioni sanitarie. Garantire la privacy dei dettagli personali e residenziali quando si interagisce con i chatbot AI è una priorità assoluta.

Per mantenere la privacy dei tuoi dati personali quando interagisci con i chatbot AI, ecco alcune pratiche chiave da seguire:

L'organismo che unisce i supervisori nazionali della privacy europei ha dichiarato giovedì di aver istituito una task force dedicata a ChatGPT

Scienziati danesi e americani hanno collaborato per sviluppare un sistema di intelligenza artificiale chiamato life2vec, in grado di prevedere l’ora della morte umana con elevata precisione.

Un algoritmo AI chiamato Audioflow può ascoltare il suono della minzione per identificare in modo efficace e con successo flussi anomali e corrispondenti problemi di salute del paziente.

L'invecchiamento e il calo della popolazione giapponese hanno lasciato il paese privo di un numero significativo di giovani lavoratori, soprattutto nel settore dei servizi.

Un utente Reddit di nome u/LegalBeagle1966 è uno dei tanti utenti innamorati di Claudia, una ragazza simile a una star del cinema che spesso condivide selfie seducenti, anche nudi, su questa piattaforma.

Microsoft ha appena annunciato che altre 12 aziende tecnologiche parteciperanno al suo programma AI for Good.

L'utente @mortecouille92 ha messo a frutto la potenza dello strumento di progettazione grafica Midjourney e ha creato versioni realistiche uniche di famosi personaggi di Dragon Ball come Goku, Vegeta, Bulma e l'anziano Kame. .

Semplicemente aggiungendo alcune condizioni o impostando alcuni scenari, ChatGPT può fornire risposte più pertinenti alle tue domande. Diamo un'occhiata ad alcuni modi in cui puoi migliorare la qualità delle tue risposte ChatGPT.

Midjourney è un sistema di intelligenza artificiale che recentemente ha causato "febbre" nella comunità online e nel mondo degli artisti a causa dei suoi dipinti estremamente belli che non sono inferiori a quelli dei veri artisti.

Alcuni giorni dopo l’annuncio dell’epidemia da parte della Cina, con l’accesso ai dati globali sulle vendite di biglietti aerei, il sistema di intelligenza artificiale di BlueDot ha continuato a prevedere con precisione la diffusione del virus Corona di Wuhan a Bangkok, Seul, Taipei e Tokyo.