La task force ChatGPT sarà istituita dall’Europa

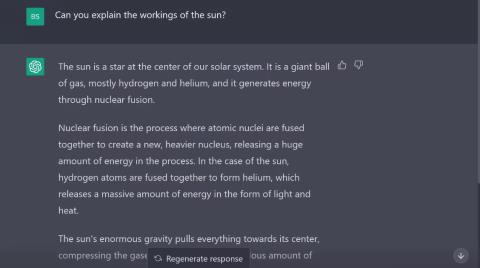

L'organismo che unisce i supervisori nazionali della privacy europei ha dichiarato giovedì di aver istituito una task force dedicata a ChatGPT

Nonostante le impressionanti capacità di ChatGPT , diverse grandi aziende hanno vietato ai propri dipendenti di utilizzare questo chatbot AI.

Nel maggio 2023, Samsung ha vietato l'uso di ChatGPT e altri strumenti di intelligenza artificiale generativa . Poi, nel giugno 2023, anche la Commonwealth Bank australiana, insieme ad aziende come Amazon, Apple e JPMorgan Chase & Co, hanno implementato la restrizione. Anche alcuni ospedali, studi legali e agenzie governative hanno vietato ai dipendenti di utilizzare ChatGPT.

Allora perché sempre più aziende vietano ChatGPT? Ecco 5 ragioni principali.

1. Perdita di dati

ChatGPT richiede una grande quantità di dati per addestrarsi e funzionare in modo efficace. Il chatbot è stato addestrato utilizzando enormi quantità di dati ottenuti da Internet e continuerà ad essere addestrato.

Secondo la pagina di aiuto di OpenAI, ogni dato, inclusi i dettagli riservati dei clienti, i segreti commerciali e le informazioni aziendali sensibili, che fornisci al chatbot può essere esaminato e utilizzato per migliorare il sistema.

Configura l'autenticazione a più fattori su ChatGPT

Molte aziende sono soggette a rigide norme sulla protezione dei dati. Pertanto, sono cauti nel condividere i dati personali con entità esterne, poiché ciò aumenta il rischio di fuga di dati.

Inoltre, OpenAI non fornisce alcuna garanzia di perfetta sicurezza e protezione dei dati. Nel marzo 2023 OpenAI ha confermato un bug che consentiva ad alcuni utenti di visualizzare i titoli delle chat nella cronologia di altri utenti attivi. Sebbene questo bug sia stato corretto e OpenAI abbia lanciato un programma bug bounty, l'azienda non garantisce la sicurezza e la privacy dei dati degli utenti.

Molte organizzazioni scelgono di limitare l’utilizzo di ChatGPT da parte dei dipendenti per evitare violazioni dei dati, che possono danneggiare la reputazione, portare a perdite finanziarie e mettere a rischio i propri clienti e dipendenti.

2. Rischi per la sicurezza informatica

Sebbene non sia chiaro se ChatGPT sia effettivamente esposto a rischi per la sicurezza informatica, è possibile che la sua implementazione all’interno di un’organizzazione possa creare potenziali vulnerabilità che potrebbero essere sfruttate dagli aggressori informatici.

Se un'azienda integra ChatGPT e si riscontra un punto debole nel sistema di sicurezza del chatbot, gli aggressori possono sfruttare la vulnerabilità e infettarlo con malware. Inoltre, la capacità di ChatGPT di generare risposte simili a quelle umane è un "uovo d'oro" per gli aggressori di phishing, che possono impossessarsi di account o impersonare entità legittime per indurre i dipendenti dell'azienda a condividere informazioni sensibili.

3. Crea chatbot personalizzati

Nonostante le sue caratteristiche innovative, ChatGPT può creare informazioni false e fuorvianti. Pertanto, molte aziende hanno creato chatbot AI per scopi lavorativi. Ad esempio, la Commonwealth Bank australiana ha chiesto al proprio personale di utilizzare Gen.ai, un chatbot di intelligenza artificiale (AI) che utilizza le informazioni di CommBank per fornire risposte.

Aziende come Samsung e Amazon hanno sviluppato modelli avanzati di linguaggio naturale, in modo che le aziende possano facilmente creare e distribuire chatbot personalizzati basati sulle trascrizioni esistenti. Con questi chatbot interni puoi prevenire conseguenze legali e reputazionali associate alla cattiva gestione dei dati.

4. Mancanza di normative

Nei settori in cui le aziende sono soggette a protocolli e sanzioni, la mancanza di una guida normativa da parte di ChatGPT è un segnale di allarme. Senza precise condizioni legali che regolano l’uso di ChatGPT, le aziende potrebbero dover affrontare gravi conseguenze legali quando utilizzano chatbot IA per le loro operazioni.

Inoltre, la mancanza di regolamentazione può ridurre la responsabilità e la trasparenza delle imprese. Può creare confusione per la maggior parte delle aziende spiegare ai propri clienti i processi decisionali e le misure di sicurezza del modello linguistico dell’intelligenza artificiale.

Le aziende stanno limitando ChatGPT a causa delle preoccupazioni sulla potenziale violazione delle leggi sulla privacy e delle normative specifiche del settore.

5. Utilizzo irresponsabile da parte dei dipendenti

In molte aziende, alcuni dipendenti si affidano esclusivamente alle risposte ChatGPT per creare contenuti ed eseguire le proprie attività. Ciò crea pigrizia nell’ambiente di lavoro e soffoca la creatività e l’innovazione.

Affidarsi all’intelligenza artificiale può ostacolare la tua capacità di pensare in modo critico. Può anche danneggiare la reputazione di un'azienda perché ChatGPT fornisce spesso dati imprecisi e inaffidabili.

Sebbene ChatGPT sia uno strumento potente, utilizzarlo per risolvere query complesse che richiedono competenze specifiche del dominio può danneggiare le operazioni e l'efficienza di un'azienda. Alcuni dipendenti potrebbero non ricordarsi di verificare e verificare le risposte fornite dai chatbot AI, considerando quelle fornite da ChatGPT come una soluzione unica per tutti.

Per mitigare problemi come questi, le aziende stanno vietando i chatbot in modo che i dipendenti possano concentrarsi sui propri compiti e fornire soluzioni prive di errori agli utenti.

L'organismo che unisce i supervisori nazionali della privacy europei ha dichiarato giovedì di aver istituito una task force dedicata a ChatGPT

Scienziati danesi e americani hanno collaborato per sviluppare un sistema di intelligenza artificiale chiamato life2vec, in grado di prevedere l’ora della morte umana con elevata precisione.

Un algoritmo AI chiamato Audioflow può ascoltare il suono della minzione per identificare in modo efficace e con successo flussi anomali e corrispondenti problemi di salute del paziente.

L'invecchiamento e il calo della popolazione giapponese hanno lasciato il paese privo di un numero significativo di giovani lavoratori, soprattutto nel settore dei servizi.

Un utente Reddit di nome u/LegalBeagle1966 è uno dei tanti utenti innamorati di Claudia, una ragazza simile a una star del cinema che spesso condivide selfie seducenti, anche nudi, su questa piattaforma.

Microsoft ha appena annunciato che altre 12 aziende tecnologiche parteciperanno al suo programma AI for Good.

L'utente @mortecouille92 ha messo a frutto la potenza dello strumento di progettazione grafica Midjourney e ha creato versioni realistiche uniche di famosi personaggi di Dragon Ball come Goku, Vegeta, Bulma e l'anziano Kame. .

Semplicemente aggiungendo alcune condizioni o impostando alcuni scenari, ChatGPT può fornire risposte più pertinenti alle tue domande. Diamo un'occhiata ad alcuni modi in cui puoi migliorare la qualità delle tue risposte ChatGPT.

Midjourney è un sistema di intelligenza artificiale che recentemente ha causato "febbre" nella comunità online e nel mondo degli artisti a causa dei suoi dipinti estremamente belli che non sono inferiori a quelli dei veri artisti.

Alcuni giorni dopo l’annuncio dell’epidemia da parte della Cina, con l’accesso ai dati globali sulle vendite di biglietti aerei, il sistema di intelligenza artificiale di BlueDot ha continuato a prevedere con precisione la diffusione del virus Corona di Wuhan a Bangkok, Seul, Taipei e Tokyo.