La task force ChatGPT sarà istituita dall’Europa

L'organismo che unisce i supervisori nazionali della privacy europei ha dichiarato giovedì di aver istituito una task force dedicata a ChatGPT

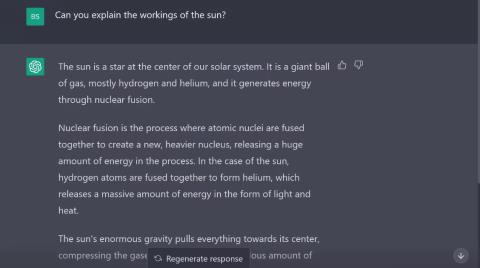

ChatGPT e altre tecnologie per l'apprendimento delle lingue sono emerse come strumenti potenti e stanno appena iniziando ad avere un impatto su settori come quello sanitario. Tuttavia, è importante prestare attenzione quando si utilizzano questi strumenti per quanto riguarda la propria salute. Sebbene il loro potenziale sia promettente, è essenziale comprendere i limiti e i rischi associati a queste tecnologie. Ecco come ChatGPT e sistemi simili di intelligenza artificiale generativa possono influire sulla tua salute.

1. Preoccupazioni sull’intelligenza artificiale

Sebbene il termine “ansia da intelligenza artificiale” sia in circolazione ormai da diversi anni, secondo il Journal of the Association for Information Science and Technology, il rapido ritmo di sviluppo dell’IA continua a preoccupare molte persone.

Fortunatamente, ci sono modi per superare l’ansia relativa all’IA rimanendo al passo con i rapidi sviluppi della tecnologia. Ad esempio, informarsi sui chatbot e incorporare un po’ di intelligenza artificiale nella propria vita può aiutare a rimuovere molti dei suoi misteri, secondo Everyday Health.

Per molte persone, l’incognita è parte di ciò che rende la rapida ascesa dell’intelligenza artificiale così inquietante, quindi familiarizzare con le nozioni di base è un buon punto di partenza. Anche se può sembrare un po' controintuitivo, sperimentare con Bard o ChatGPT può aiutare a rendere l'app complessivamente più accessibile.

2. Informazioni sanitarie imprecise

Il modo in cui modelli come ChatGPT rispondono alle richieste fa sembrare che sappiano tutto. Tuttavia, è importante prestare attenzione alle risposte, soprattutto quando si tratta di domande sulla salute.

Sebbene in alcuni casi ChatGPT possa fornire informazioni sanitarie affidabili, l'app può comunque causare allucinazioni e fornire consigli sanitari imprecisi. È probabile che non ti fidi che i risultati di ricerca di Google forniscano dati sanitari accurati e personalizzati, quindi è saggio avvicinarsi alla tecnologia AI con tale cautela.

Se hai domande serie sulla tua salute, è meglio sottoporre queste domande al tuo medico. Inoltre, è probabile che gli operatori sanitari prendano in considerazione molti fattori, tra cui la storia medica, i sintomi e la salute generale. I modelli di intelligenza artificiale potrebbero non essere in grado di gestire tutti questi fattori nella stessa misura (almeno non completamente).

Quindi prendi il suggerimento e contatta il tuo medico per problemi di salute. Anche il miglior modello linguistico non può fornire diagnosi personalizzate.

3. Aumenta il comportamento di dipendenza dalla tecnologia

La dipendenza dalla tecnologia è già una preoccupazione. In particolare, negli ultimi anni è aumentata rapidamente la dipendenza dai social network e dagli smartphone. Per molte persone, queste tecnologie che creano abitudini sono difficili da interrompere e le persone online segnalano in modo informale sentimenti di dipendenza da ChatGPT e applicazioni AI simili.

Secondo gli esperti, secondo il Pew Research Center, la tecnologia dell’intelligenza artificiale peggiorerà il problema della dipendenza digitale nei prossimi anni. "La dipendenza digitale, già un problema per molte persone che giocano ai videogiochi, guardano video di TikTok o YouTube, o che guardano ogni tweet, potrebbe diventare un problema ancora più grande poiché questi canali e altre altre tecnologie digitali sono ancora più personalizzati", Gary Grossman, ha affermato nel rapporto il vicepresidente senior e leader globale del Centro di eccellenza AI di Edelman.

Anche se questo può sembrare negativo, ci sono sicuramente delle misure che puoi adottare per ridurre la tua dipendenza dall’uso di Internet, dell’intelligenza artificiale e della tecnologia in generale.

4. Preoccupazioni relative alla privacy dei dati sanitari

Per molte persone è facile utilizzare risorse come ChatGPT per le domande di tutti i giorni. Ad esempio, la prossima volta che desideri saperne di più su una specifica condizione di salute, puoi rivolgerti a questi chatbot per ottenere una risposta rapida.

Sebbene rapidi e semplici da usare, gli strumenti linguistici dell'intelligenza artificiale potrebbero non proteggere i dati sanitari personali immessi, come avverte l'Organizzazione mondiale della sanità. Fai attenzione se vuoi scrivere promemoria su condizioni di salute sensibili o private.

Parlare con il tuo medico rimane un modo più affidabile e sicuro per affrontare qualsiasi problema di salute. Quando si tratta di informazioni che desideri tenere per te, evita di inserirle nell'intelligenza artificiale.

5. Potenziale di molestie informatiche e bullismo

Sfortunatamente, le nuove tecnologie hanno spesso il potenziale per causare danni. Simili ai robot troll, i modelli linguistici offensivi generati dall’intelligenza artificiale possono generare rapidamente commenti dannosi e molesti. Ciò può causare stress e traumi emotivi alla persona presa di mira.

Poiché i modelli di intelligenza artificiale possono automatizzare questi messaggi crudeli e generarli su larga scala, gli individui possono essere sopraffatti dal gran numero di commenti su più piattaforme. Nessuno vuole avere a che fare con questo tipo di contenuti ogni volta che controlli i social media o invii un'e-mail.

Questo non è un problema nuovo, quindi ci sono modi per proteggersi dal cyberbullismo. Secondo il Cyberbullying Research Center, registrare i messaggi e richiedere supporto all'amministratore del sito Web o alla compagnia telefonica sono ottimi primi passi.

Quasi tutti i siti di social media dispongono già di politiche per gestire questi messaggi di odio da parte dei cyberbulli. Ad esempio, puoi segnalare messaggi fastidiosi a Facebook, segnalare messaggi offensivi a Instagram e contattare il team di moderazione di TikTok. Segnala contenuti, blocca utenti problematici e modifica le impostazioni sulla privacy per ridurre il rischio di cyberbullismo.

L'organismo che unisce i supervisori nazionali della privacy europei ha dichiarato giovedì di aver istituito una task force dedicata a ChatGPT

Scienziati danesi e americani hanno collaborato per sviluppare un sistema di intelligenza artificiale chiamato life2vec, in grado di prevedere l’ora della morte umana con elevata precisione.

Un algoritmo AI chiamato Audioflow può ascoltare il suono della minzione per identificare in modo efficace e con successo flussi anomali e corrispondenti problemi di salute del paziente.

L'invecchiamento e il calo della popolazione giapponese hanno lasciato il paese privo di un numero significativo di giovani lavoratori, soprattutto nel settore dei servizi.

Un utente Reddit di nome u/LegalBeagle1966 è uno dei tanti utenti innamorati di Claudia, una ragazza simile a una star del cinema che spesso condivide selfie seducenti, anche nudi, su questa piattaforma.

Microsoft ha appena annunciato che altre 12 aziende tecnologiche parteciperanno al suo programma AI for Good.

L'utente @mortecouille92 ha messo a frutto la potenza dello strumento di progettazione grafica Midjourney e ha creato versioni realistiche uniche di famosi personaggi di Dragon Ball come Goku, Vegeta, Bulma e l'anziano Kame. .

Semplicemente aggiungendo alcune condizioni o impostando alcuni scenari, ChatGPT può fornire risposte più pertinenti alle tue domande. Diamo un'occhiata ad alcuni modi in cui puoi migliorare la qualità delle tue risposte ChatGPT.

Midjourney è un sistema di intelligenza artificiale che recentemente ha causato "febbre" nella comunità online e nel mondo degli artisti a causa dei suoi dipinti estremamente belli che non sono inferiori a quelli dei veri artisti.

Alcuni giorni dopo l’annuncio dell’epidemia da parte della Cina, con l’accesso ai dati globali sulle vendite di biglietti aerei, il sistema di intelligenza artificiale di BlueDot ha continuato a prevedere con precisione la diffusione del virus Corona di Wuhan a Bangkok, Seul, Taipei e Tokyo.