La task force ChatGPT sarà istituita dall’Europa

L'organismo che unisce i supervisori nazionali della privacy europei ha dichiarato giovedì di aver istituito una task force dedicata a ChatGPT

Man mano che gli esseri umani avanzano verso il futuro, la prospettiva di sistemi guidati dall’intelligenza artificiale diventerà più attraente. L’intelligenza artificiale aiuterà gli esseri umani a prendere decisioni, a dare energia alle città intelligenti e, sfortunatamente, a infettare anche i computer con tutti i tipi di malware nocivi.

Esploriamo l'impatto futuro dell'intelligenza artificiale sul malware nel seguente articolo.

Come sarà il malware futuro con l’aiuto dell’intelligenza artificiale?

Quando si usa il termine “malware controllato dall’intelligenza artificiale”, i lettori immagineranno facilmente lo scenario: l’intelligenza artificiale causa distruzione come un “terminator”. In realtà, i programmi dannosi controllati dall’intelligenza artificiale operano di nascosto

Il malware basato sull'intelligenza artificiale è un normale malware che viene modificato tramite l'intelligenza artificiale per renderlo più efficace. Il malware basato sull’intelligenza artificiale può utilizzare la propria intelligenza per infettare i computer più velocemente o sferrare attacchi più efficaci. Invece di essere un programma “stupido” sulla rete che segue il codice preinstallato, il malware controllato dall’intelligenza artificiale può “pensare da solo” in una certa misura.

Esistono diversi modi in cui l’intelligenza artificiale può rafforzare il malware. Alcuni di questi metodi sono metaforici, mentre molti altri sono in qualche modo tangibili nel mondo reale.

Uno degli esempi di malware guidato dall’intelligenza artificiale è Deeplocker. Per fortuna, IBM Research ha sviluppato questo malware come prova di concetto che non è possibile trovare nella vita reale.

Il concetto di DeepLocker ha dimostrato come l'intelligenza artificiale possa iniettare ransomware in un dispositivo bersaglio. Gli sviluppatori di malware potrebbero lanciare un attacco contro un'azienda con ransomware, ma è altamente improbabile che possano infettare computer critici. Di conseguenza, gli avvisi potrebbero essere emessi troppo presto prima che il malware raggiunga gli obiettivi più importanti.

DeepLocker non attiva il payload. Svolge invece semplicemente le sue funzioni come programma di teleconferenza.

Quando fa il suo lavoro, scansiona i volti delle persone che lo hanno usato. L'obiettivo di DeepLocker è infettare il computer di una persona specifica, quindi tiene traccia delle persone mentre utilizzano il software. Quando rileva il volto del bersaglio, attiva il carico utile e fa sì che il PC venga bloccato da WannaCry .

Un modo teorico per utilizzare l'intelligenza artificiale nel malware è utilizzare un worm per "ricordarsi" ogni volta che un programma antivirus lo rileva. Una volta che sa quale azione fa sì che un programma antivirus lo rilevi, smetterà di eseguire quell'azione e troverà un altro modo per infettare il PC.

Ciò è particolarmente pericoloso, poiché i moderni software antivirus tendono a funzionare secondo regole e definizioni rigide. Ciò significa che tutto ciò che il worm deve fare è trovare un modo per non far scattare l'allarme. Una volta eseguito con successo, può informare altri ceppi di virus della vulnerabilità delle loro difese, consentendo loro di infettare più facilmente più PC.

Il malware attuale è piuttosto "stupido", incapace di "pensare" o prendere decisioni. Esegue una serie di attività assegnate dallo sviluppatore del malware prima che si verificasse l'infezione. Se gli sviluppatori di malware vogliono che faccia qualcosa di nuovo, devono elaborare un elenco di istruzioni che il malware deve seguire.

Questo contact center è chiamato server “Command and Control” (C&C) e deve essere estremamente ben nascosto. Se questo server viene scoperto, l'hacker potrebbe essere arrestato.

Tuttavia, se il malware è in grado di pensare da solo, non è necessario un server C&C. Gli hacker possono lasciare che il malware circoli liberamente e sedersi mentre il malware fa tutto il lavoro. Ciò significa che lo sviluppatore del malware non deve correre il rischio di impartire comandi. Basta configurarlo e lasciare che il malware faccia il suo lavoro.

Se il malware guidato dall’intelligenza artificiale prende il controllo del microfono di un bersaglio, può ascoltare e registrare ciò che le persone dicono nelle vicinanze. L’intelligenza artificiale condivide quindi ciò che sente, lo converte in testo e quindi invia il testo allo sviluppatore del malware. Ciò semplifica la vita degli hacker, perché non devono stare ore a registrare e scoprire segreti commerciali.

Il malware può imparare dalle sue azioni attraverso il cosiddetto “ apprendimento automatico ”. Questa è un’area specifica dell’intelligenza artificiale, che riguarda il modo in cui i computer possono imparare dai loro sforzi. L'apprendimento automatico è utile per gli sviluppatori di intelligenza artificiale perché non hanno bisogno di scrivere codice per ogni scenario. Dicono all’IA cosa è corretto e cosa no, poi lasciano che impari attraverso tentativi ed errori.

Quando l’intelligenza artificiale, “addestrata” dal machine learning, si trova di fronte a un ostacolo, proverà diversi metodi per superarlo. Inizialmente, non riuscirà molto bene a superare la sfida, ma il computer noterà cosa è stato fatto di sbagliato e cosa potrebbe essere migliorato. Attraverso molte iterazioni di apprendimento e di prova, alla fine emergerà l’idea della risposta “giusta”.

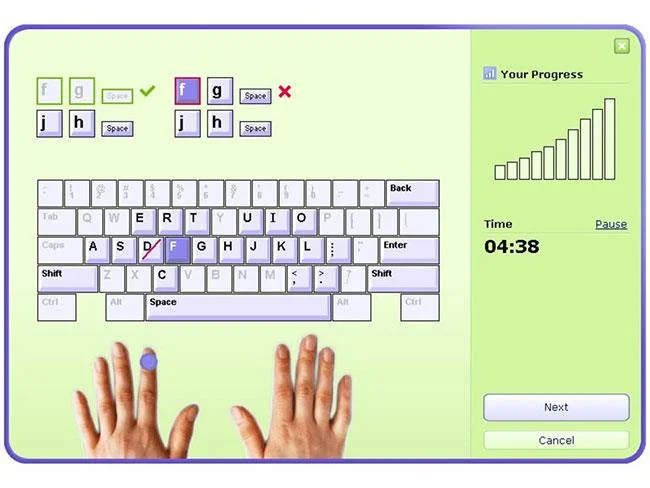

Puoi vedere un esempio di questo processo nel video qui sopra. Il video mostra un'intelligenza artificiale che impara a far camminare correttamente diverse creature. Le prime generazioni camminano come se fossero ubriache, ma le generazioni successive inizieranno a mantenere una postura corretta. Questo perché l’IA ha imparato dai fallimenti precedenti e ha fatto meglio sui modelli successivi.

Gli sviluppatori di malware utilizzano questa potenza dell'apprendimento automatico per capire esattamente come attaccare un sistema. Se si verifica un errore, il sistema registra l'errore e annota la causa. In futuro, il malware adatterà i propri modelli di attacco per ottenere risultati migliori.

Il grosso problema con l’intelligenza artificiale “addestrata” con l’apprendimento automatico è che sfruttano il modo in cui funzionano gli attuali programmi antivirus. A un software antivirus piace lavorare secondo regole semplici. Se un programma corrisponde a ciò che un antivirus riconosce come dannoso, l'antivirus lo bloccherà.

Tuttavia, il malware basato sull’intelligenza artificiale non funzionerà secondo regole fisse e preimpostate. Attaccherà continuamente il sistema di difesa, cercando di trovare un modo per passare. Una volta infiltrato nel sistema, può svolgere il suo lavoro senza intoppi finché il software antivirus non riceve aggiornamenti specifici per la minaccia.

Allora qual è il modo migliore per combattere questo malware intelligente? A volte è necessario combattere il fuoco e il modo migliore per farlo è ideare programmi antivirus basati sull'intelligenza artificiale. Questi utilizzano regole fisse per catturare malware, come molti modelli attuali. Invece, analizzano cosa sta facendo un programma e lo bloccano, se agisce in modo dannoso, dal punto di vista del programma antivirus.

Regole di base e linee guida semplici non identificheranno futuri attacchi malware. Utilizzeranno invece l’apprendimento automatico per adattarsi e modellarsi rispetto a qualsiasi metodo di sicurezza che incontrino. Potrebbe non essere così entusiasmante come Hollywood ritrae l’intelligenza artificiale dannosa, ma la minaccia è molto reale.

L'organismo che unisce i supervisori nazionali della privacy europei ha dichiarato giovedì di aver istituito una task force dedicata a ChatGPT

Scienziati danesi e americani hanno collaborato per sviluppare un sistema di intelligenza artificiale chiamato life2vec, in grado di prevedere l’ora della morte umana con elevata precisione.

Un algoritmo AI chiamato Audioflow può ascoltare il suono della minzione per identificare in modo efficace e con successo flussi anomali e corrispondenti problemi di salute del paziente.

L'invecchiamento e il calo della popolazione giapponese hanno lasciato il paese privo di un numero significativo di giovani lavoratori, soprattutto nel settore dei servizi.

Un utente Reddit di nome u/LegalBeagle1966 è uno dei tanti utenti innamorati di Claudia, una ragazza simile a una star del cinema che spesso condivide selfie seducenti, anche nudi, su questa piattaforma.

Microsoft ha appena annunciato che altre 12 aziende tecnologiche parteciperanno al suo programma AI for Good.

L'utente @mortecouille92 ha messo a frutto la potenza dello strumento di progettazione grafica Midjourney e ha creato versioni realistiche uniche di famosi personaggi di Dragon Ball come Goku, Vegeta, Bulma e l'anziano Kame. .

Semplicemente aggiungendo alcune condizioni o impostando alcuni scenari, ChatGPT può fornire risposte più pertinenti alle tue domande. Diamo un'occhiata ad alcuni modi in cui puoi migliorare la qualità delle tue risposte ChatGPT.

Midjourney è un sistema di intelligenza artificiale che recentemente ha causato "febbre" nella comunità online e nel mondo degli artisti a causa dei suoi dipinti estremamente belli che non sono inferiori a quelli dei veri artisti.

Alcuni giorni dopo l’annuncio dell’epidemia da parte della Cina, con l’accesso ai dati globali sulle vendite di biglietti aerei, il sistema di intelligenza artificiale di BlueDot ha continuato a prevedere con precisione la diffusione del virus Corona di Wuhan a Bangkok, Seul, Taipei e Tokyo.