La task force ChatGPT sarà istituita dall’Europa

L'organismo che unisce i supervisori nazionali della privacy europei ha dichiarato giovedì di aver istituito una task force dedicata a ChatGPT

Recentemente, i ricercatori dell'Università di Harvard e del laboratorio AI-MIT Watson del MIT hanno creato lo strumento GLTR (Giant Language Model Test Room - Giant Language Model Test Room) per rilevare le distorsioni informative prodotte dall'intelligenza artificiale, utilizzando la stessa intelligenza artificiale.

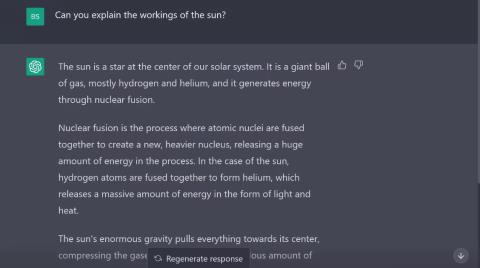

Lo strumento GLTR comprende chiaramente come funziona l'intelligenza artificiale e quindi analizza il contenuto delle informazioni. Questo strumento rileva le notizie false create dalla tecnologia AI evidenziando una porzione di testo. I lettori possono seguire le capacità analitiche di GLTP nell'illustrazione seguente. Con le parole evidenziate in verde, sono le più prevedibili, il rosso e il giallo sono meno prevedibili e il viola è il meno prevedibile.

Gli scienziati si affidano ai colori presenti in ogni parte di testo e analisi per valutare l'autenticità delle informazioni, indipendentemente dal fatto che siano state create da algoritmi o meno. Il testo evidenziato in rosso, viola e giallo avrà meno probabilità di essere generato dall'intelligenza artificiale a causa dell'uso di molte parole difficili. Se il testo è molto blu, significa che ci sono molte parole comuni e probabilmente sono state create da un bot. Questo strumento aiuta ad aumentare il tasso di rilevamento di testo falso di circa il 72%.

In sostanza, le frasi scritte da un generatore di testo AI possono essere grammaticalmente corrette, ma avranno sicuramente problemi semantici, o in molti casi addirittura prive di qualsiasi significato reale.

Attualmente, l’uso dell’intelligenza artificiale e di modelli di generazione del linguaggio innaturale per creare notizie false e diffondere informazioni false sta diventando sempre più comune, portando a gravi conseguenze per la società. Questi testi falsi sono talvolta estremamente elaborati, rendendo difficile per i lettori rendersi conto che sono stati scritti da una macchina anziché da un essere umano. Nel frattempo, lo strumento GLTR è dotato della capacità di distinguere accuratamente il tipo di testo falso di cui sopra, agendo come un efficace strumento di intelligenza artificiale "nemico naturale". Questa è anche l’idea centrale dei ricercatori di questo progetto GLTR.

Iniziative simili a GLTR dovrebbero essere presto promosse e ampiamente utilizzate nella pratica. Sono preziosi non solo per individuare testi falsi, ma svolgono anche un ruolo particolarmente efficace nell’identificare i bot di Twitter, che vengono spesso utilizzati per interrompere le elezioni negli Stati Uniti e in molti altri paesi di un’altra famiglia.

Usare l'intelligenza artificiale stessa per rilevarla è una misura efficace del "nemico naturale".

Usare l'intelligenza artificiale stessa per rilevarla è una misura efficace del "nemico naturale".

Prima della nascita di GLTR, esisteva uno strumento di riconoscimento basato sull’intelligenza artificiale ampiamente utilizzato e relativamente efficace chiamato Botometer. In sostanza, Botometer utilizza tecniche di apprendimento automatico per determinare se un account è gestito da un essere umano o da un algoritmo software. Questo strumento è in grado di identificare account bot e account falsi che non sono gestiti da esseri umani con una precisione fino al 95%.

Ancora una volta, viene sottolineata e sottolineata la necessità di creare sistemi collaborativi IA-uomo per risolvere problemi tecnologici/sociali comuni. Questo è un compito difficile, ma estremamente urgente per l’umanità nell’attuale era digitale e dell’intelligenza artificiale.

Vedi altro:

L'organismo che unisce i supervisori nazionali della privacy europei ha dichiarato giovedì di aver istituito una task force dedicata a ChatGPT

Scienziati danesi e americani hanno collaborato per sviluppare un sistema di intelligenza artificiale chiamato life2vec, in grado di prevedere l’ora della morte umana con elevata precisione.

Un algoritmo AI chiamato Audioflow può ascoltare il suono della minzione per identificare in modo efficace e con successo flussi anomali e corrispondenti problemi di salute del paziente.

L'invecchiamento e il calo della popolazione giapponese hanno lasciato il paese privo di un numero significativo di giovani lavoratori, soprattutto nel settore dei servizi.

Un utente Reddit di nome u/LegalBeagle1966 è uno dei tanti utenti innamorati di Claudia, una ragazza simile a una star del cinema che spesso condivide selfie seducenti, anche nudi, su questa piattaforma.

Microsoft ha appena annunciato che altre 12 aziende tecnologiche parteciperanno al suo programma AI for Good.

L'utente @mortecouille92 ha messo a frutto la potenza dello strumento di progettazione grafica Midjourney e ha creato versioni realistiche uniche di famosi personaggi di Dragon Ball come Goku, Vegeta, Bulma e l'anziano Kame. .

Semplicemente aggiungendo alcune condizioni o impostando alcuni scenari, ChatGPT può fornire risposte più pertinenti alle tue domande. Diamo un'occhiata ad alcuni modi in cui puoi migliorare la qualità delle tue risposte ChatGPT.

Midjourney è un sistema di intelligenza artificiale che recentemente ha causato "febbre" nella comunità online e nel mondo degli artisti a causa dei suoi dipinti estremamente belli che non sono inferiori a quelli dei veri artisti.

Alcuni giorni dopo l’annuncio dell’epidemia da parte della Cina, con l’accesso ai dati globali sulle vendite di biglietti aerei, il sistema di intelligenza artificiale di BlueDot ha continuato a prevedere con precisione la diffusione del virus Corona di Wuhan a Bangkok, Seul, Taipei e Tokyo.