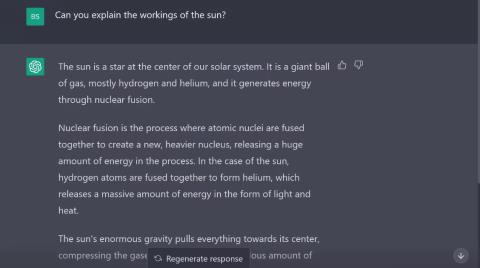

Grupul de lucru ChatGPT va fi înființat de Europa

Organismul care reunește organele naționale de supraveghere a vieții private din Europa a declarat joi că a înființat un grup operativ dedicat ChatGPT

Uniunea Europeană a emis astăzi în mod oficial un set de documente de orientare cu privire la modul în care atât întreprinderile, cât și guvernele ar trebui să urmeze în dezvoltarea și implementarea proiectelor lor de inteligență artificială, astfel încât să fie cu adevărat transparent, corect și „etic”.

Acest lucru îmi amintește brusc de o lege numită Trei legi ale roboticii menționată de scriitorul rus Isaac Asimov în colecția de nuvele „Runaround” pe care a compus-o în 1942, ceva asemănător cu prima: Un robot nu are voie să facă rău oamenilor sau să ignore pericolele care se confruntă oamenii. Articolul 2: Un robot trebuie să se supună absolut ordinelor date de oameni, cu excepția cazului în care aceste ordine sunt în conflict cu prima lege. Și al treilea: Un robot trebuie să se protejeze, cu condiția ca o astfel de protecție să nu intre în conflict cu prima și a doua lege. Deși acesta este doar un set de reguli „ficțiune” care au apărut în urmă cu aproape 80 de ani, este încă de actualitate mai ales atunci când oamenii intră treptat în era actuală a inteligenței artificiale. Desigur, noul set de reguli emis de UE nu va fi în esență același cu legea „Trei legi ale roboticii” a lui Isaac Asimov. Legislatorii europeni nu pot oferi un cadru etic flexibil care să ne ajute să navigăm în lucruri mari, cum ar fi oprirea roboților ucigași. În schimb, documentele de orientare ale UE ajută la abordarea problemelor „întunecate și omniprezente” care au un impact negativ asupra societății, deoarece integrăm inteligența artificială în multe domenii importante ale vieții noastre, cum ar fi asistența medicală, educația și tehnologia de consum.

Ca exemplu simplu, dacă un sistem medical de inteligență artificială diagnostichează o persoană cu risc crescut de a dezvolta cancer în viitor, ghidul UE va ajuta să se asigure că unele dintre următoarele trebuie făcute: Software-ul nu este părtinitor sau părtinitor de către pacientul. rasa sau sexul, si in acelasi timp sa ofere cele mai clare si mai transparente informatii despre starea lor medicala si mai ales nu trebuie sa interfereze sau sa impiedice deciziile pacientului.medic.

Deci, da, aceste linii directoare se concentrează în principal pe limitarea și controlul modelelor AI pentru a funcționa corect, dar numai la nivel administrativ și birocratic, mai degrabă decât pe prevenirea actelor de ucidere conform imaginației scriitorului Asimov.

Pentru a produce acest set de documente de orientare, UE a trebuit să convoace un grup de 52 de experți, cerându-le să discute, să fie de acord și să vină cu 7 cerințe pe care consideră că ar trebui să le poată răspunde viitoarele sisteme AI. Aceste cerințe sunt după cum urmează:

Probabil veți observa că unele dintre afirmațiile de mai sus sunt destul de abstracte și ar fi dificil de evaluat într-un sens obiectiv (de exemplu, definiția schimbării sociale pozitive pe care IA o aduce va varia foarte mult de la o persoană la alta și, mai larg, între țări. ). Cu toate acestea, majoritatea elementelor rămase sunt în general mai simple și pot fi verificate și garantate prin supravegherea autorităților. De exemplu, partajarea datelor utilizate pentru antrenarea sistemelor AI guvernamentale ar putea fi o modalitate bună de a combate algoritmii părtinitori și opaci.

Prevederile acestor documente de orientare ale UE în mod evident nu sunt obligatorii din punct de vedere juridic, dar ar putea fi folosite pentru a modela orice legislație viitoare elaborată de Uniunea Europeană care să conțină domeniului IA. În trecut, UE a spus în mod repetat că dorește să facă din Europa un pionier în lume în implementarea modelelor „etice” de IA și lansarea unui set de documente de orientare. Acest lucru arată în mod clar că sunt pregătiți să elaboreze legi de anvergură. reglementarea și protejarea drepturilor digitale.

UE dorește să modeleze o industrie de inteligență artificială cu standarde etice la bază

Ca parte a eforturilor de a crea o industrie AI „etică”, documentul de orientare al UE ar putea fi văzut ca o piatră de temelie pentru crearea unei „liste de evaluare a IA de încredere” – o listă de termeni care poate ajuta experții să găsească orice puncte slabe sau potențiale pericole într-o IA. software, chiar dacă a fost implementat pe scară largă. Această listă poate include întrebări precum: „Poți demonstra cum funcționează sistemul tău AI în situații și medii complexe?” sau „Puteți evalua tipul și domeniul de aplicare al datelor din setul de date?” ...

Desigur, această listă de evaluare este doar preliminară, UE va trebui să colecteze în continuare feedback de la companii și experți în inteligență artificială în viitorul apropiat. Încă din 2020, UE va publica un raport de sinteză pe această problemă.

Anny Hidvégi, manager de politici la grupul pentru drepturile digitale Access Now și unul dintre cei 52 de experți responsabili cu elaborarea documentelor de orientare ale UE, a declarat că lista de evaluare este partea cheie. Punctul cel mai important al raportului: „Acest set de documente ajută la furnizarea unui punct de vedere practic. , o perspectivă de perspectivă asupra modului de a preveni și de a minimiza potențialul rău al AI.”

„În opinia noastră, UE are suficient potențial și responsabilitate pentru a deveni o organizație lider în această activitate. Dar, pe lângă asta, credem și că Uniunea Europeană nu trebuie să se oprească la principii morale. Ei ar trebui să ia în considerare solicitarea companiilor miniere AI să respecte legea în viitor”, a adăugat domnul Hidvégi.

Alții sunt sceptici că încercarea UE de a modela modul în care este dezvoltată IA globală prin cercetare etică va avea un efect mare.

„Suntem sceptici cu privire la abordarea pe care o adoptă principala organizație europeană. Ideea că, prin crearea unui standard de aur pentru sistemele AI etice, UE își va putea să-și facă loc în dezvoltarea industriei globale de IA este relativ exagerată. Pentru a deveni un lider în modelarea regulilor etice AI, UE trebuie mai întâi să devină un lider în domeniul AI în ansamblu”, a declarat Eline Ch Pivot, analist senior de politici la Centrul European de Inovare în Date.

Ce părere aveți despre această problemă? Vă rugăm să lăsați comentariile dumneavoastră în secțiunea de comentarii de mai jos!

Organismul care reunește organele naționale de supraveghere a vieții private din Europa a declarat joi că a înființat un grup operativ dedicat ChatGPT

Oamenii de știință danezi și americani au colaborat pentru a dezvolta un sistem AI numit life2vec, capabil să prezică ora morții umane cu mare precizie.

Un algoritm AI numit Audioflow poate asculta sunetul urinării pentru a identifica eficient și cu succes fluxurile anormale și problemele de sănătate corespunzătoare ale pacientului.

Îmbătrânirea și scăderea populației din Japonia a lăsat țara lipsită de un număr semnificativ de tineri lucrători, în special în sectorul serviciilor.

Un utilizator Reddit numit u/LegalBeagle1966 este unul dintre mulți utilizatori îndrăgostiți de Claudia, o fată asemănătoare vedetei de cinema care deseori împărtășește selfie-uri seducătoare, chiar și nud, pe această platformă.

Microsoft tocmai a anunțat că alte 12 companii de tehnologie vor participa la programul său AI for Good.

Utilizatorul @mortecouille92 a pus în funcțiune puterea instrumentului de design grafic Midjourney și a creat versiuni realiste unice ale personajelor celebre Dragon Ball precum Goku, Vegeta, Bulma și bătrânul Kame. .

Doar prin adăugarea unor condiții sau configurarea unor scenarii, ChatGPT poate oferi răspunsuri mai relevante la întrebările dvs. Să vedem câteva modalități prin care puteți îmbunătăți calitatea răspunsurilor dvs. ChatGPT.

Midjourney este un sistem de inteligență artificială care a provocat recent o „febră” în comunitatea online și în lumea artiștilor din cauza picturilor sale extrem de frumoase, care nu sunt inferioare celor ale artiștilor adevărați.

La câteva zile după ce China a anunțat focarul, având acces la datele globale despre vânzările de bilete de avion, sistemul AI al BlueDot a continuat să prezică cu exactitate răspândirea virusului Wuhan Corona la Bangkok, Seul, Taipei și Tokyo.