Grupul de lucru ChatGPT va fi înființat de Europa

Organismul care reunește organele naționale de supraveghere a vieții private din Europa a declarat joi că a înființat un grup operativ dedicat ChatGPT

În ciuda capabilităților impresionante ale ChatGPT , mai multe companii mari le-au interzis angajaților să folosească acest chatbot AI.

În mai 2023, Samsung a interzis utilizarea ChatGPT și a altor instrumente AI generative . Apoi, în iunie 2023, Commonwealth Bank din Australia, împreună cu companii precum Amazon, Apple și JPMorgan Chase & Co, au implementat și restricția. Unele spitale, firme de avocatură și agenții guvernamentale au interzis, de asemenea, angajaților să folosească ChatGPT.

Deci, de ce tot mai multe companii interzic ChatGPT? Iată 5 motive principale.

1. Scurgere de date

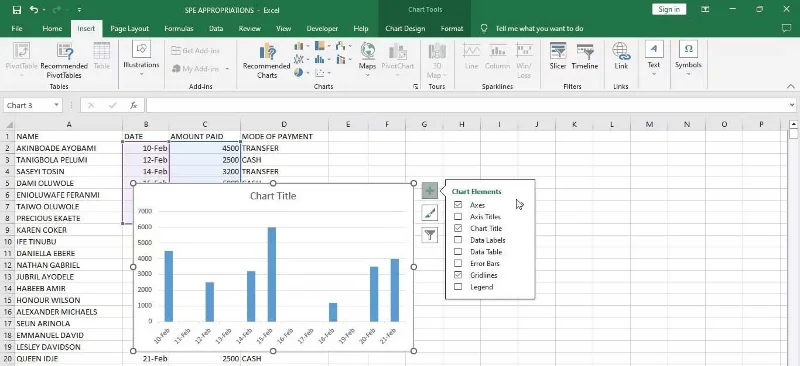

ChatGPT necesită o cantitate mare de date pentru a se antrena și a funcționa eficient. Chatbot-ul a fost antrenat folosind cantități uriașe de date obținute de pe Internet și va continua să fie antrenat.

Conform paginii de ajutor a OpenAI, fiecare parte de date, inclusiv detaliile confidențiale ale clienților, secretele comerciale și informațiile comerciale sensibile, pe care le furnizați chatbot-ului poate fi revizuită și utilizată pentru a îmbunătăți sistemul.

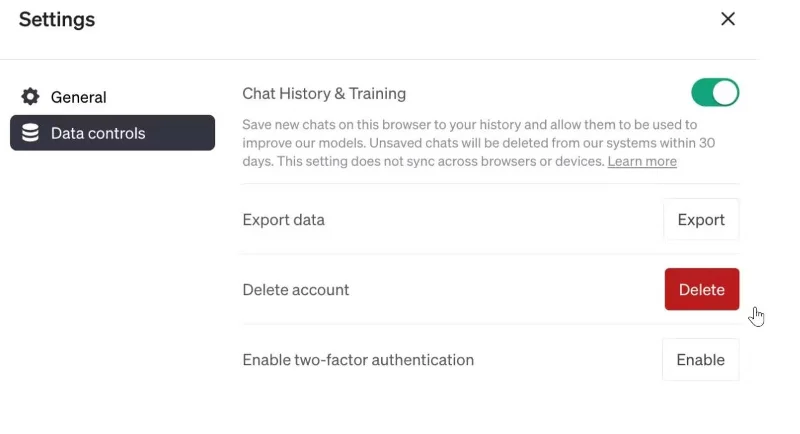

Configurați autentificarea cu mai mulți factori pe ChatGPT

Multe companii sunt supuse unor reglementări stricte privind protecția datelor. Prin urmare, sunt precauți în ceea ce privește partajarea datelor cu caracter personal cu entități externe, deoarece acest lucru crește riscul scurgerii de date.

În plus, OpenAI nu oferă nicio garanție de securitate și protecție perfectă a datelor. În martie 2023, OpenAI a confirmat o eroare care le-a permis unor utilizatori să vadă titlurile de chat în istoricul altor utilizatori activi. Deși acest bug a fost remediat și OpenAI a lansat un program de recompensă pentru erori, compania nu garantează siguranța și confidențialitatea datelor utilizatorilor.

Multe organizații aleg să restricționeze angajații să folosească ChatGPT pentru a evita încălcările de date, care pot deteriora reputația, pot duce la pierderi financiare și își pun clienții și angajații în pericol.

2. Riscuri de securitate cibernetică

Deși nu este clar dacă ChatGPT este de fapt susceptibil la riscurile de securitate cibernetică, este posibil ca implementarea acestuia într-o organizație să creeze potențiale vulnerabilități care ar putea fi exploatate de atacatorii cibernetici.

Dacă o companie integrează ChatGPT și există o slăbiciune în sistemul de securitate al chatbot-ului, atacatorii pot exploata vulnerabilitatea și o pot infecta cu malware. În plus, capacitatea ChatGPT de a genera răspunsuri asemănătoare oamenilor este un „ou de aur” pentru atacatorii de tip phishing, care pot prelua conturi sau uzurpa identitatea unor entități legitime pentru a-i păcăli pe angajații companiei să partajeze informații sensibile.

3. Creați chatbot-uri personalizate

În ciuda caracteristicilor sale inovatoare, ChatGPT poate crea informații false și înșelătoare. Prin urmare, multe companii au creat chatbot-uri AI în scopuri profesionale. De exemplu, Commonwealth Bank din Australia a cerut personalului său să folosească Gen.ai, un chatbot de inteligență artificială (AI) care folosește informațiile CommBank pentru a oferi răspunsuri.

Companii precum Samsung și Amazon au dezvoltat modele avansate de limbaj natural, astfel încât companiile să poată crea și implementa cu ușurință chatbot-uri personalizate pe baza transcrierilor existente. Cu acești roboti de chat interni, puteți preveni consecințele legale și reputaționale asociate cu manipularea greșită a datelor.

4. Lipsa reglementărilor

În industriile în care companiile sunt supuse protocoalelor și sancțiunilor, lipsa îndrumărilor de reglementare a ChatGPT este un semnal roșu. Fără condiții legale precise care să guverneze utilizarea ChatGPT, companiile s-ar putea confrunta cu consecințe legale grave atunci când folosesc chatbot-uri AI pentru operațiunile lor.

În plus, lipsa de reglementare poate reduce responsabilitatea și transparența corporativă. Poate fi confuz pentru majoritatea companiilor să explice clienților procesele de luare a deciziilor și măsurile de securitate ale modelului de limbaj AI.

Companiile restricționează ChatGPT din cauza preocupărilor legate de potențialul de încălcare a legilor privind confidențialitatea și a reglementărilor specifice industriei.

5. Utilizarea iresponsabilă de către angajați

În multe companii, unii angajați se bazează exclusiv pe răspunsurile ChatGPT pentru a crea conținut și a-și îndeplini sarcinile. Acest lucru creează lene în mediul de lucru și înăbușă creativitatea și inovația.

Bazându-te pe AI vă poate împiedica capacitatea de a gândi critic. De asemenea, poate afecta reputația unei companii, deoarece ChatGPT oferă adesea date inexacte și nesigure.

În timp ce ChatGPT este un instrument puternic, utilizarea acestuia pentru a rezolva interogări complexe care necesită expertiză specifică domeniului poate afecta operațiunile și eficiența unei companii. Este posibil ca unii angajați să nu-și amintească să verifice și să verifice răspunsurile oferite de chatboții AI, considerându-le pe cele oferite de ChatGPT ca o soluție universală.

Pentru a atenua astfel de probleme, companiile interzic chatbot-urile, astfel încât angajații să se poată concentra asupra sarcinilor lor și să ofere utilizatorilor soluții fără erori.

Organismul care reunește organele naționale de supraveghere a vieții private din Europa a declarat joi că a înființat un grup operativ dedicat ChatGPT

Oamenii de știință danezi și americani au colaborat pentru a dezvolta un sistem AI numit life2vec, capabil să prezică ora morții umane cu mare precizie.

Un algoritm AI numit Audioflow poate asculta sunetul urinării pentru a identifica eficient și cu succes fluxurile anormale și problemele de sănătate corespunzătoare ale pacientului.

Îmbătrânirea și scăderea populației din Japonia a lăsat țara lipsită de un număr semnificativ de tineri lucrători, în special în sectorul serviciilor.

Un utilizator Reddit numit u/LegalBeagle1966 este unul dintre mulți utilizatori îndrăgostiți de Claudia, o fată asemănătoare vedetei de cinema care deseori împărtășește selfie-uri seducătoare, chiar și nud, pe această platformă.

Microsoft tocmai a anunțat că alte 12 companii de tehnologie vor participa la programul său AI for Good.

Utilizatorul @mortecouille92 a pus în funcțiune puterea instrumentului de design grafic Midjourney și a creat versiuni realiste unice ale personajelor celebre Dragon Ball precum Goku, Vegeta, Bulma și bătrânul Kame. .

Doar prin adăugarea unor condiții sau configurarea unor scenarii, ChatGPT poate oferi răspunsuri mai relevante la întrebările dvs. Să vedem câteva modalități prin care puteți îmbunătăți calitatea răspunsurilor dvs. ChatGPT.

Midjourney este un sistem de inteligență artificială care a provocat recent o „febră” în comunitatea online și în lumea artiștilor din cauza picturilor sale extrem de frumoase, care nu sunt inferioare celor ale artiștilor adevărați.

La câteva zile după ce China a anunțat focarul, având acces la datele globale despre vânzările de bilete de avion, sistemul AI al BlueDot a continuat să prezică cu exactitate răspândirea virusului Wuhan Corona la Bangkok, Seul, Taipei și Tokyo.