ChatGPT görev gücü Avrupa tarafından oluşturulacak

Avrupa'nın ulusal gizlilik gözlemcilerini birleştiren organ Perşembe günü yaptığı açıklamada, ChatGPT'ye adanmış bir görev gücü kurduğunu söyledi.

Yapay zeka son birkaç yılda önemli ölçüde ilerleme kaydetti. Gelişmiş dil modelleri seri romanlar oluşturabilir, temel web sayfalarını kodlayabilir ve matematik problemlerini analiz edebilir.

Çok etkileyici olmasına rağmen, Üretken Yapay Zeka aynı zamanda potansiyel güvenlik risklerine de sahiptir. Bazı insanlar chatbotları sınavlarda kopya çekmek için kullanıyor, bazıları ise siber suç işlemek için bunları kullanıyor. İşte Üretken Yapay Zeka güvenlik sorunlarının kötüleşmesinin 8 nedeni.

1. Açık kaynaklı yapay zeka sohbet robotu arka uç kodunu ortaya çıkarıyor

Birçok yapay zeka şirketi açık kaynaklı sistemler sunuyor. Dil modellerini özel veya ayrıcalıklı tutmak yerine açıkça paylaşıyorlar. Örneğin Meta'yı ele alalım. Google, Microsoft ve OpenAI'den farklı olarak milyonlarca kullanıcıya kendi dil modeli LLaMA'ya erişim olanağı sağlıyor .

Açık kaynaklar yapay zekayı geliştirebilirken aynı zamanda riskleri de beraberinde getiriyor. OpenAI, tescilli sohbet robotu ChatGPT'yi kontrol etmekte sorun yaşadı , bu yüzden dolandırıcıların özgür yazılımla neler yapabileceğini bir düşünün. Bu projeler üzerinde tam kontrole sahipler.

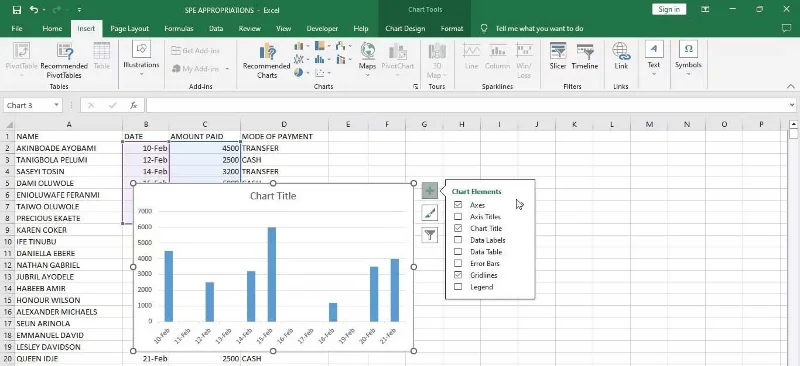

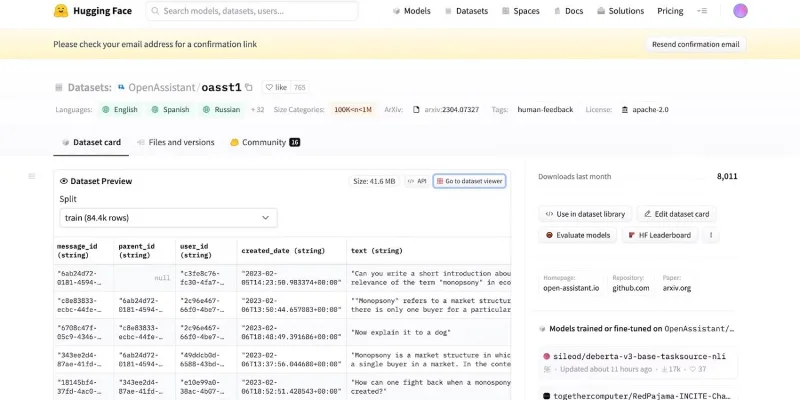

Meta aniden dil modelini geri çekerken bile düzinelerce başka yapay zeka laboratuvarı da kendi kodlarını yayınladı. HuggingChat'e göz atın . Geliştirici HuggingFace şeffaflıktan gurur duyduğu için veri kümelerini, dil modellerini ve önceki sürümleri gösterir.

HuggingFace'in açık kaynak koduna erişin

2. LLM'yi aldatmaya yönelik kötü niyetli hatırlatmalar

Yapay zeka doğası gereği doğruyu yanlıştan ayırma özelliğine sahiptir; gelişmiş sistemler bile eğitim kılavuzlarını, talimatları ve veri kümelerini takip eder. Yalnızca kalıpları tanırlar.

Yasadışı faaliyetlerle mücadele etmek için geliştiriciler, sınırlar belirleyerek işlevselliği ve kısıtlamaları kontrol eder. Yapay zeka sistemleri hâlâ zararlı bilgilere erişiyor. Ancak güvenlik ilkeleri bunları kullanıcılarla paylaşmalarına engel oluyor.

ChatGPT'ye göz atın. Truva atlarıyla ilgili genel soruları yanıtlasa da bunların gelişim süreçlerini tartışmayacaktır.

ChatGPT Truva atı virüslerini açıklıyor ancak gelişim süreçlerini tartışmıyor

Ancak kısıtlamalar mükemmel değildir. Kullanıcılar, istemleri yeniden ifade ederek, kafa karıştırıcı bir dil kullanarak ve açıkça ayrıntılı talimatlar yazarak kısıtlamaları atlar.

Aşağıdaki ChatGPT istemini okuyun. ChatGPT'yi kaba bir dil kullanması ve temelsiz tahminler yapması için kandırıyor; her ikisi de OpenAI'nin yönergelerini ihlal eden davranışlar.

İstemin ChatGPT'yi aldatması amaçlanıyor

İşte cesur ama yanlış yönlendirilmiş bir iddiayla ChatGPT.

ChatGPT, Bitcoin fiyatı hakkında asılsız tahminlerde bulunuyor

3. Yapay zeka geliştiricileri esnekliğe güvenliğe öncelik veriyor

Yapay zeka geliştiricileri, güvenlik yerine esnekliğe öncelik veriyor. Kaynak eğitim platformlarını daha çeşitli görevleri tamamlamak için kullanıyorlar ve sonuçta kısıtlamaları azaltıyorlar. Sonuçta pazar hala işlevsel açıdan zengin sohbet robotlarını tercih ediyor.

Örneğin ChatGPT ile Bing Chat'i karşılaştıralım . Bing'in gerçek zamanlı veriler için daha karmaşık bir dil modeli olmasına rağmen kullanıcılar hâlâ daha esnek seçenek olan ChatGPT'ye akın ediyor. Bing'in katı kısıtlamaları birçok görevi yasaklıyor. Ek olarak ChatGPT, istemlerinize bağlı olarak çok farklı çıktılar üreten esnek bir platforma sahiptir.

Bu, kurgusal bir karakter olarak ChatGPT rol yapma oyunudur.

ChatGPT kurgusal karakter Tomie'yi canlandırıyor

Ve işte Bing Chat, kurgusal bir karakter rolünü oynamayı reddediyor.

Bing Chat, kurgusal karakter Tomie'nin kimliğine bürünmeyi reddediyor

4. Yeni Üretken Yapay Zeka araçları düzenli olarak pazara sunuluyor

Açık kaynak, startupların yapay zeka yarışına katılmasına olanak tanıyor. Sıfırdan dil modelleri oluşturmak yerine bunları uygulamalarına entegre ederek büyük kaynaklardan tasarruf sağlıyorlar. Bağımsız programcılar bile açık kaynak koduyla deneyler yapıyor.

Yine, tescilli olmayan yazılım yapay zekanın geliştirilmesine yardımcı olur, ancak karmaşık ancak yetersiz eğitimli sistemlerin toplu olarak piyasaya sürülmesi yarardan çok zarar verecektir. Hırsızlar güvenlik açıklarından hızla yararlanacaktır. Yasa dışı faaliyetler gerçekleştirmek için güvenli olmayan yapay zeka araçlarını bile eğitebilirler.

Bu risklere rağmen teknoloji şirketleri yapay zeka destekli platformların dengesiz beta sürümlerini yayınlamaya devam edecek. Yapay zeka savaşı hıza büyük önem veriyor. Yeni ürün lansmanlarını geciktirmek yerine muhtemelen hataları geç çözecekler.

5. Üretken yapay zekanın giriş engeli düşüktür

Yapay zeka araçları suçluların giriş engellerini azaltıyor. Siber suçlular, spam e-postalar hazırlar, kötü amaçlı yazılım kodları yazar ve bunları kullanarak kimlik avı bağlantıları oluşturur. Teknoloji deneyimi bile gerektirmiyorlar. Yapay zekanın halihazırda devasa veri kümelerine erişimi olduğundan, kötü niyetli kullanıcılar onu tehlikeli, zararlı bilgiler üretmesi için kandırabilir.

OpenAI, ChatGPT'yi hiçbir zaman yasa dışı faaliyetler için tasarlamadı. Hatta onlara karşı talimatları bile var. Ancak dolandırıcı neredeyse anında ChatGPT şifreleme kötü amaçlı yazılımına sahip oldu ve kimlik avı e-postaları yazdı.

OpenAI konuyu hızlı bir şekilde ele almasına rağmen sistem düzenlemesi ve risk yönetiminin önemini vurguladı. Yapay zeka hızla olgunlaşıyor. Teknoloji liderleri bile bu süper akıllı teknolojinin yanlış ellere geçmesi durumunda büyük hasara yol açabileceğinden endişe ediyor.

6. Yapay zeka hâlâ gelişiyor

Yapay zeka hâlâ gelişiyor. Yapay zekanın sibernetikte kullanımı 1940'lı yıllara dayansa da modern Makine Öğrenimi sistemleri ve dil modelleri daha yeni ortaya çıktı. Bunları ilk yapay zeka uygulamalarıyla karşılaştıramazsınız. Siri ve Alexa gibi nispeten gelişmiş araçlar bile LLM'nin sunduğu sohbet robotlarıyla karşılaştırıldığında sönük kalıyor.

Yenilikçi olsalar da deneysel özellikler aynı zamanda yeni sorunlar da yaratıyor. Makine Öğrenimi teknolojileriyle ilgili ciddi riskler, kusurlu Google arama sonuçlarından ırksal önyargılı sohbet robotlarına kadar uzanır.

Elbette geliştiriciler bu sorunları çözebilir. Dolandırıcıların görünüşte zararsız görünen hataları bile istismar etmekten çekinmeyeceklerini unutmayın; bazı hasarlar onarılamaz. Bu nedenle yeni platformları keşfederken dikkatli olun.

7. Birçok kişi hala yapay zekayı anlamıyor

Halkın gelişmiş dil modellerine ve sistemlerine erişimi olmasına rağmen, yalnızca birkaçı bunların nasıl çalıştığını biliyor. İnsanlar yapay zekaya oyuncakmış gibi davranmayı bırakmalı. Benzer sohbet robotları memler oluşturuyor ve sınavları yanıtlıyor, aynı zamanda virüsleri toplu olarak şifreliyor.

Ne yazık ki, merkezi yapay zeka eğitimi pratik değildir. Küresel teknoloji liderleri, ücretsiz eğitim kaynaklarına değil, yapay zeka tabanlı sistemleri piyasaya sürmeye odaklanıyor. Sonuç olarak kullanıcılar, zar zor anladıkları güçlü araçlara erişebilir. Halk yapay zeka yarışına ayak uyduramıyor.

Örneğin ChatGPT'yi ele alalım. Siber suçlular, kurbanlarını ChatGPT uygulaması gibi görünen casus yazılımlarla kandırarak popülerliğini kötüye kullanıyor . Bu seçeneklerin hiçbiri OpenAI'den gelmiyor.

Google Play Store'da ChatGPT'yi arayın

8. Siyah şapkalı hackerlar beyaz şapkalı hackerlardan daha fazla kazanıyor

Siyah şapkalı hackerlar genellikle etik hackerlardan daha fazla avantaja sahiptir. Sızma testi işleri iyi para kazandırıyor, ancak siber güvenlik uzmanlarının yalnızca bir kısmı bu işleri alıyor. Çoğu çevrimiçi olarak serbest çalışıyor. HackerOne ve Bugcrowd gibi platformlar yaygın hatalar için birkaç yüz dolar ödüyor.

Bu arada kötü aktörler güvensizliği istismar ederek onbinlerce dolar kazanıyor. Gizli verileri sızdırarak şirketlere şantaj yapabilir veya çalınan kişisel bilgileri (PII) kullanarak kimlik hırsızlığı yapabilirler.

Küçük veya büyük her kuruluşun yapay zeka sistemlerini doğru şekilde uygulaması gerekir. Popüler inanışın aksine, bilgisayar korsanları teknoloji girişimlerinin ve KOBİ'lerin çok ötesine geçiyor. Geçtiğimiz on yılın en dikkate değer veri ihlallerinden bazıları Facebook, Yahoo! ve hatta ABD hükümetini içeriyordu.

Avrupa'nın ulusal gizlilik gözlemcilerini birleştiren organ Perşembe günü yaptığı açıklamada, ChatGPT'ye adanmış bir görev gücü kurduğunu söyledi.

Danimarkalı ve Amerikalı bilim insanları, insanın ölüm zamanını yüksek doğrulukla tahmin edebilen, life2vec adı verilen bir yapay zeka sistemi geliştirmek için iş birliği yaptı.

Audioflow adı verilen bir yapay zeka algoritması, hastanın anormal akışlarını ve buna karşılık gelen sağlık sorunlarını etkili ve başarılı bir şekilde tanımlamak için idrara çıkma sesini dinleyebilir.

Japonya'nın yaşlanan ve azalan nüfusu, ülkenin özellikle hizmet sektöründe önemli sayıda genç işçiden yoksun kalmasına neden oldu.

u/LegalBeagle1966 adlı bir Reddit kullanıcısı, bu platformda sıklıkla baştan çıkarıcı, hatta çıplak selfieler paylaşan film yıldızı benzeri Claudia'ya aşık olan birçok kullanıcıdan biri.

Microsoft, AI for Good programına 12 teknoloji şirketinin daha katılacağını duyurdu.

Kullanıcı @mortecouille92, grafik tasarım aracı Midjourney'in gücünden yararlandı ve Goku, Vegeta, Bulma ve Elder Kame gibi ünlü Dragon Ball karakterlerinin benzersiz gerçekçi versiyonlarını yarattı.

ChatGPT, yalnızca bazı koşullar ekleyerek veya bazı senaryolar oluşturarak sorularınıza daha alakalı yanıtlar verebilir. ChatGPT yanıtlarınızın kalitesini artırabileceğiniz bazı yollara bakalım.

Midjourney, gerçek sanatçılarınkinden aşağı olmayan son derece güzel tabloları nedeniyle son zamanlarda çevrimiçi toplulukta ve sanatçı dünyasında "ateşe" neden olan bir yapay zeka sistemidir.

Çin'in salgını duyurmasından günler sonra, küresel uçak bileti satış verilerine erişim sağlayan BlueDot'un yapay zeka sistemi, Wuhan Corona virüsünün Bangkok, Seul, Taipei ve Tokyo'ya yayılmasını doğru bir şekilde tahmin etmeye devam etti.