Die ChatGPT-Task Force wird von Europa eingerichtet

Das Gremium, das die nationalen Datenschutzbeauftragten Europas vereint, gab am Donnerstag bekannt, dass es eine Task Force für ChatGPT eingerichtet habe

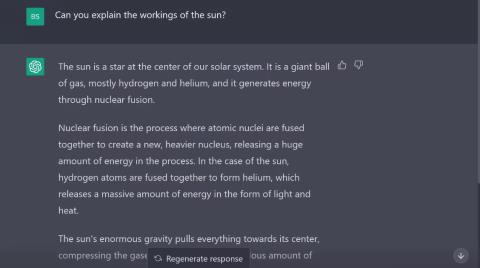

Chatbots gibt es schon seit vielen Jahren, aber der Aufstieg großer Sprachmodelle wie ChatGPT und Google Bard hat der Chatbot-Branche neues Leben eingehaucht.

Mittlerweile nutzen weltweit Millionen von Menschen KI-Chatbots. Es gibt jedoch einige wichtige Risiken und Datenschutzbedenken, die Sie im Hinterkopf behalten sollten, wenn Sie eines dieser Tools ausprobieren möchten.

1. Daten sammeln

Die meisten Menschen nutzen Chatbots nicht nur, um Hallo zu sagen. Moderne Chatbots sind darauf ausgelegt, komplexe Fragen und Wünsche zu bearbeiten und zu beantworten, wobei die Benutzer oft viele Informationen in ihre Eingabeaufforderungen einbeziehen. Selbst wenn Sie nur eine einfache Frage stellen, möchten Sie nicht, dass diese über das Gespräch hinausgeht.

Laut OpenAI-Support können Sie ChatGPT-Chatprotokolle jederzeit löschen. Diese Protokolle werden dann nach 30 Tagen dauerhaft von den OpenAI-Systemen gelöscht. Das Unternehmen wird jedoch bestimmte Chat-Protokolle aufbewahren und überprüfen, wenn sich herausstellt, dass sie schädliche oder unangemessene Inhalte enthalten.

Ein weiterer beliebter KI-Chatbot, Claude, verfolgt ebenfalls Ihre vorherigen Gespräche. Das Support-Center von Anthropic gibt an, dass Claude „Ihre Eingabeaufforderungen und Ausgaben im Produkt verfolgt , um Ihnen im Laufe der Zeit ein konsistentes Produkterlebnis unter Ihrer Kontrolle zu bieten“. Sie können Ihre Gespräche mit Claude löschen, sodass Claude vergisst, was Sie gesagt haben. Dies bedeutet jedoch nicht, dass Anthropic Ihre Protokolle sofort aus seinem System löscht.

Dies führt natürlich zu der Frage: Werden Ihre Daten gespeichert? Nutzen ChatGPT oder andere Chatbots Ihre Daten?

Aber die Bedenken hören hier nicht auf.

2. Datendiebstahl

Wie jedes Online-Tool oder jede Online-Plattform sind Chatbots anfällig für Cyberkriminelle. Selbst wenn ein Chatbot alles getan hat, um seine Benutzer und Daten zu schützen, besteht immer die Möglichkeit, dass ein erfahrener Hacker einen Weg findet, in seine internen Systeme einzudringen.

Wenn ein bestimmter Chatbot-Dienst Ihre sensiblen Informationen speichert, wie z. B. Zahlungsdetails für ein kostenpflichtiges Abonnement, Kontaktdaten oder ähnliche Informationen, könnten diese Informationen gestohlen und im Falle eines Cyberangriffs ausgenutzt werden.

Dies gilt insbesondere dann, wenn Sie einen weniger sicheren Chatbot verwenden, dessen Entwickler nicht in einen angemessenen Sicherheitsschutz investiert hat. Nicht nur die internen Systeme eines Unternehmens können gehackt werden, sondern auch Ihr eigenes Konto besteht ohne Anmeldewarnung oder Authentifizierungsebene dem Risiko, kompromittiert zu werden.

Da KI-Chatbots mittlerweile so beliebt sind, nutzen Cyberkriminelle diese Branche natürlich in Scharen für Betrug. Gefälschte ChatGPT-Websites und -Plugins sind zu einem großen Problem geworden, seit die Chatbots von OpenAI Ende 2022 populär wurden, was dazu führte, dass Menschen in Betrügereien verfielen und persönliche Informationen unter dem Deckmantel der Legitimität und Zuverlässigkeit preisgaben.

Im März 2023 berichtete MUO über eine gefälschte ChatGPT-Chrome-Erweiterung , die Facebook-Anmeldedaten stiehlt. Das Plugin kann die Hintertür von Facebook ausnutzen, um Premium-Konten zu hacken und die Cookies der Benutzer zu stehlen. Dies ist nur ein Beispiel für viele gefälschte ChatGPT-Dienste, die darauf abzielen, ahnungslose Opfer zu betrügen.

3. Malware-Infektion

Wenn Sie einen zwielichtigen Chatbot verwenden, ohne es zu merken, stellt Ihnen der Chatbot möglicherweise Links zu bösartigen Websites bereit. Vielleicht hat Sie der Chatbot auf ein tolles Gewinnspiel aufmerksam gemacht oder eine Quelle für eine seiner Antworten bereitgestellt. Wenn der Dienstbetreiber versteckte Absichten hat, besteht der Gesamtzweck der Plattform möglicherweise darin, Malware und Phishing über bösartige Links zu verbreiten.

Darüber hinaus könnten Hacker einen legitimen Chatbot-Dienst kompromittieren und ihn zur Verbreitung von Malware nutzen. Wenn dieser Chatbot wirklich menschlich wäre, wären Tausende oder sogar Millionen von Benutzern dieser Malware ausgesetzt. Im Apple App Store sind sogar gefälschte ChatGPT-Apps aufgetaucht, daher ist Vorsicht geboten.

Im Allgemeinen sollten Sie niemals auf einen Link klicken, den ein Chatbot bereitstellt, bevor Sie ihn über eine Website zur Linkprüfung laufen lassen. Das mag ärgerlich erscheinen, aber es ist am besten, sicherzustellen, dass die Website, auf die Sie weitergeleitet werden, kein bösartiges Design aufweist.

Darüber hinaus sollten Sie niemals Chatbot-Plugins und -Erweiterungen installieren, ohne zuvor deren Legitimität zu überprüfen. Machen Sie eine kleine Recherche rund um die App, um zu sehen, ob sie gute Bewertungen hat, und wenden Sie sich an den App-Entwickler, um zu sehen, ob Sie etwas Zwielichtiges finden können.

Das Gremium, das die nationalen Datenschutzbeauftragten Europas vereint, gab am Donnerstag bekannt, dass es eine Task Force für ChatGPT eingerichtet habe

Dänische und amerikanische Wissenschaftler haben gemeinsam ein KI-System namens life2vec entwickelt, das den Zeitpunkt des menschlichen Todes mit hoher Genauigkeit vorhersagen kann.

Ein KI-Algorithmus namens Audioflow kann auf das Geräusch des Urinierens hören, um abnormale Urinflüsse und entsprechende Gesundheitsprobleme des Patienten effektiv und erfolgreich zu identifizieren.

Japans alternde und schrumpfende Bevölkerung hat dazu geführt, dass dem Land eine erhebliche Zahl junger Arbeitskräfte fehlt, insbesondere im Dienstleistungssektor.

Ein Reddit-Benutzer namens u/LegalBeagle1966 ist einer von vielen Benutzern, die in Claudia verliebt sind, ein Mädchen wie ein Filmstar, das auf dieser Plattform oft verführerische Selfies, sogar nackte, teilt.

Microsoft hat gerade angekündigt, dass zwölf weitere Technologieunternehmen an seinem AI for Good-Programm teilnehmen werden.

Benutzer @mortecouille92 hat die Leistungsfähigkeit des Grafikdesign-Tools Midjourney genutzt und einzigartig realistische Versionen berühmter Dragon Ball-Charaktere wie Goku, Vegeta, Bulma und Elder Kame erstellt. .

Durch einfaches Hinzufügen einiger Bedingungen oder Einrichten einiger Szenarien kann ChatGPT relevantere Antworten auf Ihre Fragen geben. Schauen wir uns einige Möglichkeiten an, wie Sie die Qualität Ihrer ChatGPT-Antworten verbessern können.

Midjourney ist ein künstliches Intelligenzsystem, das aufgrund seiner äußerst schönen Gemälde, die denen echter Künstler in nichts nachstehen, in letzter Zeit in der Online-Community und der Künstlerwelt für „Fieber“ gesorgt hat.

Tage nachdem China den Ausbruch bekannt gegeben hatte, konnte das KI-System von BlueDot mit Zugriff auf weltweite Flugscheinverkaufsdaten die Ausbreitung des Wuhan-Corona-Virus nach Bangkok, Seoul, Taipeh und Tokio weiterhin genau vorhersagen.