Die ChatGPT-Task Force wird von Europa eingerichtet

Das Gremium, das die nationalen Datenschutzbeauftragten Europas vereint, gab am Donnerstag bekannt, dass es eine Task Force für ChatGPT eingerichtet habe

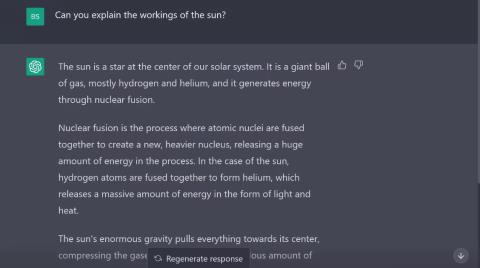

Die Popularität von KI-Chatbots hat zugenommen. Obwohl ihre Fähigkeiten beeindruckend sind, muss man sich darüber im Klaren sein, dass Chatbots nicht perfekt sind. Der Einsatz von KI-Chatbots birgt inhärente Risiken, wie etwa Datenschutzbedenken und potenzielle Cyberangriffe. Bei der Interaktion mit Chatbots ist Vorsicht geboten.

Lassen Sie uns die potenziellen Risiken des Informationsaustauschs mit KI-Chatbots untersuchen und sehen, welche Arten von Informationen ihnen nicht mitgeteilt werden sollten. Um Ihre Privatsphäre und Sicherheit zu gewährleisten, ist es wichtig, bei der Interaktion mit KI-Chatbots auf die folgenden 5 Dinge zu achten.

1. Finanzielle Details

Können Cyberkriminelle KI-Chatbots wie ChatGPT nutzen, um Ihr Bankkonto zu hacken? Mit der weit verbreiteten Verwendung von KI-Chatbots haben sich viele Benutzer für Ratschläge und persönliches Finanzmanagement an diese Sprachmodelle gewandt. Obwohl sie die Finanzkompetenz verbessern können, ist es wichtig, die potenziellen Risiken zu kennen, die mit der Weitergabe von Finanzinformationen über KI-Chatbots einhergehen.

Wenn Sie einen Chatbot als Finanzberater nutzen, riskieren Sie, dass Ihre Finanzinformationen potenziellen Cyberkriminellen preisgegeben werden, die diese Informationen ausnutzen könnten, um Geld von Ihren Konten abzuheben. Obwohl Unternehmen behaupten, Gesprächsdaten zu anonymisieren, haben Dritte und einige Mitarbeiter möglicherweise dennoch Zugriff auf diese Daten. Dies wirft Bedenken hinsichtlich der Profilerstellung auf, bei der Ihre Finanzdaten für böswillige Zwecke wie Ransomware-Kampagnen verwendet oder an Marketingagenturen verkauft werden könnten.

Um Ihre Finanzinformationen vor KI-Chatbots zu schützen, müssen Sie darauf achten, was Sie mit diesen generativen KI- Modellen teilen . Ihre Interaktionen sollten sich auf das Sammeln allgemeiner Informationen und das Stellen allgemeiner Fragen beschränken. Wenn Sie eine personalisierte Finanzberatung benötigen, gibt es möglicherweise bessere Optionen, als sich ausschließlich auf KI-Bots zu verlassen. Sie können ungenaue oder irreführende Informationen liefern und möglicherweise Ihr hart verdientes Geld gefährden. Ziehen Sie stattdessen in Betracht, sich von einem Finanzberater beraten zu lassen, der Ihnen eine angemessene und vertrauenswürdige Beratung bieten kann.

2. Ihre persönlichen und intimen Gedanken

Viele Benutzer wenden sich an KI-Chatbots, um eine Therapie in Anspruch zu nehmen, ohne sich der möglichen Folgen für ihre psychische Gesundheit bewusst zu sein. Es ist wichtig, die Gefahren der Offenlegung persönlicher und vertraulicher Informationen an diese Chatbots zu verstehen.

Erstens mangelt es Chatbots an praktischem Wissen und sie können nur allgemeine Antworten auf Fragen zur psychischen Gesundheit geben. Das bedeutet, dass die von ihnen empfohlenen Medikamente oder Behandlungen möglicherweise nicht für Ihre spezifischen Bedürfnisse geeignet sind und Ihrer Gesundheit schaden könnten.

Darüber hinaus wirft der Austausch persönlicher Gedanken mit KI-Chatbots Datenschutzbedenken auf. Ihre Privatsphäre kann verletzt werden, da Geheimnisse und intime Gedanken online preisgegeben werden können. Böswillige Personen könnten diese Informationen ausnutzen, um Sie auszuspionieren oder Ihre Daten im Darknet zu verkaufen . Daher ist der Schutz der Privatsphäre persönlicher Gedanken bei der Interaktion mit KI-Chatbots äußerst wichtig.

Es ist wichtig, KI-Chatbots als allgemeines Informations- und Unterstützungstool zu betrachten und sie nicht als alternative Optionen für eine professionelle Therapie zu betrachten. Wenn Sie eine Beratung oder Behandlung zur psychischen Gesundheit benötigen, sollten Sie immer einen qualifizierten Arzt konsultieren. Sie können eine personalisierte und vertrauenswürdige Beratung bieten und dabei Ihre Privatsphäre und Ihr Wohlbefinden in den Vordergrund stellen.

3. Vertrauliche Informationen über Ihren Arbeitsplatz

Ein weiterer Fehler, den Benutzer bei der Interaktion mit KI-Chatbots vermeiden müssen, ist die Weitergabe vertraulicher arbeitsbezogener Informationen. Sogar berühmte Technologiegiganten wie Apple, Samsung, JPMorgan und Google, der Erfinder von Bard, haben ihren Mitarbeitern den Einsatz von KI-Chatbots am Arbeitsplatz untersagt .

Ein Bloomberg-Bericht beleuchtete den Fall, dass Samsung-Mitarbeiter ChatGPT zum Programmieren nutzten und versehentlich sensiblen Code auf die Generative AI-Plattform hochluden. Dieser Vorfall führte zur unbefugten Offenlegung vertraulicher Informationen über Samsung und veranlasste das Unternehmen, ein Verbot des Einsatzes von KI-Chatbots durchzusetzen. Als Entwickler, der KI-Unterstützung zur Lösung von Programmierproblemen sucht, sollten Sie KI-Chatbots wie ChatGPT aus folgenden Gründen keine vertraulichen Informationen anvertrauen. Bei der Weitergabe sensiblen Codes oder arbeitsbezogener Details ist Vorsicht geboten.

Ebenso verlassen sich viele Mitarbeiter auf KI-Chatbots, um Besprechungsprotokolle zusammenzufassen oder sich wiederholende Aufgaben zu automatisieren, wodurch das Risiko besteht, dass vertrauliche Daten versehentlich preisgegeben werden. Daher ist es äußerst wichtig, die Vertraulichkeit vertraulicher Arbeitsinformationen zu wahren und deren Weitergabe an KI-Chatbots einzuschränken.

Benutzer können ihre sensiblen Informationen und ihre Organisation vor unbeabsichtigten Datenlecks oder -verstößen schützen, indem sie sich der Risiken bewusst sind, die mit der berufsbezogenen Datenfreigabe verbunden sind.

4. Passwort

Es ist wichtig zu betonen, dass die Weitergabe Ihrer Passwörter online, auch mit Sprachmodellen, ein absolutes Tabu ist. Diese Modelle speichern Ihre Daten auf öffentlichen Servern und die Offenlegung Ihres Passworts gegenüber ihnen gefährdet Ihre Privatsphäre. Im Falle eines Serververstoßes können Hacker auf Ihre Passwörter zugreifen und diese ausnutzen, um finanziellen Schaden anzurichten.

Im Mai 2022 kam es zu einem schwerwiegenden Datenverstoß im Zusammenhang mit ChatGPT, der ernsthafte Bedenken hinsichtlich der Sicherheit der Chatbot-Plattform aufkommen ließ. Darüber hinaus wurde ChatGPT in Italien aufgrund der Datenschutz-Grundverordnung (DSGVO) der Europäischen Union verboten. Italienische Aufsichtsbehörden sagen, dass KI-Chatbots nicht den Datenschutzgesetzen entsprechen, und weisen auf das Risiko von Datenschutzverletzungen auf der Plattform hin. Daher ist der Schutz Ihrer Anmeldedaten vor KI-Chatbots von größter Bedeutung.

Indem Sie die Weitergabe Ihrer Passwörter mit diesen Chatbot-Modellen einschränken, können Sie Ihre persönlichen Daten proaktiv schützen und Ihr Risiko, Opfer von Cyber-Bedrohungen zu werden, verringern. Denken Sie daran, dass der Schutz Ihrer Anmeldeinformationen ein wesentlicher Schritt zur Wahrung Ihrer Privatsphäre und Sicherheit im Internet ist.

5. Angaben zur Unterkunft und andere personenbezogene Daten

Es ist wichtig, keine personenbezogenen Daten (PII) an KI-Chatbots weiterzugeben. PII umfasst sensible Daten, die zur Identifizierung oder Lokalisierung Ihrer Person verwendet werden können, einschließlich Ihres Standorts, Ihrer Sozialversicherungsnummer, Ihres Geburtsdatums und Ihrer Gesundheitsinformationen. Die Gewährleistung der Vertraulichkeit persönlicher und wohnlicher Daten bei der Interaktion mit KI-Chatbots hat oberste Priorität.

Um die Vertraulichkeit Ihrer persönlichen Daten bei der Interaktion mit KI-Chatbots zu wahren, sollten Sie folgende wichtige Vorgehensweisen befolgen:

Das Gremium, das die nationalen Datenschutzbeauftragten Europas vereint, gab am Donnerstag bekannt, dass es eine Task Force für ChatGPT eingerichtet habe

Dänische und amerikanische Wissenschaftler haben gemeinsam ein KI-System namens life2vec entwickelt, das den Zeitpunkt des menschlichen Todes mit hoher Genauigkeit vorhersagen kann.

Ein KI-Algorithmus namens Audioflow kann auf das Geräusch des Urinierens hören, um abnormale Urinflüsse und entsprechende Gesundheitsprobleme des Patienten effektiv und erfolgreich zu identifizieren.

Japans alternde und schrumpfende Bevölkerung hat dazu geführt, dass dem Land eine erhebliche Zahl junger Arbeitskräfte fehlt, insbesondere im Dienstleistungssektor.

Ein Reddit-Benutzer namens u/LegalBeagle1966 ist einer von vielen Benutzern, die in Claudia verliebt sind, ein Mädchen wie ein Filmstar, das auf dieser Plattform oft verführerische Selfies, sogar nackte, teilt.

Microsoft hat gerade angekündigt, dass zwölf weitere Technologieunternehmen an seinem AI for Good-Programm teilnehmen werden.

Benutzer @mortecouille92 hat die Leistungsfähigkeit des Grafikdesign-Tools Midjourney genutzt und einzigartig realistische Versionen berühmter Dragon Ball-Charaktere wie Goku, Vegeta, Bulma und Elder Kame erstellt. .

Durch einfaches Hinzufügen einiger Bedingungen oder Einrichten einiger Szenarien kann ChatGPT relevantere Antworten auf Ihre Fragen geben. Schauen wir uns einige Möglichkeiten an, wie Sie die Qualität Ihrer ChatGPT-Antworten verbessern können.

Midjourney ist ein künstliches Intelligenzsystem, das aufgrund seiner äußerst schönen Gemälde, die denen echter Künstler in nichts nachstehen, in letzter Zeit in der Online-Community und der Künstlerwelt für „Fieber“ gesorgt hat.

Tage nachdem China den Ausbruch bekannt gegeben hatte, konnte das KI-System von BlueDot mit Zugriff auf weltweite Flugscheinverkaufsdaten die Ausbreitung des Wuhan-Corona-Virus nach Bangkok, Seoul, Taipeh und Tokio weiterhin genau vorhersagen.