Die ChatGPT-Task Force wird von Europa eingerichtet

Das Gremium, das die nationalen Datenschutzbeauftragten Europas vereint, gab am Donnerstag bekannt, dass es eine Task Force für ChatGPT eingerichtet habe

Trotz der beeindruckenden Fähigkeiten von ChatGPT haben mehrere große Unternehmen ihren Mitarbeitern die Nutzung dieses KI-Chatbots verboten.

Im Mai 2023 verbot Samsung die Verwendung von ChatGPT und anderen generativen KI- Tools . Dann, im Juni 2023, führte auch die australische Commonwealth Bank zusammen mit Unternehmen wie Amazon, Apple und JPMorgan Chase & Co die Beschränkung ein. Auch einige Krankenhäuser, Anwaltskanzleien und Regierungsbehörden haben ihren Mitarbeitern die Nutzung von ChatGPT untersagt.

Warum verbieten immer mehr Unternehmen ChatGPT? Hier sind 5 Hauptgründe.

1. Datenleck

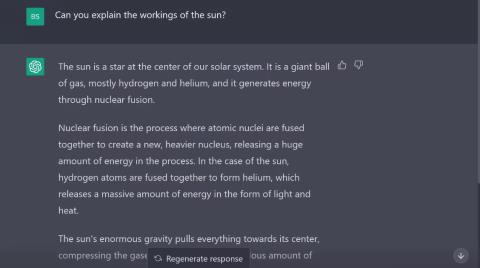

ChatGPT erfordert eine große Datenmenge, um effektiv trainieren und arbeiten zu können. Der Chatbot wurde mithilfe riesiger Datenmengen aus dem Internet trainiert und wird auch weiterhin trainiert.

Laut der Hilfeseite von OpenAI kann jedes Datenelement, einschließlich vertraulicher Kundendaten, Geschäftsgeheimnisse und sensibler Geschäftsinformationen, das Sie dem Chatbot zur Verfügung stellen, überprüft und zur Verbesserung des Systems verwendet werden.

Richten Sie die Multi-Faktor-Authentifizierung auf ChatGPT ein

Viele Unternehmen unterliegen strengen Datenschutzbestimmungen. Daher sind sie bei der Weitergabe personenbezogener Daten an externe Stellen vorsichtig, da dies das Risiko von Datenlecks erhöht.

Darüber hinaus bietet OpenAI keine Garantie für einwandfreie Sicherheit und Datenschutz. Im März 2023 bestätigte OpenAI einen Fehler, der es einigen Benutzern ermöglichte, Chattitel im Verlauf anderer aktiver Benutzer anzuzeigen. Obwohl dieser Fehler behoben wurde und OpenAI ein Bug-Bounty-Programm gestartet hat, übernimmt das Unternehmen keine Garantie für die Sicherheit und den Datenschutz der Benutzerdaten.

Viele Unternehmen entscheiden sich dafür, ihren Mitarbeitern die Nutzung von ChatGPT zu verbieten, um Datenschutzverletzungen zu vermeiden, die den Ruf schädigen, zu finanziellen Verlusten führen und ihre Kunden und Mitarbeiter gefährden können.

2. Cyber-Sicherheitsrisiken

Obwohl unklar ist, ob ChatGPT tatsächlich anfällig für Cybersicherheitsrisiken ist, ist es möglich, dass der Einsatz innerhalb einer Organisation potenzielle Schwachstellen schaffen könnte, die von Cyberangreifern ausgenutzt werden könnten.

Wenn ein Unternehmen ChatGPT integriert und es eine Schwachstelle im Sicherheitssystem des Chatbots gibt, können Angreifer die Schwachstelle ausnutzen und ihn mit Schadsoftware infizieren. Darüber hinaus ist die Fähigkeit von ChatGPT, menschenähnliche Antworten zu generieren, ein „goldenes Ei“ für Phishing-Angreifer, die Konten übernehmen oder sich als legitime Entitäten ausgeben können, um Unternehmensmitarbeiter zur Weitergabe vertraulicher Informationen zu verleiten.

3. Erstellen Sie personalisierte Chatbots

Trotz seiner innovativen Funktionen kann ChatGPT falsche und irreführende Informationen erzeugen. Daher haben viele Unternehmen KI-Chatbots für Arbeitszwecke entwickelt. Beispielsweise hat die australische Commonwealth Bank ihre Mitarbeiter gebeten, Gen.ai zu verwenden, einen Chatbot mit künstlicher Intelligenz (KI) , der CommBank-Informationen verwendet, um Antworten zu geben.

Unternehmen wie Samsung und Amazon haben fortschrittliche Modelle für natürliche Sprache entwickelt, sodass Unternehmen auf der Grundlage vorhandener Transkripte problemlos personalisierte Chatbots erstellen und bereitstellen können. Mit diesen hauseigenen Chatbots können Sie rechtliche und rufschädigende Konsequenzen im Zusammenhang mit Datenmissbrauch verhindern.

4. Fehlende Vorschriften

In Branchen, in denen Unternehmen Protokollen und Sanktionen unterliegen, ist der Mangel an regulatorischen Leitlinien bei ChatGPT ein Warnsignal. Ohne genaue rechtliche Bedingungen für die Nutzung von ChatGPT könnten Unternehmen schwerwiegende rechtliche Konsequenzen haben, wenn sie KI-Chatbots für ihre Geschäftstätigkeit einsetzen.

Darüber hinaus kann ein Mangel an Regulierung die Rechenschaftspflicht und Transparenz von Unternehmen beeinträchtigen. Für die meisten Unternehmen kann es verwirrend sein, ihren Kunden Entscheidungsprozesse und Sicherheitsmaßnahmen für KI-Sprachmodelle zu erklären.

Unternehmen schränken ChatGPT ein, weil sie befürchten, dass es zu Verstößen gegen Datenschutzgesetze und branchenspezifische Vorschriften kommen könnte.

5. Verantwortungsloser Gebrauch durch Mitarbeiter

In vielen Unternehmen verlassen sich einige Mitarbeiter ausschließlich auf ChatGPT-Antworten, um Inhalte zu erstellen und ihre Aufgaben auszuführen. Dies führt zu Faulheit im Arbeitsumfeld und unterdrückt Kreativität und Innovation.

Sich auf KI zu verlassen, kann Ihre Fähigkeit zum kritischen Denken beeinträchtigen. Es kann auch dem Ruf eines Unternehmens schaden, da ChatGPT häufig ungenaue und unzuverlässige Daten liefert.

Obwohl ChatGPT ein leistungsstarkes Tool ist, kann seine Verwendung zur Lösung komplexer Anfragen, die domänenspezifisches Fachwissen erfordern, den Betrieb und die Effizienz eines Unternehmens beeinträchtigen. Einige Mitarbeiter denken möglicherweise nicht daran, die von KI-Chatbots bereitgestellten Antworten auf Fakten zu prüfen und zu verifizieren, da sie die von ChatGPT bereitgestellten Antworten als eine Einheitslösung betrachten.

Um Probleme wie diese abzumildern, verbieten Unternehmen Chatbots, damit sich die Mitarbeiter auf ihre Aufgaben konzentrieren und den Benutzern fehlerfreie Lösungen anbieten können.

Das Gremium, das die nationalen Datenschutzbeauftragten Europas vereint, gab am Donnerstag bekannt, dass es eine Task Force für ChatGPT eingerichtet habe

Dänische und amerikanische Wissenschaftler haben gemeinsam ein KI-System namens life2vec entwickelt, das den Zeitpunkt des menschlichen Todes mit hoher Genauigkeit vorhersagen kann.

Ein KI-Algorithmus namens Audioflow kann auf das Geräusch des Urinierens hören, um abnormale Urinflüsse und entsprechende Gesundheitsprobleme des Patienten effektiv und erfolgreich zu identifizieren.

Japans alternde und schrumpfende Bevölkerung hat dazu geführt, dass dem Land eine erhebliche Zahl junger Arbeitskräfte fehlt, insbesondere im Dienstleistungssektor.

Ein Reddit-Benutzer namens u/LegalBeagle1966 ist einer von vielen Benutzern, die in Claudia verliebt sind, ein Mädchen wie ein Filmstar, das auf dieser Plattform oft verführerische Selfies, sogar nackte, teilt.

Microsoft hat gerade angekündigt, dass zwölf weitere Technologieunternehmen an seinem AI for Good-Programm teilnehmen werden.

Benutzer @mortecouille92 hat die Leistungsfähigkeit des Grafikdesign-Tools Midjourney genutzt und einzigartig realistische Versionen berühmter Dragon Ball-Charaktere wie Goku, Vegeta, Bulma und Elder Kame erstellt. .

Durch einfaches Hinzufügen einiger Bedingungen oder Einrichten einiger Szenarien kann ChatGPT relevantere Antworten auf Ihre Fragen geben. Schauen wir uns einige Möglichkeiten an, wie Sie die Qualität Ihrer ChatGPT-Antworten verbessern können.

Midjourney ist ein künstliches Intelligenzsystem, das aufgrund seiner äußerst schönen Gemälde, die denen echter Künstler in nichts nachstehen, in letzter Zeit in der Online-Community und der Künstlerwelt für „Fieber“ gesorgt hat.

Tage nachdem China den Ausbruch bekannt gegeben hatte, konnte das KI-System von BlueDot mit Zugriff auf weltweite Flugscheinverkaufsdaten die Ausbreitung des Wuhan-Corona-Virus nach Bangkok, Seoul, Taipeh und Tokio weiterhin genau vorhersagen.