Die ChatGPT-Task Force wird von Europa eingerichtet

Das Gremium, das die nationalen Datenschutzbeauftragten Europas vereint, gab am Donnerstag bekannt, dass es eine Task Force für ChatGPT eingerichtet habe

Vielleicht haben Sie von FaceApp gehört, einer mobilen Fotobearbeitungsanwendung, die weltweit große Beachtung findet und die Möglichkeit bietet, mithilfe künstlicher Intelligenz (KI) Selfies mit einem extrem hohen Maß an Authentizität zu bearbeiten. Or This Person Does Not Exist, eine weitere Fotobearbeitungs-App, mit der interessante Porträts auf der Grundlage fiktiver computergenerierter Grafikfiguren erstellt werden können. Dies sind nur zwei von vielen großartigen Anwendungen, bei denen KI bei Aufgaben im Zusammenhang mit der Fotobearbeitung und -erstellung zum Einsatz kommt. Wie sieht es also mit der Videobearbeitung aus?

Kürzlich kündigte DeepMind, eine Tochtergesellschaft von Alphabet, die hauptsächlich im Bereich der Entwicklung künstlicher Intelligenz tätig ist, eine völlig neue Erfindung mit dem Namen „Effiziente Videogenerierung auf komplexen Datensätzen“ an. (Video basiert effektiv auf komplexen Datensätzen) und verspricht viele Änderungen in der Bereich der Videobearbeitung und Postproduktion. Hierbei handelt es sich im Grunde um einen KI-Algorithmus, der lernen kann, aus den Videos, denen er während des Trainingsprozesses ausgesetzt war, einfache Clips zu erstellen.

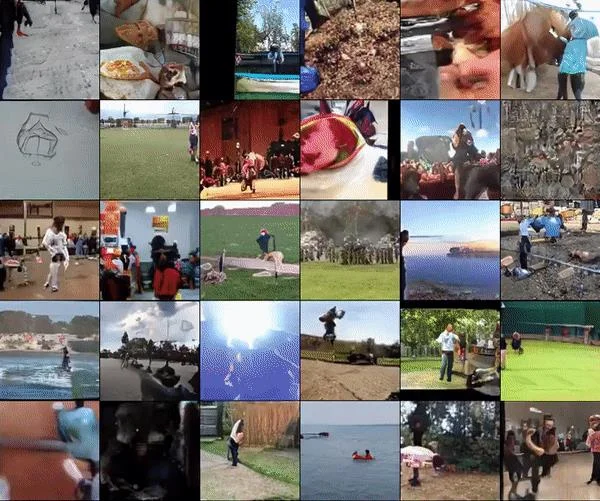

DVD-GAN kann jetzt automatisch Beispielvideos mit vollständigen Objektlayouts generieren

DVD-GAN kann jetzt automatisch Beispielvideos mit vollständigen Objektlayouts generieren

Forscher von DeepMind sagten, dass ihr bisher leistungsstärkstes Modell – Dual Video Discriminator GAN (DVD-GAN) – Videos mit einer Auflösung von 256 x 256 Pixeln in Kombination mit hoher Auflösung erstellen konnte. Die Wiedergabetreue ist lobenswert und die Länge ist gestiegen bis 48 Bilder.

„Die Erstellung von Videos mit einem hohen Maß an Natürlichkeit und Realismus ist die größte Herausforderung für heutige KI-Modelle. Unter ihnen sind die größten Hemmfaktoren nichts anderes als die Komplexität der Datenerfassungs- und Berechnungsanforderungen. Aus diesem Grund drehten sich viele Jobs im Zusammenhang mit der Videoerstellung in der Vergangenheit oft um relativ einfache Datensätze oder Aufgaben, bei denen Echtzeitinformationen verfügbar waren. Derzeit konzentrieren wir uns auf Videosynthese- und Vorhersageaufgaben und wollen die Ergebnisse der heute führenden KI-Modelle zur Bilderzeugung auf Videos ausweiten – die komplexe Seite ist viel besser“, sagte ein Vertreter des Forschungsteams.

Das Team baute sein System auf der Grundlage einer fortschrittlichen KI-Architektur auf und führte gleichzeitig eine Reihe videospezifischer Optimierungen ein, wodurch der Trainingsprozess auf der Grundlage von Kinetic-600 durchgeführt werden konnte. Der Datensatz umfasst „natürliche“ Videos, die viel größer sind Maßstab als üblich. Insbesondere haben Forscher generative kontradiktorische Netzwerke (GANs) genutzt.

Falls Sie es nicht wissen: GAN ist ein KI-System, das aus zwei separaten Teilen besteht: Der erste ist ein generatives Netzwerk, das bei der Erstellung von Trainingsbeispielen (gefälschten Daten) hilft, mit dem Ziel, Trainingsdaten so realistisch wie möglich zu gestalten . Und das zweite ist das Netzwerk „Discriminative“, das versucht, zwischen echten Daten und gefälschten Daten zu unterscheiden. GAN-Systeme wurden bei vielen intensiven Aufgaben eingesetzt, beispielsweise bei der Umwandlung von Bildunterschriften in kontextbezogene Geschichten, insbesondere bei der Erstellung künstlicher Fotos mit extrem hohem Realismus.

DVD-GAN enthält duale diskriminierende Netzwerke: Der diskriminierende Algorithmus kann Unterschiede im Inhalt und in der Struktur eines einzelnen Frames aufdecken, indem er Frames in voller Auflösung zufällig abtastet und sie dann verarbeitet. Die individuelle und differenzierte Verarbeitung über die Zeit liefert Lernhinweise für die Erzeugung von Bewegung. Ein einziges Modul – Transformer genannt – ermöglicht die Verteilung gelernter Daten und Informationen über das gesamte KI-Modell.

Beim Kinetic-600-Trainingskorpus handelt es sich im Wesentlichen um einen riesigen Datensatz, der aus über 500.000 hochauflösenden YouTube-Clips mit einer Dauer von nicht mehr als 10 Sekunden zusammengestellt wurde. Diese Videos wurden ursprünglich kuratiert, um menschliche Handlungen zu erkennen, wobei Forscher dieses Korpus als „vielfältig“ und „uneingeschränkt“ beschrieben, Faktoren, die im Training besonders relevant sind. Offene Modelle ähnlich dem DVD-GAN von DeepMind. (Im Bereich des maschinellen Lernens gibt es den Begriff „Überanpassung“, der sich auf Modelle bezieht, die zu genau an einen bestimmten Datensatz passen und daher die Beobachtungen in den Daten nicht zuverlässig vorhersagen können.) .

Laut dem Bericht des Forschungsteams ist DVD-GAN nun in der Lage, selbst Videos zu generieren, nachdem es von Googles Tensor Processing Units-System der 3. Generation über einen Zeitraum von 12 bis 96 Stunden kontinuierlich trainiert wurde. Das Modell verfügt über vollständige Objektlayouts, Bewegungen und sogar komplexe Strukturen wie Reflexionen auf Flussoberflächen, Eisbahnen ... DVD-GAN musste sich mit der Erstellung komplexer Objekte in diesem Bereich „mühen“. Höhere Auflösung, bei der Bewegung eine viel größere Anzahl von Pixeln umfasst. Die Forscher stellten jedoch fest, dass die von DVD-GAN generierten Videobeispiele nach der Auswertung auf UCF-101 (einem kleineren Datensatz von 13.320 Videos menschlicher Handlungen) gut abgeschnitten haben. Der Inception Score liegt bei 32,97 – überhaupt nicht schlecht.

„In Zukunft möchten wir die Vorteile des Trainings generativer Modelle auf großen und komplexen Videodatensätzen wie Kinetic-600 weiter hervorheben. „Obwohl es noch viel Arbeit zu tun gibt, bevor realistische Videos in einer uneingeschränkten Bandbreite an Einstellungen konsistent generiert werden können, glauben wir, dass DVD-GAN das perfekte Sprungbrett ist, um diesen Traum wahr werden zu lassen“, sagte ein Vertreter der Forschungsgruppe.

Was denken Sie über das DVD-GAN AI-Modell von DeepMind? Bitte hinterlassen Sie unten Ihre Kommentare!

Das Gremium, das die nationalen Datenschutzbeauftragten Europas vereint, gab am Donnerstag bekannt, dass es eine Task Force für ChatGPT eingerichtet habe

Dänische und amerikanische Wissenschaftler haben gemeinsam ein KI-System namens life2vec entwickelt, das den Zeitpunkt des menschlichen Todes mit hoher Genauigkeit vorhersagen kann.

Ein KI-Algorithmus namens Audioflow kann auf das Geräusch des Urinierens hören, um abnormale Urinflüsse und entsprechende Gesundheitsprobleme des Patienten effektiv und erfolgreich zu identifizieren.

Japans alternde und schrumpfende Bevölkerung hat dazu geführt, dass dem Land eine erhebliche Zahl junger Arbeitskräfte fehlt, insbesondere im Dienstleistungssektor.

Ein Reddit-Benutzer namens u/LegalBeagle1966 ist einer von vielen Benutzern, die in Claudia verliebt sind, ein Mädchen wie ein Filmstar, das auf dieser Plattform oft verführerische Selfies, sogar nackte, teilt.

Microsoft hat gerade angekündigt, dass zwölf weitere Technologieunternehmen an seinem AI for Good-Programm teilnehmen werden.

Benutzer @mortecouille92 hat die Leistungsfähigkeit des Grafikdesign-Tools Midjourney genutzt und einzigartig realistische Versionen berühmter Dragon Ball-Charaktere wie Goku, Vegeta, Bulma und Elder Kame erstellt. .

Durch einfaches Hinzufügen einiger Bedingungen oder Einrichten einiger Szenarien kann ChatGPT relevantere Antworten auf Ihre Fragen geben. Schauen wir uns einige Möglichkeiten an, wie Sie die Qualität Ihrer ChatGPT-Antworten verbessern können.

Midjourney ist ein künstliches Intelligenzsystem, das aufgrund seiner äußerst schönen Gemälde, die denen echter Künstler in nichts nachstehen, in letzter Zeit in der Online-Community und der Künstlerwelt für „Fieber“ gesorgt hat.

Tage nachdem China den Ausbruch bekannt gegeben hatte, konnte das KI-System von BlueDot mit Zugriff auf weltweite Flugscheinverkaufsdaten die Ausbreitung des Wuhan-Corona-Virus nach Bangkok, Seoul, Taipeh und Tokio weiterhin genau vorhersagen.