Die ChatGPT-Task Force wird von Europa eingerichtet

Das Gremium, das die nationalen Datenschutzbeauftragten Europas vereint, gab am Donnerstag bekannt, dass es eine Task Force für ChatGPT eingerichtet habe

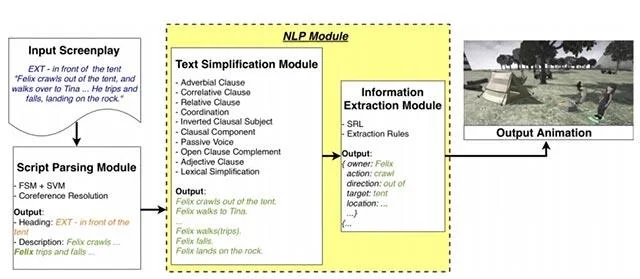

Realistisch gesehen ist die Tatsache, dass KI aus einem oder mehreren Textteilen Originalclips erstellen kann, in der Technologiewelt keine seismische Neuigkeit. Letztes Jahr haben Forscher detailliert beschrieben, wie ein System neuronale Netze – Schichten mathematischer Funktionen, die biologischen neuronalen Netzen (Neuronen) nachempfunden sind – nutzt, um Informationsschnipsel zu erstellen. Das Video ist 32 Bilder lang und 64 × 64 Pixel groß und enthält viele eindrucksvolle Beschreibungen, wie z als „Fußball spielen auf dem Rasen“. Laut einem neuen Artikel, der auf Arxiv.org veröffentlicht wurde, ist es Wissenschaftlern von Disney Research und Rutgers jedoch gelungen, diese Idee mit einem Kreuzworträtsel-KI-Modell noch einen Schritt weiter zu entwickeln. Von Anfang bis Ende ist es möglich, eine grobe Handlung zu erstellen sowie Videobeschreibungen von Texten aus Drehbüchern. Konkret hilft das Text-to-Animation-Modell der Wissenschaftler dabei, Animationen zu erstellen, ohne dass Anmerkungsdaten erforderlich sind – ein vorläufiger Schritt, der verwendet wird, um beschreibenden Eingabetext für Aktivitäten bereitzustellen.

„Die automatische Generierung von Animationen aus Text in natürlicher Sprache ist eine sehr nützliche Technologie, die in einer Reihe von Bereichen eingesetzt werden kann, beispielsweise beim Schreiben von Drehbüchern oder beim Erstellen von Lehrvideos. Diese KI-Systeme werden besonders wertvoll sein, wenn sie auf die Skripterstellung angewendet werden, da sie eine schnellere Iteration, Prototyping und Proof of Concept ermöglichen. Im Rahmen dieser Forschung haben wir erfolgreich ein Text-zu-Animation-System entwickelt, das in der Lage ist, komplexe Sätze zufriedenstellend zu verarbeiten. Der Zweck dieses KI-Systems besteht nicht darin, Autoren oder Drehbuchautoren vollständig zu ersetzen, sondern darin, einen KI-Assistenten zu schaffen, der die Arbeit von Drehbuchautoren effektiv unterstützen und einfacher machen kann. Interessanter“, teilte das Forschungsteam mit.

Wie die Forscher erklärten, ist die Übersetzung von Text in Animationen keine einfache Aufgabe. Tatsächlich haben sowohl Sätze (Eingabedaten) als auch Animationen (Ausgabedaten) keine feste Struktur. Dies ist auch der Grund, warum die meisten aktuellen Text-to-Video-Tools komplexe Satzmuster nicht verarbeiten können. Um die Einschränkungen aktueller Systeme anzugehen, baute das Forschungsteam ein modulares neuronales Netzwerk auf, das eine Reihe von Komponenten umfasst, wie zum Beispiel: Ein neues Skript-Parsing-Modul, das relevanten Text automatisch dynamisch aus Szenenbeschreibungen im Skript isoliert; ein Modul zur Verarbeitung natürlicher Sprache, das komplexe Satzmuster mithilfe einer Reihe von Sprachregeln vereinfacht und Informationen aus den vereinfachten Sätzen in vordefinierte Aktionsdarstellungen extrahiert; und ein Animationsmodul, das für die Umwandlung der Darstellungen in mehrere Animationssequenzen verantwortlich ist.

Laut den Forschern erleichtert dieser vereinfachte Ansatz das Extrahieren wichtiger Skriptinformationen erheblich, und ihr System wird in der Lage sein, automatisch zu erkennen, wann ein Codeabschnitt eine bestimmte syntaktische Struktur aufweist, ihn dann zu zerlegen und in einfachere Sätze zusammenzusetzen rekursive Verarbeitung, bis keine weitere Vereinfachung mehr möglich ist. Der nächste „Koordinationsschritt“ wird auf Sätze angewendet, die die gleiche syntaktische Beziehung haben und gleichzeitig die gleiche funktionale Rolle erfüllen. Und schließlich wird ein Vokabelsimulator, der den in Sätzen beschriebenen Aktionen entspricht, mit 52 verschiedenen Animationen (die mithilfe eines Synonymwörterbuchs auf 92 Animationen erweitert werden können) in einer vordefinierten Bibliothek vereinfacht.

Ein System namens Cardinal verwendet diese Animationen dann als Eingabe für Aktionen und erstellt Vorvisualisierungen in Unreal – einer beliebten Videospiel-Engine, die von Epic Games entwickelt wurde. Basierend auf der vordefinierten Animationsbibliothek werden die Objekte und auch die Modelle, die zum Erstellen von Charakteren verwendet werden können, vorab geladen und helfen so, 3D-Animationsvideos zu erstellen, die das verarbeitete Szenario möglichst genau wiedergeben.

Um dieses überlegene System zu trainieren, begannen die Forscher mit der Zusammenstellung einer Szenenbeschreibungsdatenbank, die aus 996 Szenarien besteht und sich auf mehr als 1.000 Skripte aus frei verfügbaren Quellen stützt. Dazu gehören IMSDb, SimplyScripts und ScriptORama5. Insgesamt umfasst dieses Korpus 525.708 Beschreibungen mit 1.402.864 Sätzen, von denen 920.817 (mehr als 40 %) mindestens ein Verb enthalten, das eine Handlung beschreibt.

In einem qualitativen Experiment baten die Wissenschaftler 22 Teilnehmer, 20 systemgenerierte Animationen auf einer 5-Punkte-Skala zu bewerten (z. B. Ist das gezeigte Video angesichts des Textinhalts angemessen animiert? Text? Oder wie viele Textinformationen wurden im Video beschrieben). und wie viele Informationen im Video im Text erwähnt wurden), gaben 68 % der Teilnehmer an, dass das System effektive Animationen erstellt hat. Fairer Wert aus den Eingabeszenarien – keine besonders hohe Quote, aber sehr lobenswert.

Das zeigt, dass es sich hier nicht um ein wirklich perfektes System handelt. Tatsächlich ist die Liste der Aktionen und ihrer Objekte nicht vollständig, und manchmal kann der Prozess der lexikalischen Vereinfachung komplexe Verben nicht erfolgreich ähnlichen Animatoren zuordnen, oder es können nur wenige einfache Sätze für ein Verb erstellt werden, das im Originalsatz mehrere Subjekte hat . Allerdings handelt es sich hierbei noch um eine junge Studie und solche Einschränkungen sind völlig verständlich. Die Forscher beabsichtigen, die oben genannten Mängel in naher Zukunft zu beheben.

„Interne und externe Bewertungen haben eine angemessene Leistung dieses Systems gezeigt, und wir wollten Diskursinformationen nutzen, indem wir die in Textfragmenten beschriebene Abfolge von Aktionen untersuchten. Dies wird auch dazu beitragen, Unklarheiten im Text bezüglich der Maßnahmen zu beseitigen. Darüber hinaus kann unser System verwendet werden, um die Daten zu generieren, die zum Trainieren ähnlicher neuronaler End-to-End-Systeme erforderlich sind“, sagte das Team.

Das Gremium, das die nationalen Datenschutzbeauftragten Europas vereint, gab am Donnerstag bekannt, dass es eine Task Force für ChatGPT eingerichtet habe

Dänische und amerikanische Wissenschaftler haben gemeinsam ein KI-System namens life2vec entwickelt, das den Zeitpunkt des menschlichen Todes mit hoher Genauigkeit vorhersagen kann.

Ein KI-Algorithmus namens Audioflow kann auf das Geräusch des Urinierens hören, um abnormale Urinflüsse und entsprechende Gesundheitsprobleme des Patienten effektiv und erfolgreich zu identifizieren.

Japans alternde und schrumpfende Bevölkerung hat dazu geführt, dass dem Land eine erhebliche Zahl junger Arbeitskräfte fehlt, insbesondere im Dienstleistungssektor.

Ein Reddit-Benutzer namens u/LegalBeagle1966 ist einer von vielen Benutzern, die in Claudia verliebt sind, ein Mädchen wie ein Filmstar, das auf dieser Plattform oft verführerische Selfies, sogar nackte, teilt.

Microsoft hat gerade angekündigt, dass zwölf weitere Technologieunternehmen an seinem AI for Good-Programm teilnehmen werden.

Benutzer @mortecouille92 hat die Leistungsfähigkeit des Grafikdesign-Tools Midjourney genutzt und einzigartig realistische Versionen berühmter Dragon Ball-Charaktere wie Goku, Vegeta, Bulma und Elder Kame erstellt. .

Durch einfaches Hinzufügen einiger Bedingungen oder Einrichten einiger Szenarien kann ChatGPT relevantere Antworten auf Ihre Fragen geben. Schauen wir uns einige Möglichkeiten an, wie Sie die Qualität Ihrer ChatGPT-Antworten verbessern können.

Midjourney ist ein künstliches Intelligenzsystem, das aufgrund seiner äußerst schönen Gemälde, die denen echter Künstler in nichts nachstehen, in letzter Zeit in der Online-Community und der Künstlerwelt für „Fieber“ gesorgt hat.

Tage nachdem China den Ausbruch bekannt gegeben hatte, konnte das KI-System von BlueDot mit Zugriff auf weltweite Flugscheinverkaufsdaten die Ausbreitung des Wuhan-Corona-Virus nach Bangkok, Seoul, Taipeh und Tokio weiterhin genau vorhersagen.