MicrosoftTeamsのファイルがファイルフォルダーに表示されない[修正済み]

![MicrosoftTeamsのファイルがファイルフォルダーに表示されない[修正済み] MicrosoftTeamsのファイルがファイルフォルダーに表示されない[修正済み]](https://cdn.luckytemplates.com/resources8/images2m/image-8766-1221165807743.webp)

Microsoft Teamsでファイルが表示されない問題を解決するための手順を詳しく解説します。特にSharePointフォルダーやユーザー制限に関連する解決策を紹介します。

ChatGPTやその他の言語学習テクノロジーは強力なツールとして台頭しており、ヘルスケアなどの分野に影響を与え始めたばかりです。ただし、これらのツールを使用する場合は、自分の健康に関して注意することが重要です。その可能性は有望ですが、これらのテクノロジーに関連する制限とリスクを理解することが不可欠です。ChatGPT と同様の生成 AIシステムが健康にどのような影響を与えるかを説明します。

1. AIに対する懸念

情報科学技術協会ジャーナルによると、AI 不安という用語は数年前から使われ始めていますが、AI 開発の急速なペースは依然として多くの人々を不安にさせています。

幸いなことに、テクノロジーの急速な発展に追いつきながら、AI への不安を克服する方法があります。たとえば、チャットボットについて学び、AI を自分の生活に組み込むと、チャットボットの謎の多くを取り除くことができると、Everyday Health は述べています。

多くの人にとって、AI の急速な普及を不安にさせる要因の 1 つは未知の要素であるため、基本を理解することから始めるのが賢明です。少し直観に反するように聞こえるかもしれませんが、Bard または ChatGPT を試してみると、アプリ全体をよりアクセスしやすくすることができます。

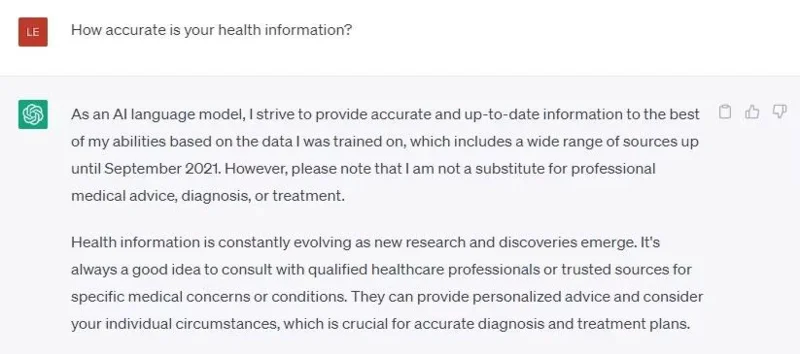

2. 不正確な健康情報

ChatGPT のようなモデルがプロンプトに応答する方法は、すべてを知っているかのように見えます。ただし、特に健康に関する質問に関しては、回答に注意することが重要です。

ChatGPT は場合によっては信頼できる健康情報を提供できますが、このアプリは依然として幻覚を引き起こし、不正確な健康アドバイスを提供する可能性があります。おそらく、Google の検索結果が正確でパーソナライズされた健康データを提供するとは信じていないので、AI テクノロジーには慎重に取り組むことが賢明です。

自分の健康について深刻な質問がある場合は、かかりつけの医療提供者に質問するのが最善です。さらに、医療専門家は、あなたの病歴、症状、全体的な健康状態など、多くの要素を考慮する可能性があります。AI モデルは、これらすべての要素を同じ程度に (少なくとも完全には) 処理できない可能性があります。

したがって、ヒントを参考にして、健康上の問題について医師に相談してください。最適な言語モデルであっても、個別の診断を提供することはできません。

3. テクノロジー依存行動の増加

テクノロジー依存症はすでに懸念されています。特に近年、SNSやスマートフォンへの依存症が急増しています。多くの人にとって、これらの習慣形成テクノロジーを断ち切るのは困難であり、オンラインの人々は、ChatGPT や同様の AI アプリケーションに対する中毒の感情を非公式に報告しています。

実際、ピュー研究所によると、専門家らはAI技術が今後数年間でデジタル中毒の問題を悪化させるだろうと述べている。「デジタル依存症は、ビデオゲームをプレイしたり、TikTokやYouTubeの動画を見たり、すべてのツイートを見たりする多くの人々にとってすでに問題になっていますが、これらのチャンネルやその他のデジタルテクノロジーがさらに個人化されているため、さらに大きな問題になる可能性があります。」とゲイリー・グロスマン氏は述べています。エデルマンの上級副社長兼AI Center of Excellenceのグローバルリーダーは報告書の中で述べた。

悪く聞こえるかもしれませんが、インターネット、AI、テクノロジー全般の使用への依存を減らすために実行できる手順は確かにあります。

4. 医療データのプライバシーに関する懸念

多くの人にとって、日常の質問には ChatGPT などのリソースを使用するのが簡単です。たとえば、次回特定の健康状態についてさらに詳しく知りたい場合は、これらのチャットボットに頼ると、迅速な応答が得られます。

世界保健機関が警告しているように、AI 言語ツールはすぐに使えて簡単ですが、入力した個人の健康データは保護されない可能性があります。機密性の高い健康状態やプライベートな健康状態についてリマインダーを書きたい場合は注意してください。

健康上の懸念に対処するには、医療提供者に相談することが、より信頼性が高く安全な方法です。秘密にしておきたい情報については、AI に入力することは避けてください。

5. サイバーハラスメントやいじめの可能性

残念ながら、新しいテクノロジーには害を及ぼす可能性があることがよくあります。荒らしボットと同様に、AI が生成した虐待的な言語モデルは、有害で嫌がらせ的なコメントをすぐに生成する可能性があります。これは、標的となった人にストレスや精神的トラウマを引き起こす可能性があります。

AI モデルはこれらの残酷なメッセージを自動化し、大規模に生成できるため、個人は複数のプラットフォームにわたる大量のコメントに圧倒される可能性があります。ソーシャルメディアをチェックしたり電子メールを送信したりするたびに、この種のコンテンツを扱いたいと思う人は誰もいません。

これは新しい問題ではないため、ネットいじめから身を守る方法はいくつかあります。ネットいじめ研究センターによると、メッセージを録音し、Web サイト管理者や電話会社にサポートを求めることは、素晴らしい第一歩です。

ほぼすべてのソーシャル メディア サイトには、ネットいじめ加害者からのこうした憎悪に満ちたメッセージを処理するためのポリシーがすでに導入されています。たとえば、迷惑なメッセージを Facebook に報告したり、嫌がらせのメッセージを Instagram に報告したり、TikTok のモデレーション チームに連絡したりできます。コンテンツを報告し、迷惑なユーザーをブロックし、プライバシー設定を調整して、ネットいじめのリスクを軽減します。

Microsoft Teamsでファイルが表示されない問題を解決するための手順を詳しく解説します。特にSharePointフォルダーやユーザー制限に関連する解決策を紹介します。

AppDataフォルダーを移動する方法について、詳細で便利な情報をお届けします。

Salesforce ServiceCloudにおけるナレッジとソリューションの違いを理解し、ビジネスに有益な決定を下すための情報を提供します。

欧州の国家プライバシー監視団体を統合する団体は木曜日、ChatGPT専用の対策委員会を設置したと発表した。

デンマークとアメリカの科学者は共同で、人間の死亡時刻を高精度で予測できる life2vec と呼ばれる AI システムを開発しました。

Audioflow と呼ばれる AI アルゴリズムは、排尿音を聞いて、異常な排尿の流れとそれに対応する患者の健康上の問題を効果的かつ首尾よく特定できます。

日本では高齢化と人口減少により、特にサービス部門で大量の若年労働者が不足しています。

u/LegalBeagle1966 という名前の Reddit ユーザーは、このプラットフォームで魅惑的な自撮り写真、さらにはヌード写真を頻繁に共有する映画スターのような女の子、クローディアに夢中になっている多くのユーザーの 1 人です。

Microsoft は、さらに 12 社のテクノロジー企業が AI for Good プログラムに参加すると発表しました。

ユーザー @mortecouille92 は、グラフィック デザイン ツール Midjourney の力を活用し、悟空、ベジータ、ブルマ、カメ長老などの有名なドラゴンボールのキャラクターのユニークでリアルなバージョンを作成しました。