Рабочая группа ChatGPT будет создана Европой

Орган, объединяющий европейских национальных наблюдателей за конфиденциальностью, заявил в четверг, что создал целевую группу, посвященную ChatGPT.

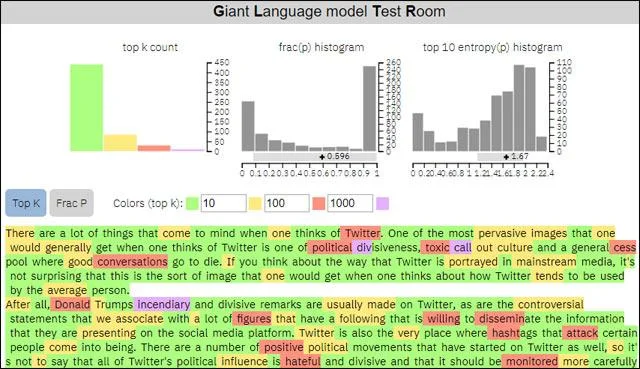

Недавно исследователи из Гарвардского университета и лаборатории AI-MIT Watson Массачусетского технологического института создали инструмент GLTR (Giant Language Model Test Room — Гигантская языковая модель тестовой комнаты) для обнаружения предвзятости информации, создаваемой ИИ с использованием самого искусственного интеллекта.

Инструмент GLTR четко понимает, как работает ИИ, а затем анализирует информационный контент. Этот инструмент обнаруживает фейковые новости, созданные с помощью технологии искусственного интеллекта, путем выделения фрагмента текста. Читатели могут оценить аналитические возможности GLTP на иллюстрации ниже. Слова, выделенные зеленым цветом, являются наиболее предсказуемыми, красный и желтый — менее предсказуемыми, а фиолетовый — наименее предсказуемым.

Ученые полагаются на цвета в каждом фрагменте текста и на анализ, чтобы оценить подлинность информации, независимо от того, была ли она создана алгоритмами или нет. Текст, выделенный красным, фиолетовым и желтым, с меньшей вероятностью будет создан ИИ из-за использования большого количества сложных слов. Если текст покрыт большим количеством синего цвета, это означает, что в нем много общих слов и, вероятно, они созданы ботом. Этот инструмент помогает повысить уровень обнаружения поддельного текста примерно на 72%.

По сути, предложения, написанные генератором текста ИИ, могут быть грамматически правильными, но обязательно будут иметь семантические проблемы или во многих случаях даже не иметь какого-либо реального смысла или какой-либо причины.

В настоящее время использование искусственного интеллекта и моделей генерации неестественного языка для создания фейковых новостей и распространения ложной информации становится все более распространенным, что приводит к серьезным последствиям для общества. Эти фальшивые тексты иногда бывают чрезвычайно сложными, из-за чего читателям трудно понять, что они были написаны машиной, а не человеком. Между тем, инструмент GLTR оснащен способностью точно различать вышеупомянутый тип фальшивого текста, выступая в качестве эффективного инструмента искусственного интеллекта «естественного врага». Это также основная идея исследователей проекта GLTR.

Инициативы, подобные GLTR, следует в ближайшее время продвигать и широко использовать на практике. Они ценны не только при обнаружении фейкового текста, но и играют особенно эффективную роль в выявлении ботов Твиттера, которые часто используются для срыва выборов в США и многих других странах.

До появления GLTR существовал широко используемый и относительно эффективный инструмент распознавания на основе искусственного интеллекта под названием Botometer. По сути, Botometer использует методы машинного обучения, чтобы определить, управляется ли какая-либо учетная запись человеком или программным алгоритмом. Этот инструмент способен идентифицировать учетные записи ботов и фейковые учетные записи, которые не управляются людьми, с точностью до 95%.

В очередной раз указывается и подчеркивается необходимость создания совместных систем искусственного интеллекта и человека для решения общих технологических/социальных проблем. Это сложная, но чрезвычайно актуальная задача для человечества в нынешнюю эпоху цифрового и искусственного интеллекта.

Узнать больше:

Орган, объединяющий европейских национальных наблюдателей за конфиденциальностью, заявил в четверг, что создал целевую группу, посвященную ChatGPT.

Датские и американские учёные совместно разработали систему искусственного интеллекта под названием life2vec, способную с высокой точностью предсказывать время смерти человека.

Алгоритм искусственного интеллекта под названием Audioflow может прослушивать звук мочеиспускания, чтобы эффективно и успешно идентифицировать аномальные выделения и соответствующие проблемы со здоровьем пациента.

Старение и сокращение населения Японии привело к тому, что в стране не хватает значительного числа молодых работников, особенно в сфере услуг.

Пользователь Reddit под ником u/LegalBeagle1966 — один из многих пользователей, влюбленных в Клаудию, девушку, похожую на кинозвезду, которая часто делится на этой платформе соблазнительными селфи, даже обнаженными.

Microsoft только что объявила, что еще 12 технологических компаний примут участие в ее программе AI for Good.

Пользователь @mortecouille92 применил возможности инструмента графического дизайна Midjourney и создал уникальные реалистичные версии знаменитых персонажей Dragon Ball, таких как Гоку, Вегета, Булма и старший Каме.

Просто добавив некоторые условия или настроив несколько сценариев, ChatGPT может дать более релевантные ответы на ваши запросы. Давайте посмотрим, как можно улучшить качество ответов ChatGPT.

Midjourney — это система искусственного интеллекта, которая в последнее время вызвала «лихорадку» в онлайн-сообществе и мире художников из-за своих чрезвычайно красивых картин, не уступающих работам настоящих художников.

Через несколько дней после того, как Китай объявил о вспышке, имея доступ к глобальным данным о продажах авиабилетов, система искусственного интеллекта BlueDot продолжала точно предсказывать распространение вируса уханьской короны в Бангкоке, Сеуле, Тайбэе и Токио.