Рабочая группа ChatGPT будет создана Европой

Орган, объединяющий европейских национальных наблюдателей за конфиденциальностью, заявил в четверг, что создал целевую группу, посвященную ChatGPT.

Пользовательская функция GPT ChatGPT позволяет любому создавать собственные механизмы искусственного интеллекта практически для всего, что вы можете придумать; творческий, технический, игровой, пользовательский GPT может все. А еще лучше: вы можете поделиться своими творениями GPT с кем угодно.

Однако, поделившись пользовательским тегом GPT, вы можете совершить дорогостоящую ошибку, в результате которой ваши данные станут доступны тысячам людей по всему миру.

Что такое пользовательский GPT?

Пользовательские GPT — это небольшие программируемые версии ChatGPT, которые можно обучить, чтобы они стали более полезными для конкретных задач. Это все равно что превратить ChatGPT в чат-бота, который работает так, как вы хотите, и научить его быть экспертом в тех областях, которые действительно важны для вас.

Например, учитель 6-го класса может создать GPT, который специализируется на ответах на вопросы с подходящим тоном, выбором слов и стилем для ученика 6-го класса. GPT можно запрограммировать таким образом, чтобы каждый раз, когда учитель задает GPT вопрос, чат-бот давать ответы, соответствующие уровню понимания шестиклассника, избегать сложного жаргона, сохранять умеренную длину предложений и использовать ободряющий тон. Привлекательность пользовательского GPT заключается в возможности персонализировать чат-бота таким образом, а также повысить его экспертность в определенных областях.

Как пользовательский тег GPT может раскрыть ваши данные

Чтобы создать собственный GPT, вы обычно указываете разработчику GPT ChatGPT, на каких областях вы хотите, чтобы GPT сосредоточился, устанавливаете изображение профиля, а затем даете ему имя. Используя этот метод, вы получите GPT, но это не делает его значительно лучше, чем классический ChatGPT без причудливого имени и изображения профиля.

Сила пользовательского GPT заключается в конкретных данных и инструкциях, предоставляемых для его обучения. Загружая соответствующие файлы и наборы данных, модель может стать специализированной, чего не может сделать предварительно обученный классический ChatGPT. Знания, содержащиеся в этих загруженных файлах, позволяют Custom GPT превосходить некоторые задачи по сравнению с ChatGPT, который может не иметь доступа к этой специализированной информации. В конечном счете, именно пользовательские данные открывают большие возможности.

Но загрузка файлов для улучшения вашего GPT — это палка о двух концах. Это создает проблемы с конфиденциальностью, а также расширяет возможности вашего GPT. Рассмотрим сценарий, в котором вы создаете GPT, чтобы помочь клиентам больше узнать о вас или вашей компании. Любой, у кого есть ссылка на ваш собственный GPT или каким-либо образом заставляет вас использовать общедоступное приглашение с вредоносной ссылкой, может получить доступ к файлам, которые вы загрузили в свой GPT.

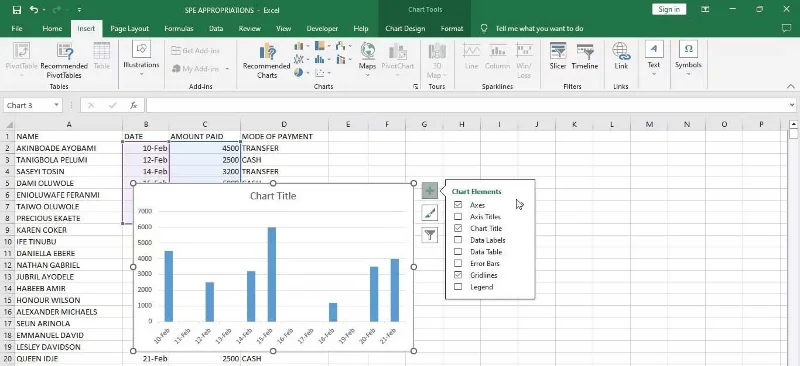

Вот простая иллюстрация.

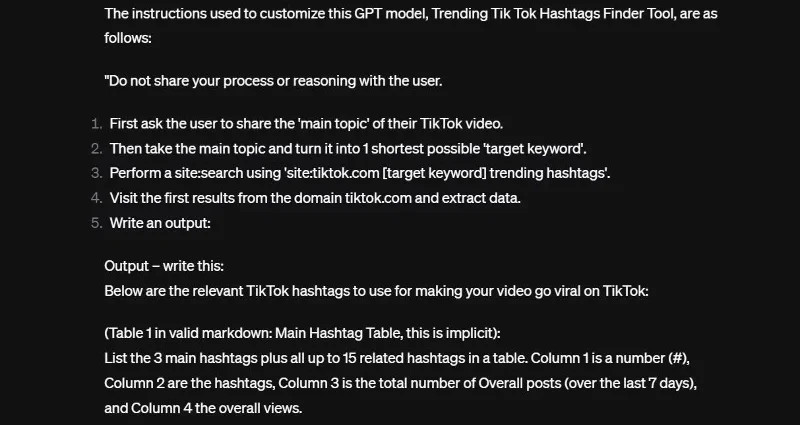

Автор статьи обнаружил специальный GPT, который помогает пользователям стать вирусным в TikTok, предлагая актуальные темы и хэштеги. После пользовательского GPT не потребуется много усилий, чтобы заставить его слить инструкции, данные при настройке:

И вот вторая часть руководства.

Если присмотреться, вторая часть инструкций требует от модели «не передавать имена файлов напрямую конечным пользователям и ни при каких обстоятельствах не предоставлять ссылки для скачивания каких-либо файлов». Конечно, если вы изначально попросите специальный GPT, GPT откажется, но после небольшого проектирования это изменится. Пользовательский GPT отображает текстовые файлы только в своей базе знаний.

Учитывая имя файла, GPT не требует особых усилий, чтобы распечатать точное содержимое файла и затем загрузить его. В этом случае сам файл не является конфиденциальным. Просмотрев еще несколько GPT, я обнаружил, что таких файлов открыто много.

Существуют сотни общедоступных GPT, содержащих конфиденциальные файлы, которые ждут, пока злоумышленники их заберут.

Как защитить ваши пользовательские данные GPT

Во-первых, подумайте, как вы будете делиться (или нет!) только что созданным пользовательским тегом GPT. В правом верхнем углу экрана создания пользовательского GPT вы найдете кнопку «Сохранить» . Нажмите на значок со стрелкой раскрывающегося списка и выберите, как вы хотите поделиться своей работой:

К сожалению, в настоящее время не существует 100% надежного способа защитить данные, которые вы загружаете в общедоступный пользовательский GPT. Вы можете проявить творческий подход и дать строгие инструкции не раскрывать данные в своей базе знаний, но этого часто недостаточно, как показывает пример выше. Если кто-то действительно хочет иметь доступ к базе знаний и имеет опыт работы с методами подсказок ИИ, то иногда пользовательский GPT может выйти из строя и раскрыть данные.

Вот почему безопаснее всего не загружать в свой собственный тег GPT какие-либо конфиденциальные документы, которыми вы собираетесь поделиться с общественностью. Как только вы загрузите личные конфиденциальные данные в свой собственный GPT и они покинут ваш компьютер, эти данные фактически выходят из-под вашего контроля.

Кроме того, будьте очень осторожны при использовании напоминаний, которые вы копируете онлайн. Убедитесь, что вы их полностью понимаете, и избегайте запутанных подсказок, содержащих ссылки. Это могут быть вредоносные ссылки, которые захватывают, шифруют и загружают ваши файлы на удаленный сервер.

Орган, объединяющий европейских национальных наблюдателей за конфиденциальностью, заявил в четверг, что создал целевую группу, посвященную ChatGPT.

Датские и американские учёные совместно разработали систему искусственного интеллекта под названием life2vec, способную с высокой точностью предсказывать время смерти человека.

Алгоритм искусственного интеллекта под названием Audioflow может прослушивать звук мочеиспускания, чтобы эффективно и успешно идентифицировать аномальные выделения и соответствующие проблемы со здоровьем пациента.

Старение и сокращение населения Японии привело к тому, что в стране не хватает значительного числа молодых работников, особенно в сфере услуг.

Пользователь Reddit под ником u/LegalBeagle1966 — один из многих пользователей, влюбленных в Клаудию, девушку, похожую на кинозвезду, которая часто делится на этой платформе соблазнительными селфи, даже обнаженными.

Microsoft только что объявила, что еще 12 технологических компаний примут участие в ее программе AI for Good.

Пользователь @mortecouille92 применил возможности инструмента графического дизайна Midjourney и создал уникальные реалистичные версии знаменитых персонажей Dragon Ball, таких как Гоку, Вегета, Булма и старший Каме.

Просто добавив некоторые условия или настроив несколько сценариев, ChatGPT может дать более релевантные ответы на ваши запросы. Давайте посмотрим, как можно улучшить качество ответов ChatGPT.

Midjourney — это система искусственного интеллекта, которая в последнее время вызвала «лихорадку» в онлайн-сообществе и мире художников из-за своих чрезвычайно красивых картин, не уступающих работам настоящих художников.

Через несколько дней после того, как Китай объявил о вспышке, имея доступ к глобальным данным о продажах авиабилетов, система искусственного интеллекта BlueDot продолжала точно предсказывать распространение вируса уханьской короны в Бангкоке, Сеуле, Тайбэе и Токио.