Рабочая группа ChatGPT будет создана Европой

Орган, объединяющий европейских национальных наблюдателей за конфиденциальностью, заявил в четверг, что создал целевую группу, посвященную ChatGPT.

ChatGPT и другие технологии изучения языков стали мощными инструментами и только начинают влиять на такие отрасли, как здравоохранение. Однако важно проявлять осторожность при использовании этих средств в отношении собственного здоровья. Хотя их потенциал многообещающий, важно понимать ограничения и риски, связанные с этими технологиями. Вот как ChatGPT и подобные системы генеративного искусственного интеллекта могут повлиять на ваше здоровье.

1. Опасения по поводу ИИ

Хотя термин «беспокойство в отношении ИИ» существует уже несколько лет, согласно журналу Ассоциации информационных наук и технологий, быстрые темпы развития ИИ по-прежнему вызывают беспокойство у многих людей.

К счастью, есть способы преодолеть беспокойство по поводу ИИ, не отставая при этом от быстрого развития технологий. Например, по данным Everyday Health, изучение чат-ботов и внедрение искусственного интеллекта в вашу жизнь может помочь раскрыть многие из ее загадок.

Для многих людей неизвестный фактор является частью того, что делает быстрый рост развития искусственного интеллекта таким тревожным, поэтому знакомство с основами — разумное начало. Хотя это может показаться немного нелогичным, экспериментирование с Bard или ChatGPT может помочь сделать приложение в целом более доступным.

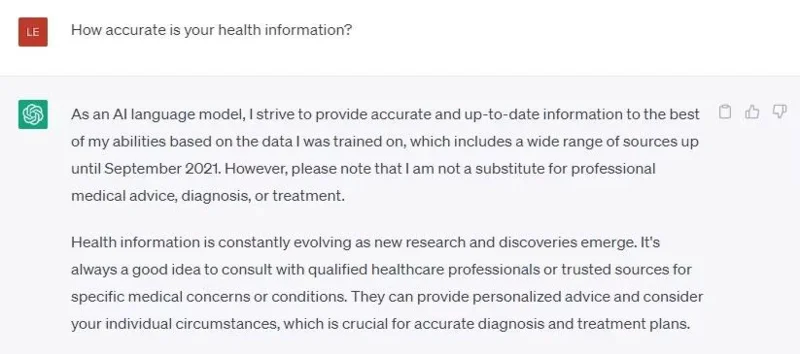

2. Неточная информация о здоровье.

То, как такие модели, как ChatGPT, отвечают на подсказки, создает впечатление, что они знают все. Однако важно быть осторожным с ответами, особенно когда речь идет о вопросах здоровья.

Хотя ChatGPT в некоторых случаях может предоставить достоверную информацию о состоянии здоровья, приложение все равно может вызывать галлюцинации и давать неточные советы по здоровью. Скорее всего, вы не доверяете результатам поиска Google в предоставлении точных персонализированных данных о здоровье, поэтому разумно подходить к технологии искусственного интеллекта с такой осторожностью.

Если у вас есть какие-либо серьезные вопросы о вашем здоровье, лучше всего обратиться с этими вопросами к своему лечащему врачу. Кроме того, медицинские работники, вероятно, будут учитывать множество факторов, включая вашу историю болезни, симптомы и общее состояние здоровья. Модели ИИ, возможно, не смогут справиться со всеми этими факторами в одинаковой степени (по крайней мере, не полностью).

Так что поймите подсказку и обратитесь к врачу по поводу проблем со здоровьем. Даже лучшая языковая модель не может обеспечить персонализированный диагноз.

3. Рост зависимости от технологий

Технологическая зависимость уже вызывает беспокойство. В частности, в последние годы стремительно растет зависимость от социальных сетей и смартфонов. Многим людям трудно избавиться от этих вызывающих привыкание технологий, и люди в Интернете неофициально сообщают о чувстве зависимости от ChatGPT и подобных приложений искусственного интеллекта.

Фактически, эксперты говорят, что технология искусственного интеллекта усугубит проблему цифровой зависимости в ближайшие годы, согласно данным Исследовательского центра Pew. «Цифровая зависимость, которая уже является проблемой для многих людей, которые играют в видеоигры, смотрят видео в TikTok или YouTube или смотрят каждый твит, может стать еще большей проблемой, поскольку эти каналы и другие цифровые технологии еще более персонализированы», — Гэри Гроссман, старший вице-президент и глобальный руководитель Центра передового опыта в области искусственного интеллекта в Edelman, говорится в отчете.

Хотя это может показаться плохим, вы, безусловно, можете предпринять шаги, чтобы уменьшить свою зависимость от использования Интернета, искусственного интеллекта и технологий в целом.

4. Проблемы конфиденциальности медицинских данных

Многим людям легко использовать такие ресурсы, как ChatGPT, для решения повседневных вопросов. Например, в следующий раз, когда вы захотите узнать больше о конкретном состоянии здоровья, вы можете обратиться к этим чат-ботам, чтобы получить быстрый ответ.

Как предупреждает Всемирная организация здравоохранения, хотя языковые инструменты искусственного интеллекта быстры и просты в использовании, они могут не защитить никакие вводимые вами личные данные о здоровье. Будьте осторожны, если хотите написать напоминания о деликатных или личных проблемах со здоровьем.

Разговор с вашим лечащим врачом остается более надежным и безопасным способом решения любых проблем со здоровьем. Когда дело доходит до какой-либо информации, которую вы хотите сохранить при себе, избегайте ввода ее в ИИ.

5. Возможность киберпреследований и издевательств.

К сожалению, новые технологии часто могут нанести вред. Подобно ботам-троллям, оскорбительные языковые модели, созданные ИИ, могут быстро генерировать вредные и оскорбительные комментарии. Это может вызвать стресс и эмоциональную травму у пострадавшего человека.

Поскольку модели искусственного интеллекта могут автоматизировать эти жестокие сообщения и генерировать их в больших масштабах, люди могут быть ошеломлены большим количеством комментариев на разных платформах. Никто не хочет сталкиваться с этим типом контента каждый раз, когда вы проверяете социальные сети или отправляете электронное письмо.

Это не новая проблема, поэтому существуют способы защитить себя от киберзапугивания. По данным Центра исследований киберзапугивания, запись сообщений, а также обращение за поддержкой к администратору вашего веб-сайта или телефонной компании являются отличными первыми шагами.

Почти на каждом сайте социальных сетей уже есть политика для обработки ненавистнических сообщений от киберхулиганов. Например, вы можете сообщить о раздражающих сообщениях в Facebook, сообщить об оскорбительных сообщениях в Instagram и связаться с командой модераторов TikTok. Сообщайте о контенте, блокируйте проблемных пользователей и настраивайте настройки конфиденциальности, чтобы снизить риск киберзапугивания.

Орган, объединяющий европейских национальных наблюдателей за конфиденциальностью, заявил в четверг, что создал целевую группу, посвященную ChatGPT.

Датские и американские учёные совместно разработали систему искусственного интеллекта под названием life2vec, способную с высокой точностью предсказывать время смерти человека.

Алгоритм искусственного интеллекта под названием Audioflow может прослушивать звук мочеиспускания, чтобы эффективно и успешно идентифицировать аномальные выделения и соответствующие проблемы со здоровьем пациента.

Старение и сокращение населения Японии привело к тому, что в стране не хватает значительного числа молодых работников, особенно в сфере услуг.

Пользователь Reddit под ником u/LegalBeagle1966 — один из многих пользователей, влюбленных в Клаудию, девушку, похожую на кинозвезду, которая часто делится на этой платформе соблазнительными селфи, даже обнаженными.

Microsoft только что объявила, что еще 12 технологических компаний примут участие в ее программе AI for Good.

Пользователь @mortecouille92 применил возможности инструмента графического дизайна Midjourney и создал уникальные реалистичные версии знаменитых персонажей Dragon Ball, таких как Гоку, Вегета, Булма и старший Каме.

Просто добавив некоторые условия или настроив несколько сценариев, ChatGPT может дать более релевантные ответы на ваши запросы. Давайте посмотрим, как можно улучшить качество ответов ChatGPT.

Midjourney — это система искусственного интеллекта, которая в последнее время вызвала «лихорадку» в онлайн-сообществе и мире художников из-за своих чрезвычайно красивых картин, не уступающих работам настоящих художников.

Через несколько дней после того, как Китай объявил о вспышке, имея доступ к глобальным данным о продажах авиабилетов, система искусственного интеллекта BlueDot продолжала точно предсказывать распространение вируса уханьской короны в Бангкоке, Сеуле, Тайбэе и Токио.