Рабочая группа ChatGPT будет создана Европой

Орган, объединяющий европейских национальных наблюдателей за конфиденциальностью, заявил в четверг, что создал целевую группу, посвященную ChatGPT.

Несмотря на впечатляющие возможности ChatGPT , несколько крупных компаний запретили своим сотрудникам использовать этого чат-бота с искусственным интеллектом.

В мае 2023 года Samsung запретила использование ChatGPT и других инструментов генеративного искусственного интеллекта . Затем, в июне 2023 года, австралийский банк Содружества вместе с такими компаниями, как Amazon, Apple и JPMorgan Chase & Co, также ввел ограничение. Некоторые больницы, юридические фирмы и государственные учреждения также запретили сотрудникам использовать ChatGPT.

Так почему же все больше и больше компаний запрещают ChatGPT? Вот 5 основных причин.

1. Утечка данных

ChatGPT требует большого объема данных для обучения и эффективной работы. Чат-бот прошел обучение на огромных объемах данных, полученных из Интернета, и будет продолжать обучение.

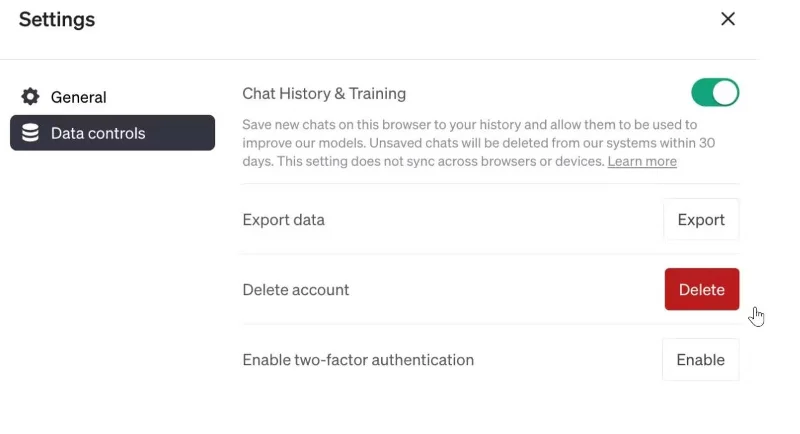

Согласно странице справки OpenAI, каждый фрагмент данных, включая конфиденциальные данные о клиентах, коммерческую тайну и конфиденциальную деловую информацию, которые вы предоставляете чат-боту, может быть проверен и использован для улучшения системы.

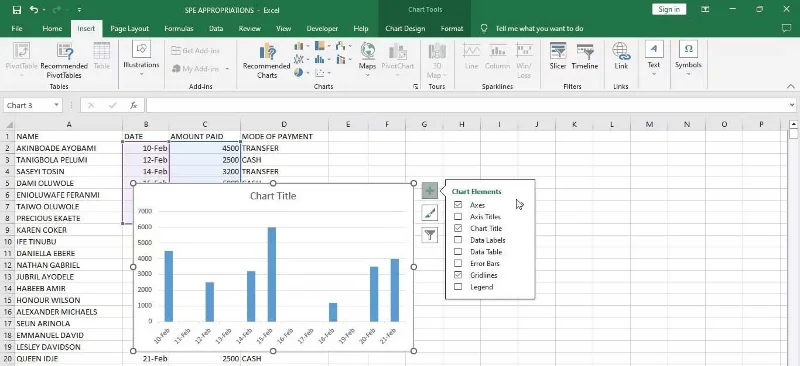

Настройте многофакторную аутентификацию в ChatGPT.

Многие компании подчиняются строгим правилам защиты данных. Поэтому они с осторожностью относятся к передаче личных данных внешним организациям, поскольку это увеличивает риск утечки данных.

Кроме того, OpenAI не дает никаких гарантий полной безопасности и защиты данных. В марте 2023 года OpenAI подтвердила ошибку, которая позволяла некоторым пользователям просматривать заголовки чатов в истории других активных пользователей. Хотя эта ошибка исправлена и OpenAI запустила программу вознаграждения за ошибки, компания не гарантирует безопасность и конфиденциальность пользовательских данных.

Многие организации предпочитают ограничить использование ChatGPT сотрудниками, чтобы избежать утечки данных, которая может нанести ущерб репутации, привести к финансовым потерям и подвергнуть риску своих клиентов и сотрудников.

2. Риски кибербезопасности

Хотя неясно, действительно ли ChatGPT подвержен рискам кибербезопасности, вполне возможно, что его развертывание внутри организации может создать потенциальные уязвимости, которые могут быть использованы киберзлоумышленниками.

Если компания интегрирует ChatGPT и в системе безопасности чат-бота есть уязвимость, злоумышленники могут воспользоваться уязвимостью и заразить ее вредоносным ПО. Кроме того, способность ChatGPT генерировать ответы, подобные человеческим, является «золотым яйцом» для злоумышленников-фишингистов, которые могут захватывать учетные записи или выдавать себя за законных лиц, чтобы обманом заставить сотрудников компании поделиться конфиденциальной информацией.

3. Создавайте персонализированных чат-ботов

Несмотря на свои инновационные функции, ChatGPT может создавать ложную и вводящую в заблуждение информацию. Поэтому многие компании создали чат-ботов с искусственным интеллектом для рабочих целей. Например, Австралийский банк Содружества попросил своих сотрудников использовать Gen.ai, чат-бота с искусственным интеллектом (ИИ) , который использует информацию CommBank для предоставления ответов.

Такие компании, как Samsung и Amazon, разработали передовые модели естественного языка, поэтому компании могут легко создавать и развертывать персонализированных чат-ботов на основе существующих стенограмм. С помощью этих собственных чат-ботов вы можете предотвратить юридические и репутационные последствия, связанные с неправильным обращением с данными.

4. Отсутствие регулирования

В отраслях, где на компании распространяются протоколы и санкции, отсутствие нормативных указаний ChatGPT является тревожным сигналом. Без четких правовых условий, регулирующих использование ChatGPT, компании могут столкнуться с серьезными юридическими последствиями при использовании чат-ботов с искусственным интеллектом в своей деятельности.

Кроме того, отсутствие регулирования может снизить корпоративную подотчетность и прозрачность. Большинству компаний может быть сложно объяснить своим клиентам процессы принятия решений на языке искусственного интеллекта и меры безопасности.

Компании ограничивают ChatGPT из-за опасений по поводу возможности нарушения законов о конфиденциальности и отраслевых правил.

5. Безответственное использование сотрудниками

Во многих компаниях некоторые сотрудники полагаются исключительно на ответы ChatGPT при создании контента и выполнении своих задач. Это порождает лень в рабочей среде и подавляет творчество и инновации.

Опора на ИИ может помешать вам критически мыслить. Это также может нанести ущерб репутации компании, поскольку ChatGPT часто предоставляет неточные и ненадежные данные.

Хотя ChatGPT является мощным инструментом, его использование для решения сложных запросов, требующих знаний в конкретной предметной области, может нанести вред работе и эффективности компании. Некоторые сотрудники могут не помнить о проверке фактов и проверке ответов, предоставленных чат-ботами с искусственным интеллектом, считая ответы, предоставленные ChatGPT, универсальным решением.

Чтобы смягчить подобные проблемы, компании запрещают чат-ботов, чтобы сотрудники могли сосредоточиться на своих задачах и предоставлять пользователям безошибочные решения.

Орган, объединяющий европейских национальных наблюдателей за конфиденциальностью, заявил в четверг, что создал целевую группу, посвященную ChatGPT.

Датские и американские учёные совместно разработали систему искусственного интеллекта под названием life2vec, способную с высокой точностью предсказывать время смерти человека.

Алгоритм искусственного интеллекта под названием Audioflow может прослушивать звук мочеиспускания, чтобы эффективно и успешно идентифицировать аномальные выделения и соответствующие проблемы со здоровьем пациента.

Старение и сокращение населения Японии привело к тому, что в стране не хватает значительного числа молодых работников, особенно в сфере услуг.

Пользователь Reddit под ником u/LegalBeagle1966 — один из многих пользователей, влюбленных в Клаудию, девушку, похожую на кинозвезду, которая часто делится на этой платформе соблазнительными селфи, даже обнаженными.

Microsoft только что объявила, что еще 12 технологических компаний примут участие в ее программе AI for Good.

Пользователь @mortecouille92 применил возможности инструмента графического дизайна Midjourney и создал уникальные реалистичные версии знаменитых персонажей Dragon Ball, таких как Гоку, Вегета, Булма и старший Каме.

Просто добавив некоторые условия или настроив несколько сценариев, ChatGPT может дать более релевантные ответы на ваши запросы. Давайте посмотрим, как можно улучшить качество ответов ChatGPT.

Midjourney — это система искусственного интеллекта, которая в последнее время вызвала «лихорадку» в онлайн-сообществе и мире художников из-за своих чрезвычайно красивых картин, не уступающих работам настоящих художников.

Через несколько дней после того, как Китай объявил о вспышке, имея доступ к глобальным данным о продажах авиабилетов, система искусственного интеллекта BlueDot продолжала точно предсказывать распространение вируса уханьской короны в Бангкоке, Сеуле, Тайбэе и Токио.