Le groupe de travail ChatGPT sera créé par l’Europe

L'organisme qui rassemble les organismes nationaux de surveillance de la vie privée en Europe a annoncé jeudi avoir créé un groupe de travail dédié à ChatGPT.

L'Union européenne a officiellement publié aujourd'hui un ensemble de documents d'orientation sur la manière dont les entreprises et les gouvernements devraient suivre dans le développement et le déploiement de leurs projets d'intelligence artificielle de manière à ce qu'ils soient véritablement transparents, équitables et « éthiques ».

Cela me rappelle soudain une loi appelée Trois lois de la robotique mentionnée par l'écrivain russe Isaac Asimov dans le recueil de nouvelles "Runaround" qu'il a composé en 1942, un peu comme la première : un robot n'est pas autorisé à nuire aux humains ou à ignorer les dangers qui les humains sont confrontés. Article 2 : Un robot doit absolument obéir aux ordres donnés par les humains sauf si ces ordres entrent en conflit avec la première loi. Et troisièmement : un robot doit se protéger, à condition que cette protection n’entre pas en conflit avec la première et la deuxième lois. Bien qu’il ne s’agisse que d’un ensemble de règles « fictives » apparues il y a près de 80 ans, elles restent particulièrement d’actualité alors que les gens entrent progressivement dans l’ère actuelle de l’intelligence artificielle. Bien entendu, le nouvel ensemble de règles émises par l’UE ne sera pas fondamentalement le même que la loi des « Trois lois de la robotique » d’Isaac Asimov. Les législateurs européens ne peuvent pas fournir un cadre éthique flexible qui nous aiderait à gérer de grandes choses comme arrêter les robots tueurs. Au lieu de cela, les documents d'orientation de l'UE aident à résoudre des problèmes « obscurs et omniprésents » qui ont un impact négatif sur la société alors que nous intégrons l'IA dans de nombreux domaines importants de notre vie, tels que les soins de santé, l'éducation et les technologies de consommation.

À titre d'exemple simple, si un système d'IA médicale diagnostique une personne présentant un risque élevé de développer un cancer à l'avenir, les orientations de l'UE contribueront à garantir que certaines des conditions suivantes doivent être respectées : Le logiciel n'est pas biaisé ou biaisé par le patient. de race ou de sexe, et en même temps fournir l'information la plus claire et la plus transparente sur son état de santé, et surtout ne doit pas interférer ou entraver les décisions du médecin.

Donc, oui, ces lignes directrices visent principalement à limiter et à contrôler les modèles d'IA pour qu'ils fonctionnent correctement, mais uniquement au niveau administratif et bureaucratique, plutôt qu'à empêcher les actes de meurtre selon l'imagination de l'écrivain Asimov.

Pour produire cet ensemble de documents d'orientation, l'UE a dû convoquer un groupe de 52 experts, leur demandant de discuter, de se mettre d'accord et de proposer 7 exigences auxquelles, selon eux, les futurs systèmes d'IA devraient pouvoir répondre. Ces exigences sont les suivantes :

Vous remarquerez probablement que certaines des affirmations ci-dessus sont assez abstraites et seraient difficiles à évaluer de manière objective (par exemple, la définition du changement social positif apporté par l'IA variera considérablement d'une personne à l'autre et, plus largement, d'un pays à l'autre). ). Cependant, la plupart des éléments restants sont généralement plus simples et peuvent être vérifiés et garantis sous le contrôle des autorités. Par exemple, le partage des données utilisées pour former les systèmes gouvernementaux d’IA pourrait être un bon moyen de lutter contre les algorithmes biaisés et opaques.

Les dispositions de ces documents d’orientation de l’UE ne sont clairement pas juridiquement contraignantes, mais elles pourraient être utilisées pour façonner toute future législation rédigée par l’Union européenne dans le domaine de l’IA. Dans le passé, l’UE a déclaré à plusieurs reprises qu’elle souhaitait faire de l’Europe un pionnier mondial dans le déploiement de modèles d’IA « éthiques », et le lancement d’un ensemble de documents d’orientation montre clairement qu’elle est prête à rédiger des lois de grande envergure. réglementer et protéger les droits numériques.

L’UE veut façonner une industrie de l’IA axée sur des normes éthiques

Dans le cadre des efforts visant à créer une industrie de l’IA « éthique », le document d’orientation de l’UE pourrait être considéré comme un tremplin vers la création d’une « liste d’évaluation de l’IA de confiance » – une liste de termes qui peuvent aider les experts à détecter les faiblesses ou les dangers potentiels d’une IA. logiciel même s'il a été largement déployé. Cette liste peut inclure des questions telles que : « Pouvez-vous démontrer comment votre système d'IA fonctionne dans des situations et des environnements complexes ? » ou « Pouvez-vous évaluer le type et la portée des données dans votre ensemble de données ? » ...

Bien entendu, cette liste d’évaluation n’est que préliminaire, l’UE devra encore dans un avenir proche recueillir les retours des entreprises et des experts en intelligence artificielle. Dès 2020, l’UE publiera un rapport de synthèse sur cette question.

Anny Hidvégi, responsable politique du groupe de défense des droits numériques Access Now et l'un des 52 experts responsables de l'élaboration des documents d'orientation de l'UE, a déclaré que la liste d'évaluation était l'élément clé du rapport. , perspective prospective sur la manière de prévenir et de minimiser les dommages potentiels de l’IA. »

« À notre avis, l’UE a suffisamment de potentiel et de responsabilités pour devenir une organisation leader dans ce domaine. Mais nous pensons également que l’Union européenne ne doit pas s’arrêter aux principes moraux. Ils devraient envisager d’exiger que les sociétés minières d’IA se conforment à la loi à l’avenir », a ajouté M. Hidvégi.

D’autres doutent que la tentative de l’UE de façonner la manière dont l’IA mondiale est développée grâce à une recherche éthique ait beaucoup d’effet.

« Nous sommes sceptiques quant à l'approche adoptée par la principale organisation européenne. L’idée selon laquelle en créant une norme de référence pour les systèmes d’IA éthiques, l’UE sera en mesure de se tailler une place dans le développement de l’industrie mondiale de l’IA est relativement tirée par les cheveux. Pour devenir un leader dans l’élaboration de règles éthiques en matière d’IA, l’UE doit d’abord devenir un leader dans le domaine de l’IA dans son ensemble », a expliqué Eline Ch Pivot, analyste politique principale au Centre européen d’innovation des données.

Que pensez-vous de ce problème ? Veuillez laisser vos commentaires dans la section commentaires ci-dessous !

L'organisme qui rassemble les organismes nationaux de surveillance de la vie privée en Europe a annoncé jeudi avoir créé un groupe de travail dédié à ChatGPT.

Des scientifiques danois et américains ont collaboré pour développer un système d'IA appelé life2vec, capable de prédire l'heure de la mort humaine avec une grande précision.

Un algorithme d’IA appelé Audioflow peut écouter le bruit de la miction pour identifier efficacement et avec succès les flux anormaux et les problèmes de santé correspondants du patient.

En raison du vieillissement et du déclin de la population japonaise, le pays manque d'un nombre important de jeunes travailleurs, notamment dans le secteur des services.

Un utilisateur de Reddit nommé u/LegalBeagle1966 est l'un des nombreux utilisateurs amoureux de Claudia, une fille ressemblant à une star de cinéma qui partage souvent des selfies séduisants, même nus, sur cette plateforme.

Microsoft vient d'annoncer que 12 autres entreprises technologiques participeront à son programme AI for Good.

L'utilisateur @mortecouille92 a mis à profit la puissance de l'outil de conception graphique Midjourney et a créé des versions réalistes uniques de personnages célèbres de Dragon Ball comme Goku, Vegeta, Bulma et l'aîné Kame. .

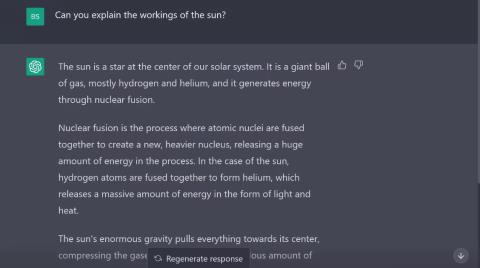

En ajoutant simplement quelques conditions ou en mettant en place des scénarios, ChatGPT peut donner des réponses plus pertinentes à vos requêtes. Examinons quelques façons d'améliorer la qualité de vos réponses ChatGPT.

Midjourney est un système d'intelligence artificielle qui a récemment provoqué une "fièvre" dans la communauté en ligne et dans le monde des artistes en raison de ses peintures extrêmement belles qui ne sont pas inférieures à celles de vrais artistes.

Quelques jours après que la Chine a annoncé l'épidémie, grâce à l'accès aux données mondiales sur les ventes de billets d'avion, le système d'IA de BlueDot a continué à prédire avec précision la propagation du virus Corona de Wuhan à Bangkok, Séoul, Taipei et Tokyo.