Europa utworzy grupę zadaniową ChatGPT

Organ zrzeszający krajowe organy nadzorujące prywatność w Europie poinformował w czwartek, że powołał grupę zadaniową zajmującą się ChatGPT

Chatboty istnieją już od wielu lat, ale pojawienie się głównych modeli językowych, takich jak ChatGPT i Google Bard , dało branży chatbotów nowe życie.

Miliony ludzi na całym świecie korzystają obecnie z chatbotów AI, jednak chcąc wypróbować jedno z tych narzędzi, należy pamiętać o kilku ważnych zagrożeniach i obawach związanych z prywatnością.

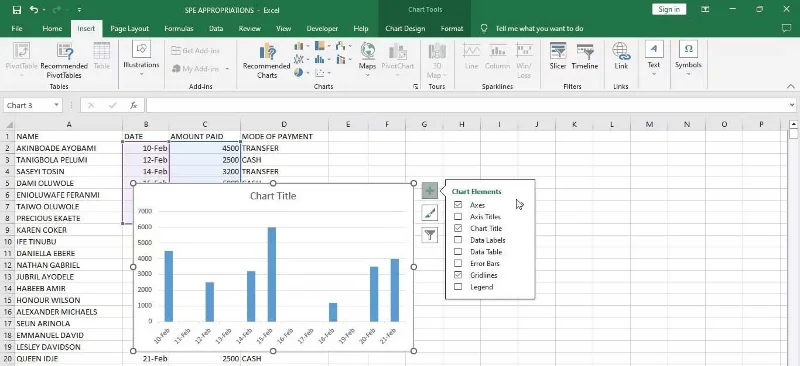

1. Zbierz dane

Większość ludzi nie używa chatbotów tylko po to, żeby się przywitać. Nowoczesne chatboty są zaprojektowane tak, aby obsługiwać i odpowiadać na złożone pytania i prośby, a użytkownicy często zawierają wiele informacji w swoich monitach. Nawet jeśli zadajesz proste pytanie, tak naprawdę nie chcesz, aby wykraczało ono poza rozmowę.

Zgodnie ze wsparciem OpenAI możesz usuwać dzienniki czatów ChatGPT, kiedy tylko chcesz, a dzienniki te zostaną trwale usunięte z systemów OpenAI po 30 dniach. Jednakże firma zachowa i przejrzy niektóre dzienniki czatów, jeśli zostaną uznane za szkodliwe lub nieodpowiednie.

Inny popularny chatbot AI, Claude, również śledzi Twoje poprzednie rozmowy. Centrum wsparcia Anthropic twierdzi, że Claude śledzi „Twoje podpowiedzi i wyniki w produkcie, aby zapewnić Ci spójne korzystanie z produktu przez cały czas pod Twoją kontrolą”. Możesz usunąć swoje rozmowy z Claudem, aby zapomniał, co mówiłeś, ale nie oznacza to, że Anthropic natychmiast usunie Twoje logi ze swojego systemu.

Prowadzi to oczywiście do pytania: Czy Twoje dane są przechowywane? Czy ChatGPT lub inne chatboty wykorzystują Twoje dane?

Ale na tym obawy się nie kończą.

2. Kradzież danych

Jak każde narzędzie lub platforma internetowa, chatboty są podatne na ataki cyberprzestępców. Nawet jeśli chatbot zrobił wszystko, co w jego mocy, aby chronić swoich użytkowników i dane, zawsze istnieje możliwość, że doświadczony haker znajdzie sposób na przedostanie się do jego wewnętrznych systemów.

Jeśli określona usługa chatbota przechowuje Twoje poufne informacje, takie jak szczegóły płatności za płatną subskrypcję, dane kontaktowe lub podobne informacje, informacje te mogą zostać skradzione i wykorzystane w przypadku ataku cybernetycznego.

Jest to szczególnie prawdziwe, jeśli używasz mniej bezpiecznego chatbota, którego programista nie zainwestował w odpowiednią ochronę bezpieczeństwa. Zhakowanie może spowodować nie tylko wewnętrzne systemy firmy, ale także ryzyko naruszenia bezpieczeństwa Twojego konta bez ostrzeżenia o logowaniu lub warstwy uwierzytelniania.

Teraz, gdy chatboty oparte na sztucznej inteligencji są tak popularne, cyberprzestępcy w naturalny sposób zaczęli wykorzystywać tę branżę do oszustw. Fałszywe strony internetowe i wtyczki ChatGPT stały się poważnym problemem, odkąd chatboty OpenAI stały się popularne pod koniec 2022 r., powodując, że ludzie wpadają w oszustwa i przekazują dane osobowe pod pozorem legalności i wiarygodności.

W marcu 2023 r. firma MUO zgłosiła fałszywe rozszerzenie ChatGPT do przeglądarki Chrome , które kradnie dane logowania do Facebooka. Wtyczka może wykorzystywać backdoora Facebooka do włamywania się na konta premium i kradzieży plików cookie użytkowników. To tylko jeden przykład wielu fałszywych usług ChatGPT zaprojektowanych w celu oszukania niczego niepodejrzewających ofiar.

3. Infekcja złośliwym oprogramowaniem

Jeśli korzystasz z podejrzanego chatbota, nie zdając sobie z tego sprawy, może się okazać, że chatbot udostępnia Ci linki do złośliwych stron internetowych. Być może chatbot powiadomił Cię o świetnym rozdaniu lub podał źródło jednej ze swoich odpowiedzi. Jeśli operator usługi ma ukryte zamiary, ogólnym celem platformy może być rozprzestrzenianie złośliwego oprogramowania i phishingu za pośrednictwem złośliwych linków.

Ponadto hakerzy mogą złamać legalną usługę chatbota i wykorzystać ją do rozprzestrzeniania złośliwego oprogramowania. Gdyby ten chatbot był naprawdę człowiekiem, tysiące, a nawet miliony użytkowników byłyby narażone na działanie tego złośliwego oprogramowania. Fałszywe aplikacje ChatGPT pojawiły się nawet w Apple App Store, dlatego najlepiej zachować ostrożność.

Ogólnie rzecz biorąc, nigdy nie powinieneś klikać żadnego linku dostarczonego przez chatbota przed uruchomieniem go przez witrynę sprawdzającą linki. Może się to wydawać denerwujące, ale najlepiej upewnić się, że witryna, do której jesteś kierowany, nie ma złośliwego projektu.

Ponadto nigdy nie należy instalować żadnych wtyczek i rozszerzeń chatbota bez uprzedniego sprawdzenia ich legalności. Przeszukaj aplikację, aby sprawdzić, czy ma dobre recenzje, i poszukaj twórcy aplikacji, aby sprawdzić, czy znajdziesz coś podejrzanego.

Organ zrzeszający krajowe organy nadzorujące prywatność w Europie poinformował w czwartek, że powołał grupę zadaniową zajmującą się ChatGPT

Duńscy i amerykańscy naukowcy współpracowali nad opracowaniem systemu sztucznej inteligencji o nazwie life2vec, zdolnego do przewidywania czasu śmierci człowieka z dużą dokładnością.

Algorytm sztucznej inteligencji o nazwie Audioflow może nasłuchiwać dźwięku oddawania moczu, aby skutecznie i skutecznie identyfikować nieprawidłowe wypływy moczu i powiązane z nimi problemy zdrowotne pacjenta.

Starzenie się i spadek liczby ludności Japonii spowodował, że w kraju brakuje znacznej liczby młodych pracowników, szczególnie w sektorze usług.

Użytkownik Reddita o imieniu u/LegalBeagle1966 jest jednym z wielu użytkowników zakochanych w Claudii, dziewczynie przypominającej gwiazdę filmową, która często udostępnia na tej platformie uwodzicielskie selfie, nawet nagie.

Microsoft właśnie ogłosił, że w jego programie AI for Good weźmie udział 12 kolejnych firm technologicznych.

Użytkownik @mortecouille92 wykorzystał moc narzędzia do projektowania graficznego Midjourney i stworzył wyjątkowo realistyczne wersje słynnych postaci Dragon Ball, takich jak Goku, Vegeta, Bulma i starszy Kame. .

Po prostu dodając pewne warunki lub konfigurując pewne scenariusze, ChatGPT może udzielić bardziej trafnych odpowiedzi na Twoje zapytania. Przyjrzyjmy się sposobom poprawy jakości odpowiedzi ChatGPT.

Midjourney to system sztucznej inteligencji, który wywołał ostatnio „gorączkę” w społeczności internetowej i świecie artystów ze względu na niezwykle piękne obrazy, które nie ustępują tym, które tworzą prawdziwi artyści.

Kilka dni po ogłoszeniu przez Chiny wybuchu epidemii, mając dostęp do danych dotyczących globalnej sprzedaży biletów lotniczych, system sztucznej inteligencji BlueDot w dalszym ciągu dokładnie przewidywał rozprzestrzenianie się wirusa korona z Wuhan do Bangkoku, Seulu, Tajpej i Tokio.