Europa utworzy grupę zadaniową ChatGPT

Organ zrzeszający krajowe organy nadzorujące prywatność w Europie poinformował w czwartek, że powołał grupę zadaniową zajmującą się ChatGPT

ChatGPT i inne technologie nauki języków okazały się potężnymi narzędziami i dopiero zaczynają wpływać na sektory takie jak opieka zdrowotna. Należy jednak zachować ostrożność podczas korzystania z tych narzędzi ze względu na własne zdrowie. Choć ich potencjał jest obiecujący, istotne jest zrozumienie ograniczeń i zagrożeń związanych z tymi technologiami. Oto, jak ChatGPT i podobne systemy generatywnej sztucznej inteligencji mogą wpłynąć na Twoje zdrowie.

1. Obawy dotyczące sztucznej inteligencji

Chociaż termin „lęk przed sztuczną inteligencją” pojawia się już od kilku lat, według czasopisma Journal of the Association for Information Science and Technology szybkie tempo rozwoju sztucznej inteligencji w dalszym ciągu budzi niepokój wielu osób.

Na szczęście istnieją sposoby na przezwyciężenie lęku przed sztuczną inteligencją, dotrzymując kroku szybkiemu rozwojowi technologii. Według Everyday Health na przykład zdobycie wiedzy na temat chatbotów i włączenie sztucznej inteligencji do własnego życia może pomóc w rozwiązaniu wielu jego tajemnic.

Dla wielu osób nieznany czynnik jest częścią tego, co sprawia, że szybki rozwój sztucznej inteligencji jest tak niepokojący, dlatego warto zacząć od zapoznania się z podstawami. Choć może to brzmieć nieco sprzecznie z intuicją, eksperymentowanie z Bardem lub ChatGPT może sprawić, że aplikacja będzie ogólnie bardziej dostępna.

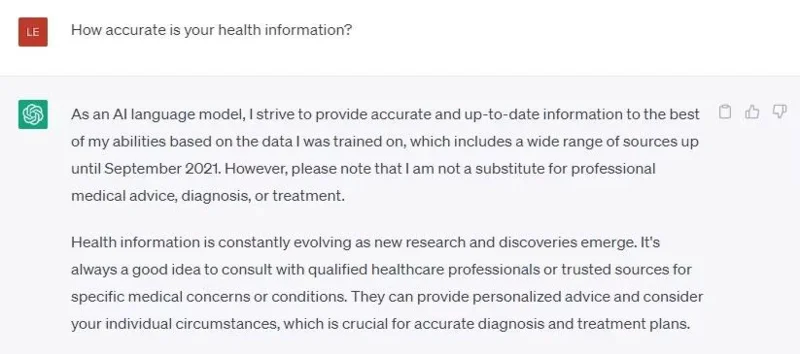

2. Niedokładne informacje o stanie zdrowia

Sposób, w jaki modele takie jak ChatGPT reagują na podpowiedzi, sprawia wrażenie, jakby wiedziały wszystko. Należy jednak zachować ostrożność przy udzielaniu odpowiedzi, zwłaszcza jeśli chodzi o pytania zdrowotne.

Chociaż w niektórych przypadkach ChatGPT może dostarczać wiarygodnych informacji zdrowotnych, aplikacja może nadal powodować halucynacje i udzielać niedokładnych porad zdrowotnych. Prawdopodobnie nie ufasz, że wyniki wyszukiwania Google dostarczają dokładnych, spersonalizowanych danych na temat zdrowia, dlatego mądrze jest podchodzić do technologii sztucznej inteligencji z taką ostrożnością.

Jeśli masz jakiekolwiek poważne pytania dotyczące swojego zdrowia, najlepiej zadać je swojemu lekarzowi. Ponadto pracownicy służby zdrowia prawdopodobnie biorą pod uwagę wiele czynników, w tym historię choroby, objawy i ogólny stan zdrowia. Modele AI mogą nie być w stanie obsłużyć wszystkich tych czynników w równym stopniu (przynajmniej nie całkowicie).

Zatem posłuchaj wskazówki i skontaktuj się z lekarzem w sprawie problemów zdrowotnych. Nawet najlepszy model językowy nie zapewni spersonalizowanych diagnoz.

3. Wzrasta uzależnienie od technologii

Uzależnienie od technologii jest już problemem. W szczególności w ostatnich latach gwałtownie wzrosło uzależnienie od sieci społecznościowych i smartfonów. Dla wielu osób te technologie kształtujące nawyki są trudne do przełamania, a użytkownicy Internetu nieformalnie zgłaszają uczucie uzależnienia od ChatGPT i podobnych aplikacji AI.

Zdaniem Pew Research Center, eksperci twierdzą, że technologia sztucznej inteligencji pogorszy w nadchodzących latach problem uzależnienia cyfrowego. „Uzależnienie od technologii cyfrowych, które jest już problemem dla wielu osób grających w gry wideo, oglądających filmy na TikToku lub YouTube albo oglądających każdy tweet, może stać się jeszcze większym problemem, ponieważ te i inne kanały Inne technologie cyfrowe są jeszcze bardziej spersonalizowane” – Gary Grossman, starszy wiceprezes i światowy lider AI Center of Excellence w Edelman, stwierdził w raporcie.

Choć może to zabrzmieć źle, z pewnością można podjąć kroki, aby zmniejszyć swoją zależność od korzystania z Internetu, sztucznej inteligencji i technologii w ogóle.

4. Obawy dotyczące prywatności danych zdrowotnych

Dla wielu osób korzystanie z zasobów takich jak ChatGPT w przypadku codziennych pytań jest łatwe. Na przykład, gdy następnym razem będziesz chciał dowiedzieć się więcej na temat konkretnego stanu zdrowia, możesz zwrócić się do chatbotów, aby uzyskać szybką odpowiedź.

Choć narzędzia językowe AI są szybkie i proste w użyciu, mogą nie chronić żadnych wprowadzanych danych osobowych dotyczących zdrowia, jak ostrzega Światowa Organizacja Zdrowia. Zachowaj ostrożność, jeśli chcesz pisać przypomnienia o wrażliwych lub prywatnych schorzeniach.

Rozmowa z lekarzem to bardziej niezawodny i bezpieczny sposób rozwiązania wszelkich problemów zdrowotnych. Jeśli chodzi o informacje, które chcesz zachować dla siebie, unikaj wprowadzania ich do sztucznej inteligencji.

5. Potencjał cybernękania i znęcania się

Niestety, nowe technologie często mogą powodować szkody. Podobnie jak trolle, obraźliwe modele językowe generowane przez sztuczną inteligencję mogą szybko generować szkodliwe i nękające komentarze. Może to powodować stres i traumę emocjonalną u ofiary.

Ponieważ modele sztucznej inteligencji mogą automatyzować te okrutne wiadomości i generować je na dużą skalę, użytkownicy mogą być przytłoczeni dużą liczbą komentarzy na wielu platformach. Nikt nie chce mieć do czynienia z tego typu treściami za każdym razem, gdy sprawdzasz media społecznościowe lub wysyłasz e-mail.

Nie jest to nowy problem, dlatego istnieją sposoby na zabezpieczenie się przed cyberprzemocą. Według Centrum Badań nad Cyberprzemocą nagrywanie wiadomości, a także zwrócenie się o pomoc do administratora witryny lub operatora telekomunikacyjnego to świetne pierwsze kroki.

Prawie w każdym serwisie społecznościowym obowiązują już zasady postępowania z nienawistnymi wiadomościami od cyberprzestępców. Możesz na przykład zgłosić irytujące wiadomości na Facebooku, obraźliwe wiadomości na Instagramie i skontaktować się z zespołem moderacyjnym TikTok. Zgłaszaj treści, blokuj uciążliwych użytkowników i dostosowuj ustawienia prywatności, aby zmniejszyć ryzyko cyberprzemocy.

Organ zrzeszający krajowe organy nadzorujące prywatność w Europie poinformował w czwartek, że powołał grupę zadaniową zajmującą się ChatGPT

Duńscy i amerykańscy naukowcy współpracowali nad opracowaniem systemu sztucznej inteligencji o nazwie life2vec, zdolnego do przewidywania czasu śmierci człowieka z dużą dokładnością.

Algorytm sztucznej inteligencji o nazwie Audioflow może nasłuchiwać dźwięku oddawania moczu, aby skutecznie i skutecznie identyfikować nieprawidłowe wypływy moczu i powiązane z nimi problemy zdrowotne pacjenta.

Starzenie się i spadek liczby ludności Japonii spowodował, że w kraju brakuje znacznej liczby młodych pracowników, szczególnie w sektorze usług.

Użytkownik Reddita o imieniu u/LegalBeagle1966 jest jednym z wielu użytkowników zakochanych w Claudii, dziewczynie przypominającej gwiazdę filmową, która często udostępnia na tej platformie uwodzicielskie selfie, nawet nagie.

Microsoft właśnie ogłosił, że w jego programie AI for Good weźmie udział 12 kolejnych firm technologicznych.

Użytkownik @mortecouille92 wykorzystał moc narzędzia do projektowania graficznego Midjourney i stworzył wyjątkowo realistyczne wersje słynnych postaci Dragon Ball, takich jak Goku, Vegeta, Bulma i starszy Kame. .

Po prostu dodając pewne warunki lub konfigurując pewne scenariusze, ChatGPT może udzielić bardziej trafnych odpowiedzi na Twoje zapytania. Przyjrzyjmy się sposobom poprawy jakości odpowiedzi ChatGPT.

Midjourney to system sztucznej inteligencji, który wywołał ostatnio „gorączkę” w społeczności internetowej i świecie artystów ze względu na niezwykle piękne obrazy, które nie ustępują tym, które tworzą prawdziwi artyści.

Kilka dni po ogłoszeniu przez Chiny wybuchu epidemii, mając dostęp do danych dotyczących globalnej sprzedaży biletów lotniczych, system sztucznej inteligencji BlueDot w dalszym ciągu dokładnie przewidywał rozprzestrzenianie się wirusa korona z Wuhan do Bangkoku, Seulu, Tajpej i Tokio.