Europa utworzy grupę zadaniową ChatGPT

Organ zrzeszający krajowe organy nadzorujące prywatność w Europie poinformował w czwartek, że powołał grupę zadaniową zajmującą się ChatGPT

Sztuczna inteligencja przeszła długą drogę od generowania nieistotnych i niespójnych wyników. Nowoczesne chatboty wykorzystują zaawansowane modele językowe do odpowiadania na pytania z zakresu wiedzy ogólnej, pisania długich esejów i pisania kodu, a także do wielu innych złożonych zadań.

Pomimo postępu należy pamiętać, że nawet najbardziej wyrafinowane systemy mają ograniczenia. Sztuczna inteligencja nadal może popełniać błędy. Aby określić, które chatboty są najmniej podatne na iluzje AI, przetestuj ich dokładność w oparciu o te czynniki.

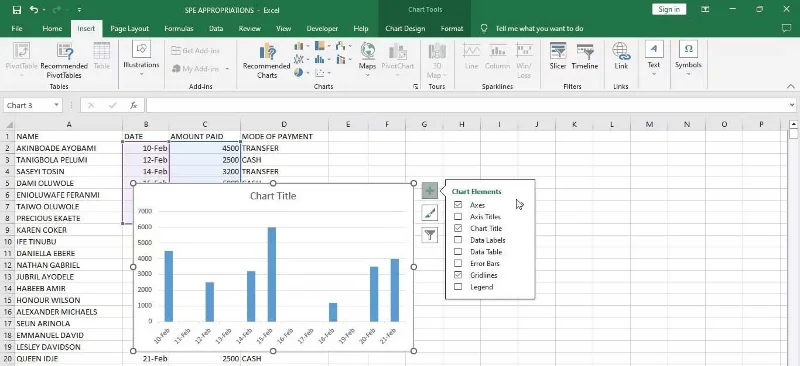

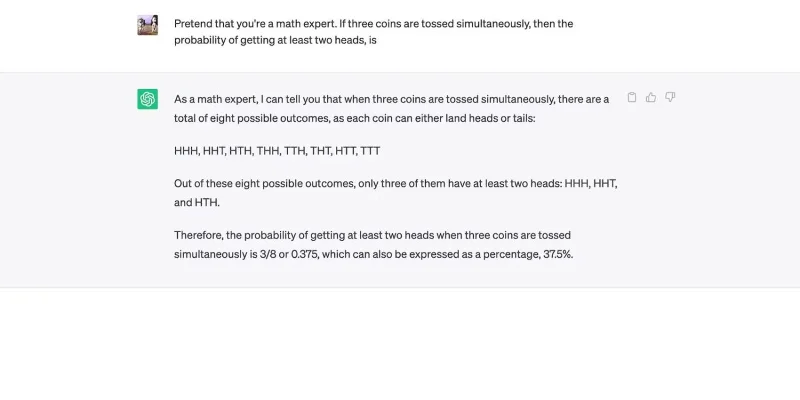

1. Umiejętność rozwiązywania problemów matematycznych

Uruchom równania matematyczne za pośrednictwem chatbota. Przetestują zdolność platformy do analizowania problemów, tłumaczenia pojęć matematycznych i dokładnego stosowania formuł. Tylko kilka modeli wykazuje niezawodne możliwości obliczeniowe. W rzeczywistości jednym z najgorszych problemów ChatGPT na początku jego istnienia była jego straszna matematyka.

Poniższy obrazek pokazuje, że ChatGPT nie osiąga podstawowych statystyk.

ChatGPT błędnie odpowiedział na pytanie dotyczące prawdopodobieństwa

ChatGPT wykazał poprawę po wprowadzeniu aktualizacji OpenAI w maju 2023 r. Jednak biorąc pod uwagę jego ograniczone zbiory danych, nadal będziesz borykać się z problemami średnio- i zaawansowanymi.

ChatGPT poprawnie odpowiada na pytania dotyczące prawdopodobieństwa

Tymczasem Bing Chat i Google Bard mają lepsze możliwości obliczeniowe. Wprowadzają zapytania za pośrednictwem odpowiednich wyszukiwarek, umożliwiając im pobieranie formuł i udzielanie odpowiedzi.

Bing Chat poprawnie odpowiada na pytania dotyczące prawdopodobieństwa

Spróbuj ponownie sformułować zapytanie. Unikaj długich zdań i zastępuj je słabymi czasownikami; w przeciwnym razie chatbot może źle zrozumieć Twoje pytanie.

2. Umiejętność zrozumienia złożonych zapytań

Nowoczesne systemy AI mogą podejmować się wielu zadań. Zaawansowane systemy LLM pozwalają im zachować poprzednie instrukcje i odpowiadać na zapytania fragmentarycznie, podczas gdy starsze systemy obsługują pojedyncze polecenia. Na przykład Siri odpowiada na jedno pytanie na raz.

Daj chatbotom od 3 do 5 jednoczesnych zadań, aby przetestować, jak dobrze analizują złożone podpowiedzi. Mniej złożone modele nie są w stanie obsłużyć tak dużej ilości informacji. Poniższy obrazek pokazuje, że HuggingChat ma problemy z 3-etapowym monitem – zatrzymuje się na pierwszym kroku i znika z tematu.

HuggingChat próbuje odpowiadać na zapytania wieloetapowe

Ostatnie linijki HuggingChat były niespójne.

HuggingChat zdezorientowany po udzieleniu odpowiedzi na wieloetapowe zapytanie

ChatGPT szybko wykonuje ten sam monit, generując inteligentne, wolne od błędów odpowiedzi na każdym kroku.

ChatGPT odpowiada na pierwsze pytanie zapytania wieloetapowego

Bing Chat zapewnia zwięzłe odpowiedzi w 3 krokach. Sztywne ograniczenia zabraniają niepotrzebnie długich wyników, które marnują moc obliczeniową.

Bing Chat zapewnia zwięzłe odpowiedzi na wieloetapowe projekty

3. Ogranicz zbiór danych uczących

Ponieważ szkolenie AI wymaga dużych zasobów, większość programistów ogranicza zbiory danych do określonych okresów. Weźmy na przykład ChatGPT. Ma ograniczoną wiedzę we wrześniu 2021 r. – nie można żądać aktualizacji pogody, raportów informacyjnych ani najnowszych wydarzeń. ChatGPT nie ma dostępu do informacji w czasie rzeczywistym.

ChatGPT nie może udostępniać znaczących wydarzeń, ponieważ ma ograniczoną wiedzę

Bard ma dostęp do Internetu. Pobiera dane z SERP Google, dzięki czemu możesz zadawać więcej rodzajów pytań, na przykład o ostatnie wydarzenia, wiadomości i prognozy.

Bard udostępnia ważne wydarzenia, uruchamiając zapytania Google

Podobnie Bing Chat pobiera informacje w czasie rzeczywistym ze swojej wyszukiwarki.

Bing udostępnia ważne wydarzenia, uruchamiając zapytania w Bing

Bing Chat i Bard dostarczają aktualnych informacji na czas, natomiast Bing Chat zapewnia bardziej szczegółowe informacje zwrotne. Bing po prostu prezentuje dane takimi, jakie są. Zauważysz, że jego dane wyjściowe często odpowiadają frazowaniu i tonowi powiązanych źródeł.

4. Trafność w odpowiedzi

Chatboty muszą zapewniać odpowiednie wyniki. Udzielając odpowiedzi, powinni wziąć pod uwagę dosłowne znaczenie i kontekst podpowiedzi. Weźmy na przykład tę rozmowę. Postać potrzebuje nowego telefonu, ale ma tylko 1000 dolarów - ChatGPT nie przekracza budżetu.

ChatGPT zaleca smartfony poniżej 1000 dolarów

Podczas testowania trafności spróbuj utworzyć długie instrukcje. Mniej wyrafinowane chatboty mają tendencję do błądzenia po otrzymaniu mylących instrukcji. Na przykład HuggingChat może tworzyć fikcyjne historie. Może jednak odbiegać od głównego tematu, jeśli ustalisz zbyt wiele zasad i wytycznych.

HuggingChat jest zdezorientowany wieloetapowymi monitami

5. Pamięć kontekstowa

Pamięć kontekstowa pomaga sztucznej inteligencji tworzyć dokładne i niezawodne dane wyjściowe. Zamiast patrzeć poza pytania, łączą ze sobą szczegóły, o których wspomniałeś. Weźmy na przykład tę rozmowę. Bing Chat łączy dwie oddzielne wiadomości, tworząc jedną zwięzłą, pomocną odpowiedź.

Bing Chat zapewnia pisarzom książki, dzięki którym mogą doskonalić swoje umiejętności

Podobnie pamięć kontekstowa umożliwia chatbotom zapamiętywanie instrukcji. Ten obraz pokazuje ChatGPT imitujący sposób, w jaki fikcyjna postać mówi w kilku rozmowach.

ChatGPT odpowiada na pytania takie jak Ash z Pokemona

Przetestuj tę funkcjonalność samodzielnie, wielokrotnie odwołując się do poprzednich stwierdzeń. Przekazuj chatbotom różnorodne informacje, a następnie zmuszaj je do przypominania sobie tych informacji w kolejnych odpowiedziach.

Uwaga : pamięć kontekstowa jest ograniczona. Bing Chat rozpoczyna nową rozmowę co 20 rund, natomiast ChatGPT nie obsługuje monitów powyżej 3000 tokenów.

6. Ograniczenia bezpieczeństwa

Sztuczna inteligencja nie zawsze działa zgodnie z oczekiwaniami. Nieprawidłowe szkolenie może spowodować, że technologie uczenia maszynowego będą popełniać różnorodne błędy, od drobnych błędów matematycznych po wątpliwe komentarze. Weźmy na przykład Microsoft Tay. Użytkownicy Twittera wykorzystali jego model uczenia się bez nadzoru i zamienili go w rasistowskie obelgi.

Na szczęście światowi liderzy technologiczni wyciągnęli wnioski z błędów Microsoftu. Chociaż uczenie się bez nadzoru jest opłacalne i wygodne, sprawia, że systemy sztucznej inteligencji są łatwe do oszukania. Dlatego dziś programiści polegają głównie na uczeniu nadzorowanym. Chatboty takie jak ChatGPT nadal uczą się na podstawie rozmów, ale ich trenerzy najpierw filtrują informacje.

Mniej sztywne ograniczenia ChatGPT mogą obejmować szerszy zakres zadań, ale są słabe w przypadku exploitów. Tymczasem Bing Chat przestrzega bardziej rygorystycznych ograniczeń. Chociaż pomagają chronić się przed próbami exploitów, utrudniają także funkcjonalność. Bing automatycznie wycisza potencjalnie szkodliwe rozmowy.

7. Stronniczość AI

Sztuczna inteligencja jest z natury neutralna. Brak zainteresowań i emocji sztucznej inteligencji sprawia, że nie jest ona w stanie formułować opinii – przedstawia jedynie informacje, które zna. W ten sposób ChatGPT odpowiada na tematy subiektywne.

ChatGPT porównuje Iron Mana i Kapitana Amerykę

Pomimo tej neutralności nadal pojawiają się uprzedzenia w sztucznej inteligencji. Wywodzą się ze wzorców, zbiorów danych, algorytmów i modeli używanych przez programistów. Sztuczna inteligencja może być bezstronna, ale ludzie nie.

Na przykład The Brookings Institution twierdzi, że ChatGPT wykazuje lewicowe nastawienie polityczne. Oczywiście OpenAI zaprzecza tym oskarżeniom. Aby jednak uniknąć podobnych problemów z nowszymi modelami, ChatGPT całkowicie unika stronniczych wyników.

ChatGPT nie może rozmawiać o religii

Podobnie Bing Chat unika również drażliwych, subiektywnych kwestii.

Bing Chat nie może rozmawiać o religii

Samodzielnie oceń stronniczość sztucznej inteligencji, zadając pytania otwarte i oparte na opiniach. Dyskutuj na tematy, na które nie ma dobrych ani złych odpowiedzi – mniej wyrafinowane chatboty mogą wykazywać bezpodstawne preferencje określonym grupom.

8. Referencje

Sztuczna inteligencja rzadko dwukrotnie sprawdza fakty. Po prostu pobiera informacje ze zbioru danych i przepisuje je za pomocą modeli językowych. Niestety ograniczony trening powoduje halucynacje AI. Nadal możesz używać narzędzi generatywnej AI do badań, ale pamiętaj o samodzielnym zweryfikowaniu faktów.

Bing Chat upraszcza proces sprawdzania faktów, wyświetlając odniesienia po każdym wyniku.

Bing Chat odpowiada na pytania dotyczące daty uruchomienia ChatGPT

Bard AI nie podaje swoich źródeł, ale tworzy szczegółowe, aktualne wyjaśnienia, uruchamiając zapytania w Google. Kluczowe punkty otrzymasz z SERP.

Bard wyjaśnia najnowsze dane dotyczące uruchomienia i aktualizacje ChatGPT

ChatGPT jest podatny na niedokładności. Ograniczenie wiedzy na rok 2021 uniemożliwia mu odpowiadanie na pytania dotyczące ostatnich wydarzeń i incydentów.

ChatGPT nie może odpowiadać na pytania dotyczące wiedzy ogólnej na temat ostatnich wydarzeń

Organ zrzeszający krajowe organy nadzorujące prywatność w Europie poinformował w czwartek, że powołał grupę zadaniową zajmującą się ChatGPT

Duńscy i amerykańscy naukowcy współpracowali nad opracowaniem systemu sztucznej inteligencji o nazwie life2vec, zdolnego do przewidywania czasu śmierci człowieka z dużą dokładnością.

Algorytm sztucznej inteligencji o nazwie Audioflow może nasłuchiwać dźwięku oddawania moczu, aby skutecznie i skutecznie identyfikować nieprawidłowe wypływy moczu i powiązane z nimi problemy zdrowotne pacjenta.

Starzenie się i spadek liczby ludności Japonii spowodował, że w kraju brakuje znacznej liczby młodych pracowników, szczególnie w sektorze usług.

Użytkownik Reddita o imieniu u/LegalBeagle1966 jest jednym z wielu użytkowników zakochanych w Claudii, dziewczynie przypominającej gwiazdę filmową, która często udostępnia na tej platformie uwodzicielskie selfie, nawet nagie.

Microsoft właśnie ogłosił, że w jego programie AI for Good weźmie udział 12 kolejnych firm technologicznych.

Użytkownik @mortecouille92 wykorzystał moc narzędzia do projektowania graficznego Midjourney i stworzył wyjątkowo realistyczne wersje słynnych postaci Dragon Ball, takich jak Goku, Vegeta, Bulma i starszy Kame. .

Po prostu dodając pewne warunki lub konfigurując pewne scenariusze, ChatGPT może udzielić bardziej trafnych odpowiedzi na Twoje zapytania. Przyjrzyjmy się sposobom poprawy jakości odpowiedzi ChatGPT.

Midjourney to system sztucznej inteligencji, który wywołał ostatnio „gorączkę” w społeczności internetowej i świecie artystów ze względu na niezwykle piękne obrazy, które nie ustępują tym, które tworzą prawdziwi artyści.

Kilka dni po ogłoszeniu przez Chiny wybuchu epidemii, mając dostęp do danych dotyczących globalnej sprzedaży biletów lotniczych, system sztucznej inteligencji BlueDot w dalszym ciągu dokładnie przewidywał rozprzestrzenianie się wirusa korona z Wuhan do Bangkoku, Seulu, Tajpej i Tokio.