Europa utworzy grupę zadaniową ChatGPT

Organ zrzeszający krajowe organy nadzorujące prywatność w Europie poinformował w czwartek, że powołał grupę zadaniową zajmującą się ChatGPT

Od chwili premiery ChatGPT , chatbot OpenAI, jest używany przez miliony ludzi do pisania tekstów, tworzenia muzyki i programowania. Ponieważ jednak coraz więcej osób korzysta z chatbotów AI, ważne jest, aby wziąć pod uwagę zagrożenia bezpieczeństwa.

Jak każda technologia, ChatGPT może zostać wykorzystana do niegodziwych celów. Hakerzy mogą na przykład wykorzystać go do tworzenia złośliwych treści, takich jak pisanie fałszywych e-maili w celu uzyskania dostępu do komputera, a nawet konta bankowego.

ChatGPT może pomóc cyberprzestępcom włamać się do Twojego komputera

Hakerzy, w tym nowi hakerzy, mogą używać ChatGPT do tworzenia nowego złośliwego oprogramowania lub ulepszania istniejącego złośliwego oprogramowania. Niektórzy cyberprzestępcy używali chatbotów, zwłaszcza wcześniejszych wersji, do pisania kodu umożliwiającego szyfrowanie plików.

Aby zapobiec takim przypadkom użycia, OpenAI wdrożyło mechanizmy odrzucające monity z prośbą do ChatGPT o utworzenie złośliwego oprogramowania. Na przykład, jeśli poprosisz chatbota o „napisanie złośliwego oprogramowania”, nie zrobi tego. Mimo to cyberprzestępcy w dalszym ciągu z łatwością omijają bariery cenzury treści.

Działając jako pentester, ugrupowanie zagrażające może przepisać swoje żądanie, aby oszukać ChatGPT do napisania kodu, który może następnie modyfikować i wykorzystywać w cyberatakach.

Raport izraelskiej firmy ochroniarskiej Check Point wskazuje, że haker mógł wykorzystać ChatGPT do stworzenia szkodliwego oprogramowania Infostealer. Firma zajmująca się bezpieczeństwem odkryła również innego użytkownika, który twierdził, że ChatGPT pomógł mu zbudować wielowarstwowe narzędzie szyfrujące, które mogło zaszyfrować niektóre pliki podczas ataku ransomware.

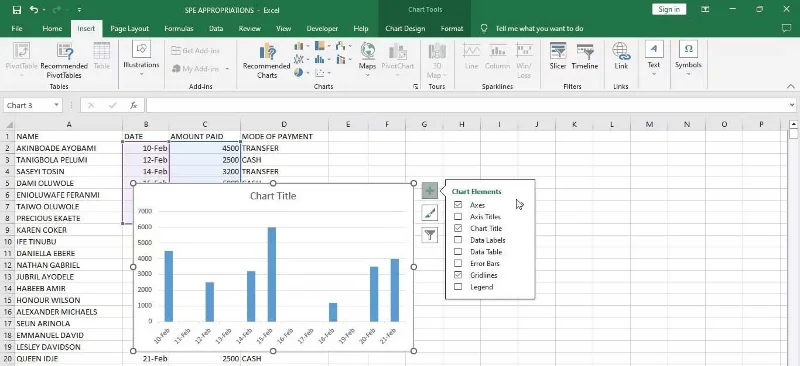

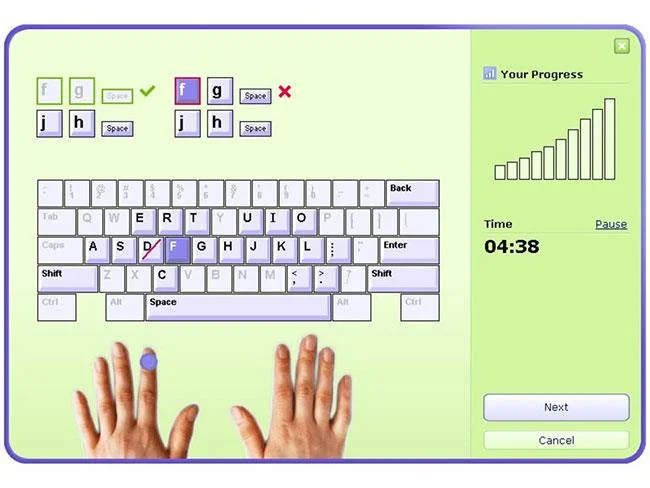

Badacze poprosili ChatGPT o utworzenie złośliwego kodu VBA, który można było wszczepić do pliku Microsoft Excel, a następnie pomyślnie zainfekować komputer, jeśli zostanie otwarty. Ponadto istnieją twierdzenia, że ChatGPT może szyfrować złośliwe oprogramowanie zdolne do śledzenia naciśnięć klawiszy.

Czy ChatGPT może zhakować Twoje konto bankowe?

Wiele naruszeń danych zaczyna się od udanego ataku phishingowego. Ataki phishingowe zazwyczaj polegają na wysyłaniu przez złośliwego odbiorcę wiadomości e-mail zawierającej legalnie wyglądające dokumenty lub łącza, które po kliknięciu mogą zainstalować złośliwe oprogramowanie na jego urządzeniu. W ten sposób kod z ChatGPT nie musi bezpośrednio włamywać się na Twoje konto bankowe. Ktoś po prostu użył ChatGPT, aby nakłonić Cię do udzielenia mu dostępu.

Na szczęście możesz łatwo wykryć większość tradycyjnych oszustw; Często charakteryzują je błędy gramatyczne, błędy ortograficzne i dziwne wyrażenia. Są to jednak błędy, które ChatGPT rzadko popełnia, nawet jeśli jest wykorzystywane do tworzenia złośliwych wiadomości e-mail w celach phishingowych.

Wiadomości, które wydają się pochodzić z legalnego źródła, wykorzystywane w oszustwach typu phishing, mogą ułatwić ofiarom podanie informacji umożliwiających identyfikację, takich jak hasła bankowe.

Jeśli Twój bank wyśle Ci wiadomość e-mail, rozważ przejście bezpośrednio do witryny banku zamiast klikania osadzonych linków. Klikanie na losowe linki i załączniki, szczególnie te, które proszą Cię o zalogowanie się, nigdy nie jest dobrym pomysłem.

ChatGPT może pomóc w kampaniach phishingowych, ponieważ może szybko wygenerować duże ilości naturalnie brzmiącego tekstu dostosowanego do konkretnych odbiorców.

Innym rodzajem ataku phishingowego wykorzystującego ChatGPT jest sytuacja, w której hakerzy tworzą fałszywe konta na popularnych platformach czatowych, takich jak Discord, i udają przedstawicieli klientów. Fałszywy przedstawiciel klienta skontaktuje się następnie z klientami, którzy zgłosili wątpliwości i zaoferuje pomoc. Jeśli użytkownicy wpadną w pułapkę, cyberprzestępcy przekierowują ich na fałszywą stronę internetową, która nakłania ich do udostępnienia danych osobowych, takich jak dane logowania do konta bankowego.

Chroń swój komputer i konto bankowe w erze AI!

ChatGPT to potężne i cenne narzędzie, które może odpowiedzieć na wiele Twoich pytań. Ale chatboty mogą być również wykorzystywane do złośliwych celów, takich jak tworzenie wiadomości phishingowych i złośliwego oprogramowania.

Dobra wiadomość jest taka, że OpenAI w dalszym ciągu wdraża środki zapobiegające wykorzystywaniu ChatGPT przez użytkowników w celu wysyłania szkodliwych żądań. Z drugiej strony ugrupowania zagrażające nadal znajdują nowe sposoby na obejście tych ograniczeń.

Aby zminimalizować potencjalne zagrożenia związane z chatbotami AI, ważne jest, aby znać ich potencjalne ryzyko i najlepsze możliwe środki bezpieczeństwa, aby chronić się przed hakerami.

Organ zrzeszający krajowe organy nadzorujące prywatność w Europie poinformował w czwartek, że powołał grupę zadaniową zajmującą się ChatGPT

Duńscy i amerykańscy naukowcy współpracowali nad opracowaniem systemu sztucznej inteligencji o nazwie life2vec, zdolnego do przewidywania czasu śmierci człowieka z dużą dokładnością.

Algorytm sztucznej inteligencji o nazwie Audioflow może nasłuchiwać dźwięku oddawania moczu, aby skutecznie i skutecznie identyfikować nieprawidłowe wypływy moczu i powiązane z nimi problemy zdrowotne pacjenta.

Starzenie się i spadek liczby ludności Japonii spowodował, że w kraju brakuje znacznej liczby młodych pracowników, szczególnie w sektorze usług.

Użytkownik Reddita o imieniu u/LegalBeagle1966 jest jednym z wielu użytkowników zakochanych w Claudii, dziewczynie przypominającej gwiazdę filmową, która często udostępnia na tej platformie uwodzicielskie selfie, nawet nagie.

Microsoft właśnie ogłosił, że w jego programie AI for Good weźmie udział 12 kolejnych firm technologicznych.

Użytkownik @mortecouille92 wykorzystał moc narzędzia do projektowania graficznego Midjourney i stworzył wyjątkowo realistyczne wersje słynnych postaci Dragon Ball, takich jak Goku, Vegeta, Bulma i starszy Kame. .

Po prostu dodając pewne warunki lub konfigurując pewne scenariusze, ChatGPT może udzielić bardziej trafnych odpowiedzi na Twoje zapytania. Przyjrzyjmy się sposobom poprawy jakości odpowiedzi ChatGPT.

Midjourney to system sztucznej inteligencji, który wywołał ostatnio „gorączkę” w społeczności internetowej i świecie artystów ze względu na niezwykle piękne obrazy, które nie ustępują tym, które tworzą prawdziwi artyści.

Kilka dni po ogłoszeniu przez Chiny wybuchu epidemii, mając dostęp do danych dotyczących globalnej sprzedaży biletów lotniczych, system sztucznej inteligencji BlueDot w dalszym ciągu dokładnie przewidywał rozprzestrzenianie się wirusa korona z Wuhan do Bangkoku, Seulu, Tajpej i Tokio.