Europa utworzy grupę zadaniową ChatGPT

Organ zrzeszający krajowe organy nadzorujące prywatność w Europie poinformował w czwartek, że powołał grupę zadaniową zajmującą się ChatGPT

W miarę jak ludzkość wkracza w przyszłość, perspektywy systemów opartych na sztucznej inteligencji staną się bardziej atrakcyjne. Sztuczna inteligencja pomoże ludziom podejmować decyzje, zasilać inteligentne miasta i niestety także infekować komputery wszelkiego rodzaju paskudnym złośliwym oprogramowaniem.

W następnym artykule przeanalizujmy, jak sztuczna inteligencja będzie wpływać na złośliwe oprogramowanie w przyszłości.

Jak będzie wyglądać przyszłe złośliwe oprogramowanie z pomocą sztucznej inteligencji?

Używając terminu „złośliwe oprogramowanie kontrolowane przez sztuczną inteligencję”, czytelnicy z łatwością wyobrażają sobie scenariusz: sztuczna inteligencja powoduje zniszczenie niczym „terminator”. W rzeczywistości złośliwe programy kontrolowane przez sztuczną inteligencję działają w ukryciu

Złośliwe oprogramowanie wykorzystujące sztuczną inteligencję to zwykłe złośliwe oprogramowanie, które jest modyfikowane przez sztuczną inteligencję w celu zwiększenia jego skuteczności. Złośliwe oprogramowanie wykorzystujące sztuczną inteligencję może wykorzystywać swoją inteligencję do szybszego infekowania komputerów lub przeprowadzania skuteczniejszych ataków. Zamiast być „głupim” programem w sieci, który postępuje zgodnie z preinstalowanym kodem, złośliwe oprogramowanie kontrolowane przez sztuczną inteligencję może w pewnym stopniu „myśleć samodzielnie”.

Istnieje wiele sposobów, w jakie sztuczna inteligencja może wzmocnić złośliwe oprogramowanie. Niektóre z tych metod są metaforyczne, podczas gdy wiele innych jest w jakiś sposób namacalnych w realnym świecie.

Jednym z przykładów złośliwego oprogramowania wykorzystującego sztuczną inteligencję jest Deeplocker. Na szczęście dział IBM Research opracował to złośliwe oprogramowanie jako dowód koncepcji, której nie można znaleźć w prawdziwym życiu.

Koncepcja DeepLocker pokazała, w jaki sposób sztuczna inteligencja może wprowadzić oprogramowanie ransomware do urządzenia docelowego. Twórcy złośliwego oprogramowania mogą przeprowadzić atak na firmę za pomocą oprogramowania ransomware, ale jest bardzo mało prawdopodobne, że uda im się zainfekować krytyczne komputery. W efekcie alerty mogą zostać wywołane zbyt wcześnie, zanim złośliwe oprogramowanie dotrze do najważniejszych celów.

DeepLocker nie aktywuje ładunku. Zamiast tego wykonuje jedynie swoje obowiązki jako program do telekonferencji.

Kiedy wykona swoją pracę, skanuje twarze osób, które z niego korzystały. Celem DeepLocker jest zainfekowanie komputera konkretnej osoby, aby śledzić osoby korzystające z oprogramowania. Kiedy wykryje twarz celu, aktywuje ładunek i powoduje zablokowanie komputera przez WannaCry .

Jednym z teoretycznych sposobów wykorzystania sztucznej inteligencji w złośliwym oprogramowaniu jest użycie robaka do „zapamiętywania” każdorazowego wykrycia go przez program antywirusowy. Kiedy już dowie się, jakie działanie powoduje wykrycie go przez program antywirusowy, zaprzestanie wykonywania tego działania i znajdzie inny sposób na zainfekowanie komputera.

Jest to szczególnie niebezpieczne, ponieważ nowoczesne oprogramowanie antywirusowe zwykle działa według ścisłych zasad i definicji. Oznacza to, że robak musi jedynie znaleźć sposób, aby nie wywołać alarmu. Gdy uda się to zrobić pomyślnie, może poinformować inne szczepy wirusów o lukach w ich zabezpieczeniach, umożliwiając im łatwiejsze infekowanie większej liczby komputerów.

Obecne szkodliwe oprogramowanie jest dość „głupie”, nie potrafi „myśleć” ani podejmować decyzji. Wykonuje szereg zadań, które twórca szkodliwego oprogramowania przypisał mu przed wystąpieniem infekcji. Jeśli twórcy szkodliwego oprogramowania chcą, aby zrobiło ono coś nowego, muszą przygotować listę instrukcji, których powinien przestrzegać szkodliwy program.

To centrum kontaktowe nazywa się serwerem dowodzenia i kontroli (C&C) i musi być wyjątkowo dobrze ukryte. Jeśli ten serwer zostanie wykryty, haker może zostać aresztowany.

Jeśli jednak złośliwe oprogramowanie potrafi samodzielnie myśleć, serwer kontroli i kontroli nie jest potrzebny. Hakerzy mogą pozwolić złośliwemu oprogramowaniu działać swobodnie i po prostu usiąść, podczas gdy złośliwe oprogramowanie wykona całą pracę. Oznacza to, że twórca złośliwego oprogramowania nie musi ryzykować wydawania poleceń. Po prostu skonfiguruj i pozwól złośliwemu oprogramowaniu wykonać swoją pracę.

Jeśli złośliwe oprogramowanie oparte na sztucznej inteligencji przejmie kontrolę nad mikrofonem celu, może podsłuchiwać i nagrywać, co mówią ludzie w pobliżu. Następnie sztuczna inteligencja udostępnia to, co słyszy, konwertuje to na tekst, a następnie wysyła tekst z powrotem do twórcy szkodliwego oprogramowania. Ułatwia to życie hakerom, ponieważ nie muszą godzinami siedzieć, nagrywając i zgłębiając tajemnice handlowe.

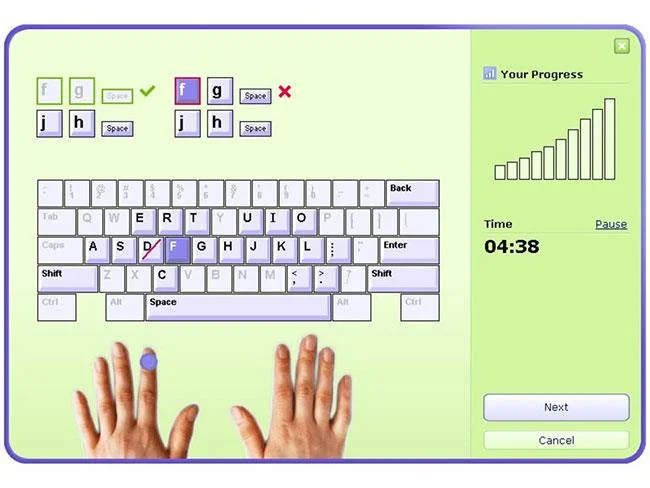

Złośliwe oprogramowanie może uczyć się na podstawie swoich działań w ramach tak zwanego „ uczenia maszynowego ”. Jest to specyficzny obszar sztucznej inteligencji, zajmujący się tym, w jaki sposób komputery mogą uczyć się na podstawie swoich wysiłków. Uczenie maszynowe jest przydatne dla twórców sztucznej inteligencji, ponieważ nie muszą oni kodować na potrzeby każdego scenariusza. Mówią sztucznej inteligencji, co jest poprawne, a co nie, a następnie pozwalają jej uczyć się metodą prób i błędów.

Kiedy sztuczna inteligencja, „wytrenowana” przez uczenie maszynowe, napotka przeszkodę, będzie próbowała różnymi metodami ją pokonać. Początkowo nie poradzi sobie zbyt dobrze z pokonaniem wyzwania, ale komputer zauważy, co zostało zrobione źle i co można poprawić. Dzięki wielu iteracjom uczenia się i prób ostatecznie wyłoni się idea „właściwej” odpowiedzi.

Przykład tego procesu możesz zobaczyć na powyższym filmie. Film pokazuje sztuczną inteligencję uczącą się, jak sprawić, by różne stworzenia chodziły prawidłowo. Kilka pierwszych pokoleń chodzi jak pijane, ale późniejsze pokolenia zaczną utrzymywać prawidłową postawę. Dzieje się tak, ponieważ sztuczna inteligencja wyciągnęła wnioski z poprzednich niepowodzeń i radziła sobie lepiej w późniejszych modelach.

Twórcy złośliwego oprogramowania korzystają z mocy uczenia maszynowego, aby dokładnie dowiedzieć się, jak zaatakować system. Jeśli wystąpi błąd, system rejestruje błąd i podaje przyczynę. W przyszłości złośliwe oprogramowanie będzie dostosowywać swoje wzorce ataków, aby uzyskać lepsze wyniki.

Dużym problemem sztucznej inteligencji „wytrenowanej” w uczeniu maszynowym jest to, że wykorzystuje ona sposób działania obecnych programów antywirusowych. Oprogramowanie antywirusowe lubi działać według prostych zasad. Jeśli program odpowiada temu, co program antywirusowy uznaje za złośliwy, program antywirusowy go zablokuje.

Jednak złośliwe oprogramowanie wykorzystujące sztuczną inteligencję nie będzie działać według stałych, z góry ustalonych zasad. Będzie stale atakował system obronny, próbując znaleźć sposób na przedostanie się przez niego. Po przeniknięciu do systemu może bez problemu wykonywać swoje zadania, dopóki oprogramowanie antywirusowe nie otrzyma aktualizacji specyficznych dla zagrożenia.

Jaki jest zatem najlepszy sposób na walkę z tym sprytnym złośliwym oprogramowaniem? Czasami trzeba walczyć z ogniem, a najlepszym sposobem na osiągnięcie tego jest opracowanie programów antywirusowych opartych na sztucznej inteligencji. Wykorzystują one stałe reguły do przechwytywania złośliwego oprogramowania, podobnie jak wiele obecnych modeli. Zamiast tego analizują działanie programu i blokują go, jeśli działa złośliwie, z punktu widzenia programu antywirusowego.

Podstawowe zasady i proste wytyczne nie pozwolą zidentyfikować przyszłych ataków złośliwego oprogramowania. Zamiast tego będą korzystać z uczenia maszynowego, aby dostosować się i dostosować do wszelkich napotkanych metod bezpieczeństwa. Może nie jest to tak ekscytujące, jak Hollywood przedstawia złośliwą sztuczną inteligencję, ale zagrożenie jest bardzo realne.

Organ zrzeszający krajowe organy nadzorujące prywatność w Europie poinformował w czwartek, że powołał grupę zadaniową zajmującą się ChatGPT

Duńscy i amerykańscy naukowcy współpracowali nad opracowaniem systemu sztucznej inteligencji o nazwie life2vec, zdolnego do przewidywania czasu śmierci człowieka z dużą dokładnością.

Algorytm sztucznej inteligencji o nazwie Audioflow może nasłuchiwać dźwięku oddawania moczu, aby skutecznie i skutecznie identyfikować nieprawidłowe wypływy moczu i powiązane z nimi problemy zdrowotne pacjenta.

Starzenie się i spadek liczby ludności Japonii spowodował, że w kraju brakuje znacznej liczby młodych pracowników, szczególnie w sektorze usług.

Użytkownik Reddita o imieniu u/LegalBeagle1966 jest jednym z wielu użytkowników zakochanych w Claudii, dziewczynie przypominającej gwiazdę filmową, która często udostępnia na tej platformie uwodzicielskie selfie, nawet nagie.

Microsoft właśnie ogłosił, że w jego programie AI for Good weźmie udział 12 kolejnych firm technologicznych.

Użytkownik @mortecouille92 wykorzystał moc narzędzia do projektowania graficznego Midjourney i stworzył wyjątkowo realistyczne wersje słynnych postaci Dragon Ball, takich jak Goku, Vegeta, Bulma i starszy Kame. .

Po prostu dodając pewne warunki lub konfigurując pewne scenariusze, ChatGPT może udzielić bardziej trafnych odpowiedzi na Twoje zapytania. Przyjrzyjmy się sposobom poprawy jakości odpowiedzi ChatGPT.

Midjourney to system sztucznej inteligencji, który wywołał ostatnio „gorączkę” w społeczności internetowej i świecie artystów ze względu na niezwykle piękne obrazy, które nie ustępują tym, które tworzą prawdziwi artyści.

Kilka dni po ogłoszeniu przez Chiny wybuchu epidemii, mając dostęp do danych dotyczących globalnej sprzedaży biletów lotniczych, system sztucznej inteligencji BlueDot w dalszym ciągu dokładnie przewidywał rozprzestrzenianie się wirusa korona z Wuhan do Bangkoku, Seulu, Tajpej i Tokio.