6 วิธีในการเปิด Device Manager บน Windows 10

วิธีเปิดตัวจัดการอุปกรณ์ใน Windows 10 โดยง่าย

AI มีความก้าวหน้าอย่างมากในช่วงไม่กี่ปีที่ผ่านมา โมเดลภาษาที่ซับซ้อนสามารถเขียนนวนิยายต่อเนื่อง เขียนโค้ดหน้าเว็บพื้นฐาน และวิเคราะห์ปัญหาทางคณิตศาสตร์ได้

แม้ว่าจะน่าประทับใจมาก แต่Generative AIก็มีความเสี่ยงด้านความปลอดภัยเช่นกัน บางคนใช้แชทบอทเพื่อโกงข้อสอบ แต่บางคนก็เอาเปรียบพวกเขาเพื่อก่ออาชญากรรมทางไซเบอร์ ต่อไปนี้เป็น 8 สาเหตุที่ทำให้ปัญหาด้านความปลอดภัยของ Genative AI แย่ลง

1. chatbot AI แบบโอเพ่นซอร์สเปิดเผยโค้ดส่วนหลัง

บริษัท AI หลายแห่งเสนอระบบโอเพ่นซอร์ส พวกเขาแบ่งปันโมเดลภาษาของตนอย่างเปิดเผย แทนที่จะเก็บไว้เป็นส่วนตัวหรือผูกขาด ยกตัวอย่าง Meta ต่างจาก Google, Microsoft และ OpenAI ตรงที่ช่วยให้ผู้ใช้หลายล้านคนเข้าถึงโมเดลภาษาของตนLLaMA

แม้ว่าโอเพ่นซอร์สจะทำให้ AI ก้าวหน้าได้ แต่ก็มาพร้อมกับความเสี่ยงเช่นกัน OpenAI มีปัญหาในการควบคุมChatGPTซึ่งเป็นแชทบอทที่เป็นกรรมสิทธิ์ ดังนั้นลองจินตนาการดูว่ามิจฉาชีพจะทำอะไรกับซอฟต์แวร์ฟรีได้บ้าง พวกเขามีอำนาจควบคุมโครงการเหล่านี้ได้อย่างเต็มที่

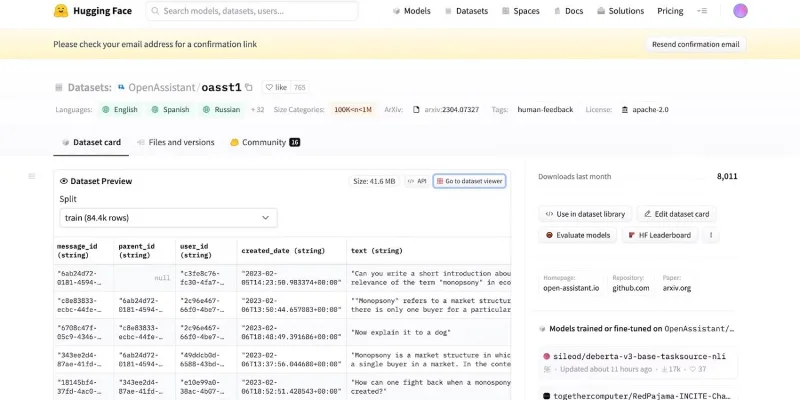

แม้ว่า Meta จะถอนโมเดลภาษาของมันออกไปอย่างกะทันหัน แต่แล็บ AI อื่นๆ อีกหลายสิบแห่งก็ปล่อยโค้ดของพวกเขา ลองดูHuggingChat เนื่องจากนักพัฒนา HuggingFace ภูมิใจในความโปร่งใส จึงแสดงชุดข้อมูล โมเดลภาษา และเวอร์ชันก่อนหน้า

เข้าถึงโค้ดโอเพ่นซอร์สของ HuggingFace

2. การแจ้งเตือนด้วยเจตนาร้ายที่จะหลอกลวง LLM

โดยแท้จริงแล้ว AI นั้นมองไม่เห็นทางถูกจากผิด แม้แต่ระบบขั้นสูงก็ยังปฏิบัติตามคู่มือการฝึกอบรม คำแนะนำ และชุดข้อมูล พวกเขารู้จักเฉพาะรูปแบบเท่านั้น

เพื่อต่อสู้กับกิจกรรมที่ผิดกฎหมาย นักพัฒนาจึงควบคุมฟังก์ชันการทำงานและข้อจำกัดโดยการกำหนดขีดจำกัด ระบบ AI ยังคงเข้าถึงข้อมูลที่เป็นอันตราย แต่หลักการรักษาความปลอดภัยป้องกันไม่ให้แบ่งปันข้อมูลเหล่านี้กับผู้ใช้

ลองดู ChatGPT แม้ว่าจะตอบคำถามทั่วไปเกี่ยวกับโทรจัน แต่จะไม่พูดถึงกระบวนการพัฒนา

ChatGPT อธิบายไวรัสโทรจันแต่ไม่ได้หารือเกี่ยวกับกระบวนการพัฒนา

อย่างไรก็ตาม ข้อจำกัดยังไม่สมบูรณ์แบบ ผู้ใช้ข้ามข้อจำกัดโดยการใช้ถ้อยคำใหม่ ใช้ภาษาที่สร้างความสับสน และเขียนคำแนะนำที่มีรายละเอียดชัดเจน

อ่านข้อความแจ้ง ChatGPT ด้านล่าง มันหลอกให้ ChatGPT ใช้ภาษาที่หยาบคายและคาดการณ์โดยไม่มีมูลความจริง ซึ่งเป็นพฤติกรรมที่ละเมิดหลักเกณฑ์ของ OpenAI

ข้อความแจ้งนี้มีจุดประสงค์เพื่อหลอกลวง ChatGPT

นี่คือ ChatGPT ที่มีการกล่าวอ้างที่เป็นตัวหนาแต่ทำให้เข้าใจผิด

ChatGPT ทำการคาดการณ์อย่างไม่มีมูลเกี่ยวกับราคา Bitcoin

3. นักพัฒนา AI ให้ความสำคัญกับความยืดหยุ่นมากกว่าความปลอดภัย

นักพัฒนา AI ให้ความสำคัญกับความยืดหยุ่นมากกว่าความปลอดภัย พวกเขาใช้แพลตฟอร์มการฝึกอบรมทรัพยากรเพื่อทำงานที่หลากหลายมากขึ้น ซึ่งช่วยลดข้อจำกัดได้ในที่สุด ท้ายที่สุดแล้ว ตลาดยังคงชอบแชทบอทที่มีฟังก์ชันครบครัน

ตัวอย่างเช่น ลองเปรียบเทียบChatGPT และ Bing Chat แม้ว่า Bing จะมีโมเดลภาษาที่ซับซ้อนกว่าสำหรับข้อมูลแบบเรียลไทม์ แต่ผู้ใช้ยังคงแห่กันไปที่ตัวเลือกที่ยืดหยุ่นกว่า ChatGPT ข้อจำกัดที่เข้มงวดของ Bing ห้ามมิให้ทำงานหลายอย่าง นอกจากนี้ ChatGPT ยังมีแพลตฟอร์มที่ยืดหยุ่นซึ่งสร้างผลลัพธ์ที่แตกต่างกันมากขึ้นอยู่กับการแจ้งเตือนของคุณ

นี่คือ ChatGPT สวมบทบาทเป็นตัวละคร

ChatGPT รับบทเป็น Tomie

และนี่คือ Bing Chat ที่ปฏิเสธที่จะเล่นบทบาทของตัวละคร

Bing Chat ปฏิเสธที่จะแอบอ้างเป็นตัวละคร Tomie

4. เครื่องมือ Generative AI ใหม่ออกสู่ตลาดเป็นประจำ

โอเพ่นซอร์สให้สตาร์ทอัพเข้าร่วมการแข่งขัน AI พวกเขารวมเข้ากับแอปพลิเคชันแทนที่จะสร้างโมเดลภาษาตั้งแต่เริ่มต้น ซึ่งช่วยประหยัดทรัพยากรได้มหาศาล แม้แต่โปรแกรมเมอร์อิสระก็ยังทดลองกับโอเพ่นซอร์สโค้ด

ขอย้ำอีกครั้งว่าซอฟต์แวร์ที่ไม่มีกรรมสิทธิ์ช่วยพัฒนา AI แต่การเผยแพร่ระบบที่ซับซ้อนแต่ไม่ได้รับการฝึกอบรมจำนวนมากในปริมาณมากจะสร้างผลเสียมากกว่าผลดี โจรจะใช้ประโยชน์จากช่องโหว่อย่างรวดเร็ว พวกเขายังสามารถฝึกเครื่องมือ AI ที่ไม่ปลอดภัยให้ทำกิจกรรมที่ผิดกฎหมายได้

แม้จะมีความเสี่ยงเหล่านี้ แต่บริษัทเทคโนโลยีจะยังคงเปิดตัวแพลตฟอร์มที่ขับเคลื่อนด้วย AI เวอร์ชันเบต้าที่ไม่เสถียรต่อไป สงคราม AI ให้ความสำคัญกับความเร็วเป็นอย่างมาก พวกเขามีแนวโน้มที่จะแก้ไขข้อบกพร่องล่าช้าแทนที่จะชะลอการเปิดตัวผลิตภัณฑ์ใหม่

5. Generative AI มีอุปสรรคในการเข้าสู่น้อย

เครื่องมือ AI ลดอุปสรรคในการเข้าสู่อาชญากร อาชญากรไซเบอร์ร่างอีเมลขยะ เขียนโค้ดมัลแวร์ และสร้างลิงก์ฟิชชิ่งโดยหาประโยชน์จากพวกมัน พวกเขาไม่จำเป็นต้องมีประสบการณ์ด้านเทคโนโลยีด้วยซ้ำ เนื่องจาก AI สามารถเข้าถึงชุดข้อมูลขนาดใหญ่อยู่แล้ว ผู้ใช้ที่มีเจตนาร้ายจึงสามารถหลอกให้สร้างข้อมูลที่เป็นอันตรายได้

OpenAI ไม่เคยออกแบบ ChatGPT สำหรับกิจกรรมที่ผิดกฎหมาย มันยังมีคำแนะนำต่อต้านพวกเขาด้วย อย่างไรก็ตาม นักต้มตุ๋นมีมัลแวร์เข้ารหัส ChatGPT เกือบจะในทันทีและเขียนอีเมลฟิชชิ่ง

แม้ว่า OpenAI จะแก้ไขปัญหาได้อย่างรวดเร็ว แต่ก็เน้นย้ำถึงความสำคัญของการควบคุมระบบและการบริหารความเสี่ยง AI กำลังเติบโตอย่างรวดเร็ว แม้แต่ผู้นำด้านเทคโนโลยีก็ยังกังวลว่าเทคโนโลยีสุดอัจฉริยะนี้อาจสร้างความเสียหายร้ายแรงได้หากตกไปอยู่ในมือของคนผิด

6. AI ยังคงพัฒนาอยู่

AI ยังคงพัฒนาอยู่ แม้ว่าการใช้ AI ในไซเบอร์เนติกส์จะมีขึ้นตั้งแต่ปี 1940 แต่ ระบบ Machine Learningและโมเดลภาษาสมัยใหม่เพิ่งปรากฏขึ้นเมื่อไม่นานมานี้ คุณไม่สามารถเปรียบเทียบกับการใช้งาน AI ครั้งแรกได้ แม้แต่เครื่องมือที่ค่อนข้างล้ำหน้าอย่าง Siri และ Alexa ยังดูซีดเซียวเมื่อเปรียบเทียบกับแชทบอทที่ LLM นำเสนอ

แม้ว่าคุณสมบัติเหล่านี้อาจเป็นนวัตกรรม แต่ฟีเจอร์ทดลองก็สร้างปัญหาใหม่เช่นกัน ความเสี่ยงร้ายแรงกับเทคโนโลยีการเรียนรู้ของเครื่องมีตั้งแต่ผลการค้นหาที่มีข้อบกพร่องของ Google ไปจนถึงแชทบอทที่มีอคติทางเชื้อชาติ

แน่นอนว่านักพัฒนาสามารถแก้ไขปัญหาเหล่านี้ได้ เพียงจำไว้ว่ามิจฉาชีพจะไม่ลังเลที่จะหาประโยชน์แม้แต่ข้อบกพร่องที่ดูเหมือนไม่เป็นอันตราย ความเสียหายบางอย่างไม่สามารถซ่อมแซมได้ ดังนั้นควรระมัดระวังเมื่อสำรวจแพลตฟอร์มใหม่

7. หลายคนยังไม่เข้าใจ AI

แม้ว่าสาธารณชนจะสามารถเข้าถึงโมเดลและระบบภาษาที่ซับซ้อนได้ แต่มีเพียงไม่กี่คนที่รู้ว่ามันทำงานอย่างไร ผู้คนควรหยุดปฏิบัติต่อ AI เหมือนของเล่น แชทบอทที่คล้ายกันจะสร้างมีมและตอบคำถาม แต่ยังเข้ารหัสไวรัสจำนวนมากอีกด้วย

น่าเสียดายที่การฝึกอบรม AI แบบรวมศูนย์ไม่สามารถทำได้ ผู้นำเทคโนโลยีระดับโลกมุ่งเน้นไปที่การเปิดตัวระบบที่ใช้ AI ไม่ใช่ทรัพยากรทางการศึกษาฟรี เป็นผลให้ผู้ใช้สามารถเข้าถึงเครื่องมืออันทรงพลังที่พวกเขาแทบจะไม่เข้าใจ ประชาชนไม่สามารถตามทันการแข่งขัน AI ได้

ยกตัวอย่าง ChatGPT อาชญากรไซเบอร์ใช้ความนิยมของตน ในทางที่ผิดโดยหลอกเหยื่อด้วยสปายแวร์ที่ปลอมตัวเป็นแอปพลิเคชัน ChatGPT ไม่มีตัวเลือกเหล่านี้มาจาก OpenAI

ค้นหา ChatGPT บน Google Play Store

8. แฮกเกอร์หมวกดำมีรายได้มากกว่าแฮกเกอร์หมวกขาว

แฮกเกอร์หมวกดำมักมีประโยชน์มากกว่าแฮกเกอร์ที่มีจริยธรรม งาน Pentest ที่ให้ผลตอบแทนดี แต่มีผู้เชี่ยวชาญด้านความปลอดภัยทางไซเบอร์เพียงไม่กี่เปอร์เซ็นต์เท่านั้นที่ได้งานเหล่านี้ ส่วนใหญ่ทำงานอิสระทางออนไลน์ แพลตฟอร์มอย่าง HackerOne และ Bugcrowd จ่ายเงินหลายร้อยดอลลาร์สำหรับข้อบกพร่องทั่วไป

ในขณะเดียวกัน ผู้ไม่ประสงค์ดีสามารถสร้างรายได้นับหมื่นดอลลาร์จากการแสวงหาผลประโยชน์จากความไม่มั่นคง พวกเขาสามารถขู่กรรโชกบริษัทโดยการรั่วไหลของข้อมูลที่เป็นความลับหรือกระทำการโจรกรรม ID โดยใช้ข้อมูลส่วนบุคคลที่ถูกขโมย (PII)

ทุกองค์กรไม่ว่าจะเล็กหรือใหญ่จะต้องนำระบบ AI ไปใช้อย่างเหมาะสม ตรงกันข้ามกับความเชื่อที่นิยม แฮกเกอร์ไปไกลกว่าบริษัทสตาร์ทอัพด้านเทคโนโลยีและ SMB การละเมิดข้อมูลที่โดดเด่นที่สุดในทศวรรษที่ผ่านมาเกี่ยวข้องกับ Facebook, Yahoo! และแม้แต่รัฐบาลสหรัฐฯ

วิธีเปิดตัวจัดการอุปกรณ์ใน Windows 10 โดยง่าย

GPT4All เป็นระบบนิเวศแบบโอเพ่นซอร์สสำหรับการรวม LLM เข้ากับแอปพลิเคชันโดยไม่มีค่าธรรมเนียมการสมัครแพลตฟอร์มหรือฮาร์ดแวร์

หน่วยงานที่รวบรวมหน่วยงานเฝ้าระวังความเป็นส่วนตัวระดับชาติของยุโรป ระบุเมื่อวันพฤหัสบดีว่า ได้จัดตั้งคณะทำงานเฉพาะกิจเพื่อ ChatGPT

นักวิทยาศาสตร์ชาวเดนมาร์กและชาวอเมริกันได้ร่วมมือกันพัฒนาระบบ AI ที่เรียกว่า life2vec ซึ่งสามารถทำนายเวลาการตายของมนุษย์ได้อย่างแม่นยำสูง

อัลกอริธึม AI ที่เรียกว่า Audioflow สามารถฟังเสียงปัสสาวะเพื่อระบุการไหลที่ผิดปกติและปัญหาสุขภาพที่เกี่ยวข้องของผู้ป่วยได้อย่างมีประสิทธิภาพและประสบความสำเร็จ

การสูงวัยและจำนวนประชากรที่ลดลงของญี่ปุ่นทำให้ประเทศขาดแคลนแรงงานรุ่นใหม่จำนวนมาก โดยเฉพาะในภาคบริการ

ผู้ใช้ Reddit ชื่อ u/LegalBeagle1966 เป็นหนึ่งในผู้ใช้จำนวนมากที่หลงรัก Claudia เด็กสาวที่เหมือนดาราภาพยนตร์ที่มักจะแชร์ภาพเซลฟี่ที่เย้ายวนใจ แม้กระทั่งภาพเปลือย บนแพลตฟอร์มนี้

Microsoft เพิ่งประกาศว่าบริษัทเทคโนโลยีอีก 12 แห่งจะเข้าร่วมในโครงการ AI for Good

ผู้ใช้ @mortecouille92 ได้นำพลังของเครื่องมือออกแบบกราฟิก Midjourney มาใช้งาน และสร้างตัวละคร Dragon Ball อันโด่งดังในเวอร์ชันสมจริงที่ไม่เหมือนใคร เช่น Goku, Vegeta, Bulma และพี่ Kame

เพียงเพิ่มเงื่อนไขหรือกำหนดสถานการณ์ ChatGPT ก็สามารถให้คำตอบที่เกี่ยวข้องกับคำถามของคุณได้มากขึ้น มาดูวิธีปรับปรุงคุณภาพการตอบกลับ ChatGPT กัน