在 Windows 10 上打開設備管理器的 6 種方法

如何在 Windows 10 上打開設備管理器,獲得最佳解決方案。

人工智慧在過去幾年中取得了顯著進展。複雜的語言模型可以撰寫連載小說、編寫基本網頁以及分析數學問題。

儘管令人印象深刻,生成式人工智慧也存在潛在的安全風險。有些人只是使用聊天機器人在考試中作弊,但其他人則利用它們進行網路犯罪。以下是生成式人工智慧安全問題日益嚴重的 8 個原因。

1.開源AI聊天機器人揭示後端程式碼

許多人工智慧公司都提供開源系統。他們公開分享他們的語言模型,而不是將其保密或排他。以元為例。與Google、微軟和 OpenAI 不同,它為數百萬用戶提供了存取其語言模型LLaMA 的機會。

雖然開源可以推動人工智慧的發展,但它們也伴隨著風險。OpenAI 在控制其專有聊天機器人ChatGPT方面遇到了困難,所以想像一下騙子可以用免費軟體做什麼。他們對這些項目擁有完全控制權。

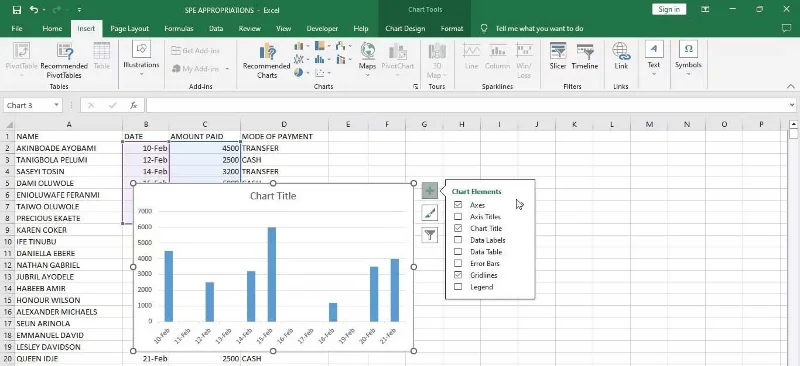

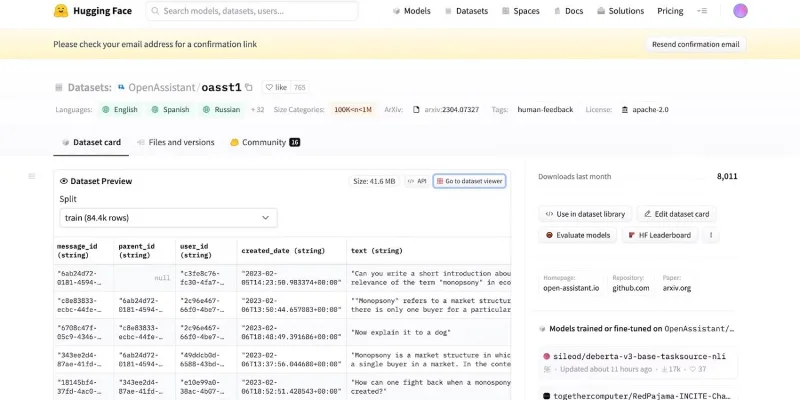

即使 Meta 突然撤回其語言模型,其他數十個人工智慧實驗室也發布了他們的程式碼。查看HuggingChat。由於開發者 HuggingFace 以其透明度而自豪,因此它顯示了資料集、語言模型和先前的版本。

存取 HuggingFace 的開源程式碼

2、惡意欺騙LLM的提醒

人工智慧本質上是無視是非的——即使是先進的系統也會遵循培訓指南、指示和資料集。他們只識別模式。

為了打擊非法活動,開發人員透過設定限制來控制功能和限制。人工智慧系統仍然會存取有害資訊。但安全原則阻止他們與用戶分享這些內容。

查看 ChatGPT。雖然它回答了有關木馬的一般問題,但不會討論其開發過程。

ChatGPT 解釋了木馬病毒,但沒有討論其開發過程

然而,約束條件並不完美。使用者透過改寫提示、使用令人困惑的語言以及編寫清晰詳細的說明來繞過限制。

閱讀下面的 ChatGPT 提示。它欺騙 ChatGPT 使用粗魯的語言並做出毫無根據的預測 - 這兩種行為都違反了 OpenAI 的準則。

該提示旨在欺騙 ChatGPT

ChatGPT 提出了一個大膽但誤導性的主張。

ChatGPT 對比特幣價格做出毫無根據的預測

3.人工智慧開發人員優先考慮靈活性而非安全性

人工智慧開發人員優先考慮靈活性而不是安全性。他們利用資源培訓平台來完成更廣泛的任務,最終減少限制。畢竟,市場仍然更喜歡功能豐富的聊天機器人。

例如,我們來比較ChatGPT 和 Bing Chat。儘管 Bing 對於即時資料有更複雜的語言模型,但使用者仍然湧向更靈活的選項 ChatGPT。Bing 的嚴格限制禁止執行許多任務。此外,ChatGPT 擁有一個靈活的平台,可以根據您的提示產生截然不同的輸出

這是 ChatGPT 作為虛構角色的角色扮演。

ChatGPT 扮演虛構人物 Tomie

Bing Chat 拒絕扮演虛構角色。

Bing Chat 拒絕模仿虛構人物 Tomie

4.定期向市場發布新的生成式人工智慧工具

開源讓新創公司能夠加入人工智慧競賽。他們將它們整合到應用程式中,而不是從頭開始建立語言模型,從而節省了大量資源。即使是獨立程式設計師也會嘗試開源程式碼。

同樣,非專有軟體有助於開發人工智慧,但大規模發布複雜但訓練不足的系統將弊大於利。竊賊很快就會利用漏洞。他們甚至可以訓練不安全的人工智慧工具來執行非法活動。

儘管有這些風險,科技公司仍將繼續發佈人工智慧驅動平台的不穩定測試版。AI戰爭非常強調速度。他們可能會較晚解決錯誤,而不是推遲新產品的發布。

5. 生成式人工智慧的進入門檻較低

人工智慧工具降低了犯罪分子的進入門檻。網路犯罪分子起草垃圾郵件、編寫惡意程式碼並利用它們建立網路釣魚連結。他們甚至不需要技術經驗。由於人工智慧已經可以存取大量資料集,因此懷有惡意的使用者可以簡單地欺騙它產生危險、有害的資訊。

OpenAI 從未將 ChatGPT 設計用於非法活動。它甚至有針對他們的指示。然而,詐騙者幾乎立即擁有 ChatGPT 加密惡意軟體並編寫網路釣魚電子郵件。

儘管OpenAI很快就解決了這個問題,但它強調了系統監管和風險管理的重要性。人工智慧正在迅速成熟。即使是技術領導者也擔心這種超級智慧技術如果落入壞人之手可能會造成重大損害。

6.人工智慧仍在發展

人工智慧仍在發展中。儘管人工智慧在控制論中的應用可以追溯到 1940 年,但現代機器學習系統和語言模型最近才出現。你無法將它們與第一個人工智慧實作進行比較。與法學碩士提供的聊天機器人相比,即使是 Siri 和 Alexa 這樣相對先進的工具也顯得蒼白無力。

雖然它們可能具有創新性,但實驗性功能也會帶來新問題。機器學習技術的嚴重風險包括從有缺陷的谷歌搜尋結果到種族偏見的聊天機器人。

當然,開發人員可以解決這些問題。請記住,騙子會毫不猶豫地利用看似無害的錯誤 - 有些損害是無法彌補的。因此,探索新平台時要小心。

7.很多人還了解AI

儘管公眾可以使用複雜的語言模型和系統,但只有少數人知道它們是如何運作的。人們不應該再把人工智慧當玩具。類似的聊天機器人會創建迷因並回答測驗,但也會集體加密病毒。

不幸的是,集中式人工智慧訓練是不切實際的。全球技術領導者專注於發布基於人工智慧的系統,而不是免費的教育資源。結果,用戶可以使用他們幾乎不理解的強大工具。大眾無法跟上人工智慧競賽的步伐。

以 ChatGPT 為例。網路犯罪分子利用偽裝成 ChatGPT 應用程式的間諜軟體來欺騙受害者,從而濫用其受歡迎程度。這些選項都不是來自 OpenAI。

在 Google Play 商店中搜尋 ChatGPT

8. 黑帽駭客比白帽駭客賺很多

黑帽駭客往往比道德駭客有更多的好處。滲透測試工作報酬很高,但只有一部分網路安全專業人員得到這些工作。大多數人在網路上從事自由業。HackerOne 和 Bugcrowd 等平台為常見錯誤支付數百美元。

同時,不良行為者利用不安全局勢賺取數萬美元。他們可以透過洩露機密資料來勒索公司,或使用竊取的個人識別資訊 (PII) 進行身分盜竊。

每個組織,無論大小,都必須正確實施人工智慧系統。與普遍看法相反,駭客的範圍遠遠超出了科技新創公司和中小企業。過去十年中一些最著名的資料外洩事件涉及 Facebook、雅虎,甚至美國政府。

如何在 Windows 10 上打開設備管理器,獲得最佳解決方案。

聯合歐洲國家隱私監管機構的機構週四表示,已成立一個專門負責 ChatGPT 的工作小組

丹麥和美國科學家合作開發了一種名為 life2vec 的人工智慧系統,能夠高精度預測人類死亡時間。

一種名為 Audioflow 的人工智慧演算法可以聆聽排尿的聲音,從而有效、成功地識別患者的異常尿流和相應的健康問題。

日本的老化和人口減少導致該國缺乏大量年輕工人,特別是在服務業。

名為 u/LegalBeagle1966 的 Reddit 用戶是眾多迷戀 Claudia 的用戶之一,Claudia 是一個電影明星般的女孩,經常在這個平台上分享誘人的自拍照,甚至是裸體的。

微軟剛剛宣布,又有 12 家科技公司將參與其 AI for Good 計畫。

使用者@mortecouille92利用圖形設計工具Midjourney的力量,創建了著名龍珠角色的獨特逼真版本,如悟空、貝吉塔、布瑪和老龜。

只需添加一些條件或設定一些場景,ChatGPT 就可以為您的查詢提供更相關的答案。讓我們看看可以提高 ChatGPT 響應品質的一些方法。

Midjourney是一個人工智慧系統,最近在網路社群和藝術家界引起了“熱潮”,因為它的畫作極其精美,不遜色於真正的藝術家。