在 Windows 10 上打開設備管理器的 6 種方法

如何在 Windows 10 上打開設備管理器,獲得最佳解決方案。

當今人工智慧(AI)模型在語言處理中的最大挑戰之一是理解每個特定片段的上下文和上下文,從而理解整個段落的內容,或者更廣泛地說,整個作品的確切含義- 而不是像今天一樣簡單地理解每個單字的意思。

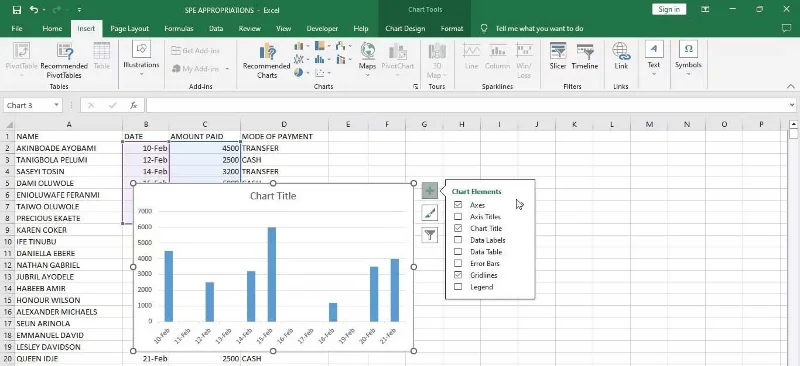

為了解決這個問題,Google推出了一種名為Reformer 的新機器學習模型,它可以理解一部100 萬行長的作品的內容和上下文——相當於一本小說,同時只需要使用大約16GB 的存儲空間。Reformer 的發展是為了克服 Transformer 的缺點,Transformer 是一種老式的神經網絡,其工作原理是透過比較段落中的單字來理解它們之間的關係。

然而,由於 Transformer 採用組合配對的方式運行,如果需要處理超過幾千字的文本,Transformer 會佔用大量的資料空間。這個弱點使得使用 Transformer 處理長文章或書籍極為不可行。

Google 開發 Reformer 是為了解決上面提到的兩個主要問題:處理長文件的能力和舊模型的記憶體消耗。

為了解決第一個問題,Google的新模型使用了一種稱為局部敏感雜湊(LSH)的方法。也就是說,新模型不再像以前那樣比較所有單詞,而是使用雜湊函數將相似的單字連接到一個組中,然後比較同一組內或組內附近的單詞,從而有助於限制處理過載並在同時提供處理大量文字的能力。

為了解決記憶體消耗問題,研究人員使用了一種稱為可逆殘差網路(RevNet)的技術。RevNet 是從深度殘差網路 (ResNets) 發展而來的,這是一種隨著網路變得更深更寬而提高效能的技術。RevNets 擁有自己的層,其中每層的輸出資料都可以重建並在另一層中使用。因此,大多數層的輸出資料在反向傳播期間不需要儲存在記憶體中。

為了測試模型的有效性,Google向 Reformer 提供了一些經過裁剪的小圖像,並從中創建了一張全畫幅照片。

谷歌工程師表示,新模型可以輕鬆、高精準度地處理整本書,開啟了大規模文字處理的潛力。

如何在 Windows 10 上打開設備管理器,獲得最佳解決方案。

聯合歐洲國家隱私監管機構的機構週四表示,已成立一個專門負責 ChatGPT 的工作小組

丹麥和美國科學家合作開發了一種名為 life2vec 的人工智慧系統,能夠高精度預測人類死亡時間。

一種名為 Audioflow 的人工智慧演算法可以聆聽排尿的聲音,從而有效、成功地識別患者的異常尿流和相應的健康問題。

日本的老化和人口減少導致該國缺乏大量年輕工人,特別是在服務業。

名為 u/LegalBeagle1966 的 Reddit 用戶是眾多迷戀 Claudia 的用戶之一,Claudia 是一個電影明星般的女孩,經常在這個平台上分享誘人的自拍照,甚至是裸體的。

微軟剛剛宣布,又有 12 家科技公司將參與其 AI for Good 計畫。

使用者@mortecouille92利用圖形設計工具Midjourney的力量,創建了著名龍珠角色的獨特逼真版本,如悟空、貝吉塔、布瑪和老龜。

只需添加一些條件或設定一些場景,ChatGPT 就可以為您的查詢提供更相關的答案。讓我們看看可以提高 ChatGPT 響應品質的一些方法。

Midjourney是一個人工智慧系統,最近在網路社群和藝術家界引起了“熱潮”,因為它的畫作極其精美,不遜色於真正的藝術家。