Chacun d'entre nous a sûrement rencontré plus ou moins une situation dans laquelle le cadre d'affichage vidéo est « irrégulier » lorsque vous le regardez sur un appareil mobile. La contrariété et l'agacement sont probablement des sentiments qui apparaissent immédiatement, mais vous devez quand même l'accepter et regarder la vidéo en entier car vous ne pouvez tout simplement pas faire autre chose.

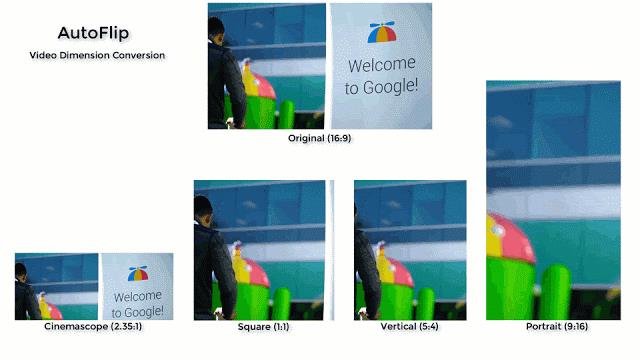

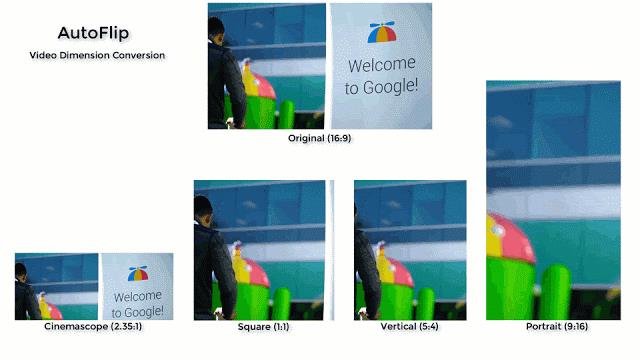

Pour résoudre ce problème apparemment mineur mais qui a un impact important sur l'expérience utilisateur, l'équipe de recherche en IA de Google a développé avec succès une solution open source appelée Autoflip, qui peut automatiquement affiner les vidéos afin qu'elles s'adaptent à un appareil ou à une taille d'écran donné dans une variété de modes, tels que paysage, carré, portrait, etc.

Fondamentalement, Autoflip fonctionne en trois étapes principales : détection de scène, analyse du contenu vidéo et enfin réglage fin.

Lors de la phase de détection de scène, le modèle d'apprentissage automatique accordera une grande attention au point avant de couper ou de passer d'une scène à une autre. Grâce à cela, il peut comparer une image avec l’image précédente pour détecter les changements de couleurs et d’éléments associés.

Après avoir identifié un plan de référence, le modèle d'IA passera à l'analyse du contenu vidéo pour identifier les objets importants dans une scène. Pour ce faire, Autoflip utilisera un réseau neuronal d'apprentissage profond qui l'aidera à identifier clairement non seulement les objets apparaissant dans la scène, tels que les personnes, les animaux, les véhicules, les arbres... mais aussi le mouvement ainsi que l'état de déplacement de l'objet. objet.

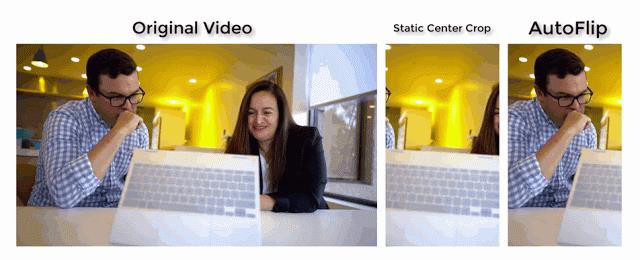

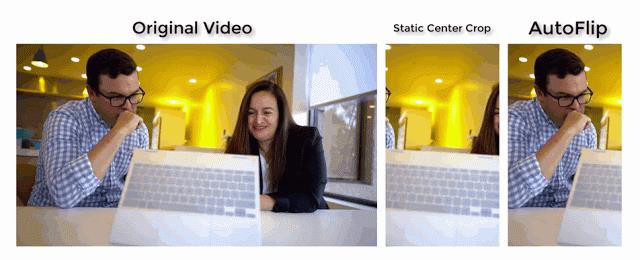

Dans la dernière étape, le modèle d'IA détermine s'il doit utiliser le mode stationnaire pour les scènes qui se déroulent dans un seul espace ou le mode de suivi lorsque les objets d'intérêt sont constamment en mouvement. En fonction de ce facteur et de la taille cible que la vidéo doit afficher, Autoflip recadrera le cadre d'affichage pour garantir la fluidité et surtout conserver tout le contenu intéressant.

Les chercheurs de Google AI affirment qu’Autoflip peut être utilisé pour convertir des vidéos en plusieurs formats et tailles d’écran sans intervention humaine. Dans la prochaine étape, l'équipe souhaite améliorer la capacité d'Autoflip à suivre les sujets dans les interviews et les dessins animés. Pour ce faire, le modèle d’IA doit être équipé de techniques de détection d’images et de textes flous afin de mieux placer les objets de premier plan et d’arrière-plan dans un cadre.

Vous pouvez vous référer au code d'Autoflip ICI .