GPT-4 a réussi l'examen de licence médicale américaine, répondant correctement à 90 % des questions. De nombreux scientifiques ont été surpris par les bonnes capacités de diagnostic et de traduction des maladies du dernier modèle d'intelligence artificielle d'OpenAI.

Le Dr Isaac Kohane, informaticien à l'Université Harvard et médecin, et deux collègues ont testé les performances de GPT-4 dans un environnement médical.

Le Dr Kohane a écrit dans le prochain livre The AI Revolution in Medicine qu'il trouvait que GPT-4 était meilleur que de nombreux médecins qu'il avait évalués.

Non seulement il est un outil de recherche d'informations ou un bon « candidat », GPT-4 est également considéré comme un traducteur talentueux par M. Kohane et ses collègues. Il est capable de traduire les informations de sortie d'hôpital pour un patient lusophone, traduisant un langage technique complexe en informations simples que même un élève de 6e peut lire et comprendre.

De plus, GPT-4 peut résumer de longs rapports et études, donner des suggestions utiles sur la façon de soigner et de parler aux patients.

Les produits d'OpenAi peuvent même utiliser des méthodes qui nécessitent des techniques de mesure et de calcul pour expliquer les causes des problèmes de la même manière que le font souvent les humains.

Bien qu’il existe de nombreuses limites et que le diagnostic ne soit pas toujours parfait, le GPT-4 peut toujours imiter la façon dont les médecins diagnostiquent les maladies.

![Le GPT-4 est-il meilleur que certains médecins en exercice ? Le GPT-4 est-il meilleur que certains médecins en exercice ?]()

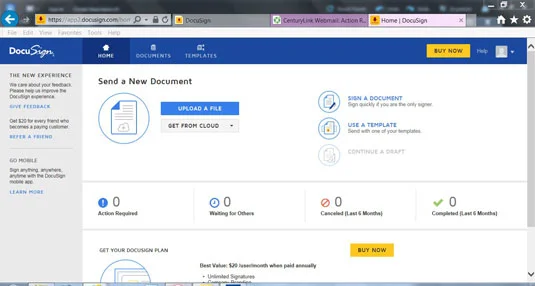

Dr Isaac Kohane. Photo : École de médecine de Harvard.

Le Dr Kohane a utilisé un cas réel qu'il a traité il y a plusieurs années pour tester la capacité du GPT-4 à diagnostiquer la maladie. Le patient est un nouveau-né. Il a fourni quelques détails sur le bébé ainsi que des informations échographiques et des niveaux d'hormones, et les résultats du GPT-4 ont permis de diagnostiquer avec précision l'état de l'enfant comme une hyperplasie congénitale des surrénales (HCA).

Le Dr Kohane a été extrêmement surpris car GPT-4 pouvait diagnostiquer avec précision les maladies, ce qui lui a pris de nombreuses années d'études et de travail pour pouvoir le faire.

GPT-4 fait toujours des erreurs

GPT-4 présente encore de nombreuses limites et comporte des erreurs fondamentales telles qu'une mauvaise écriture de l'IMC, une mauvaise résolution de puzzles de Sudoku ou la résolution d'équations incorrectes, ainsi que de graves erreurs lors de la prescription ou du diagnostic de maladies.

Lorsque l'équipe de recherche a posé des questions sur ce problème, GPT-4 a déclaré qu'elle commettait parfois des erreurs ou faisait des hypothèses basées sur des données incomplètes ou inexactes, mais n'avait pas l'intention de mentir ou d'induire qui que ce soit en erreur.

GPT-4 a déclaré : « Je n’ai pas la même capacité de diagnostic clinique ni la même responsabilité éthique qu’un médecin ou une infirmière. »