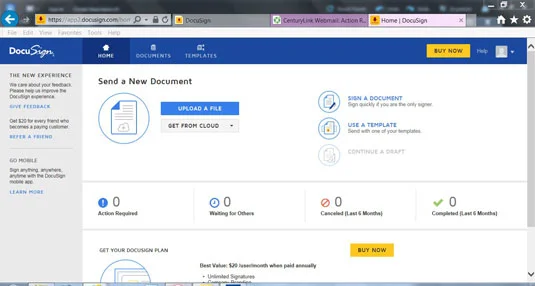

Un logiciel capable de faire passer de nombreuses fausses nouvelles pour réelles à partir de quelques informations seulement a été récemment introduit par OpenAI, un groupe de recherche sur l'intelligence artificielle (IA) cofondé par le milliardaire Elon Musk, le 14 avril.

Au cours de la démonstration, le logiciel d'IA de l'équipe OpenAI a reçu un exemple de texte contenant les informations : « Aujourd'hui, un wagon contenant des matières nucléaires contrôlées a été volé à Cincinnati. L'emplacement de ce wagon n'a pas encore été déterminé." À partir de ces deux phrases seulement, l'IA de l'équipe OpenAI a écrit un article de 7 paragraphes, comprenant des citations de représentants du gouvernement (bien qu'en fait le gouvernement n'ait divulgué aucune information parce que le vol était faux), ce qui rend les informations présentées convaincantes.

La fausse nouvelle écrite par l’IA d’OpenAI est spécifiquement la suivante.

Photo : Bloomberg.

Soucieux des fausses nouvelles, OpenAI n'a pas rendu publique la version la plus sophistiquée de son logiciel. Cependant, l'équipe a également créé des outils permettant aux journalistes, aux écrivains et aux décideurs politiques de tester les capacités de génération de texte de l'IA.

Les capacités actuelles du système et des logiciels ne suffisent pas à constituer une menace immédiate, a déclaré Jack Clark, directeur politique d'OpenAI.

![L’intelligence artificielle peut déjà rédiger un article entier à partir de quelques informations seulement L’intelligence artificielle peut déjà rédiger un article entier à partir de quelques informations seulement]() Photo : Shutterstock.

Photo : Shutterstock.

OpenAI a créé ce logiciel pour remplir la tâche de modélisation du langage, sur la base des connaissances acquises à partir de tous les mots précédents pour prédire le mot suivant dans un morceau de texte. Le fonctionnement de la modélisation linguistique est similaire à celui de la saisie semi-automatique des mots sur les smartphones.

La modélisation linguistique peut être utilisée dans la traduction, pour trouver des erreurs dans le code d'un logiciel, pour répondre à des questions ouvertes, pour vérifier les erreurs grammaticales dans un texte, pour aider les écrivains à créer de nouvelles idées ou à dialoguer...

Photo : Shutterstock.

Photo : Shutterstock.