De ChatGPT-taskforce zal door Europa worden opgericht

Het orgaan dat de nationale privacywaakhonden van Europa verenigt, zei donderdag dat het een taskforce heeft opgericht die zich specifiek bezighoudt met ChatGPT

Kunnen kunstmatige-intelligentiemodellen helpen bij het navigeren door gebieden (straten) waarop ze nog nooit eerder zijn getraind, of waarvoor ze niet voldoende trainingsgegevens hebben gekregen? Dat is waar wetenschappers van het DeepMind-ontwikkelingsteam voor kunstmatige intelligentie zich zorgen over maken. En na vele jaren van incubatie hebben wetenschappers eindelijk succes geboekt in een onderzoeksproject genaamd: "Cross-View Policy Learning for Street Navigation", onlangs onthuld in een artikel gepubliceerd op Arxiv.org.

In dit onderzoek beschrijven DeepMind-wetenschappers de ontwikkeling van een AI-beleid dat is getraind vanuit een rijk datawarehouse met vele invalshoeken (meestal beelden van boven naar beneden), gericht op verschillende delen van de stad, voor een meer optimale observatie-efficiëntie. De onderzoekers zijn van mening dat een dergelijke aanpak tot betere generalisatieresultaten zou leiden.

In essentie is dit onderzoek geïnspireerd door het feit dat mensen zich snel kunnen aanpassen aan de indeling en basisstructuur van een nieuwe stad door de kaart van die stad vele malen zorgvuldig te bestuderen.

“Het vermogen om te navigeren op basis van visuele observaties in onbekende omgevingen is een kerncomponent bij het bestuderen van het vermogen van AI-modellen om navigatie te leren. Het vermogen van AI-modellen om door de straten te navigeren in gevallen waarin er sprake is van een gebrek aan trainingsgegevens is tot nu toe relatief beperkt geweest, en vertrouwen op simulatiemodellen is geen oplossing die op de lange termijn effectief kan zijn. Ons kernidee is om het grondbeeld te koppelen aan het luchtbeeld en gemeenschappelijk beleid te onderzoeken dat het schakelen tussen standpunten mogelijk maakt”, aldus een vertegenwoordiger van het onderzoeksteam.

Meer specifiek is de eerste stap die onderzoekers zullen moeten doen het verzamelen van luchtkaarten van het gebied waarin ze willen navigeren (gecombineerd met straatobservatiemodi op basis van geografische coördinaten). Vervolgens begonnen ze aan een driedelige teleportatiemissie, beginnend met het trainen van de gegevens en het aanpassen van het brongebied met behulp van luchtobservaties van het gebied, en eindigend met verplaatsing naar het doelgebied met behulp van grondobservaties.

Het machine learning-systeem van het onderzoeksteam bestaat uit een set van 3 afzonderlijke modules, waaronder:

Dit machine learning-model werd ingezet in StreetAir – een buitenstraatomgeving met meerdere perspectieven – gebouwd bovenop StreetLearn. (StreetLearn is de eerste interactieve verzameling panoramische foto's uit Google Street View en Google Maps).

In StreetAir en StreetLearn zijn luchtfoto's met panoramische uitzichten over New York City (inclusief Downtown NYC en Midtown NYC) en Pittsburgh (campussen van Allegheny College en Carnegie Mellon University) zo gerangschikt dat op elke breedtegraad, graden en lengtegraden, de omgeving vanuit de lucht terugkeert afbeeldingen met een formaat van 84 x 84, hetzelfde formaat als afbeeldingen vanaf de grond.

Het AI-systeem zal, na een training te hebben gevolgd, de taak krijgen om te leren hoe een panoramische Street View-beeldkaart met de lengte- en breedtegraadcoördinaten van de bestemming moet worden gelokaliseerd en genavigeerd.

De panorama's bestrijken gebieden van 2-5 km aan een kant, ongeveer 10 meter uit elkaar, en (AI-gestuurde) voertuigen mogen 1 van de 5 acties per beurt uitvoeren: vooruit rijden, 22,5 graden naar links of rechts draaien of 67,5 graden naar links of rechts draaien graden.

Bij het naderen van de doellocatie binnen 100-200 meter zullen deze voertuigen "beloningen" ontvangen om het identificeren en passeren van kruispunten snel en nauwkeurig aan te moedigen.

In experimenten bereikten voertuigen die luchtbeelden gebruikten om zich aan te passen aan nieuwe omgevingen beloningsstatistieken van 190 bij 100 miljoen stappen en 280 bij 200 miljoen stappen, beide aanzienlijk hoger vergeleken met voertuigen die alleen grondobservatiegegevens gebruikten (50 bij 100 miljoen stappen en 200 bij 200 miljoen stappen). miljoen stappen). Volgens de onderzoekers toonden de resultaten aan dat hun methode het vermogen van de voertuigen om effectiever kennis te verwerven over meerdere delen van de doelstad aanzienlijk verbetert.

Het orgaan dat de nationale privacywaakhonden van Europa verenigt, zei donderdag dat het een taskforce heeft opgericht die zich specifiek bezighoudt met ChatGPT

Deense en Amerikaanse wetenschappers hebben samengewerkt om een AI-systeem te ontwikkelen genaamd life2vec, dat in staat is om het tijdstip van menselijke dood met hoge nauwkeurigheid te voorspellen.

Een AI-algoritme genaamd Audioflow kan naar het geluid van het plassen luisteren om abnormale stromingen en bijbehorende gezondheidsproblemen van de patiënt effectief en met succes te identificeren.

Door de vergrijzing en de afnemende bevolking van Japan heeft het land een aanzienlijk aantal jonge werknemers nodig, vooral in de dienstensector.

Een Reddit-gebruiker genaamd u/LegalBeagle1966 is een van de vele gebruikers die verliefd zijn op Claudia, een filmsterachtig meisje dat vaak verleidelijke selfies deelt, zelfs naakte, op dit platform.

Microsoft heeft zojuist aangekondigd dat nog twaalf technologiebedrijven zullen deelnemen aan zijn AI for Good-programma.

Gebruiker @mortecouille92 heeft de kracht van de grafische ontwerptool Midjourney aan het werk gezet en uniek realistische versies gemaakt van beroemde Dragon Ball-personages zoals Goku, Vegeta, Bulma en oudere Kame.

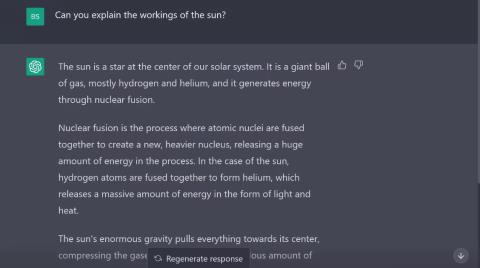

Door enkele voorwaarden toe te voegen of enkele scenario's in te stellen, kan ChatGPT relevantere antwoorden op uw vragen geven. Laten we eens kijken naar enkele manieren waarop u de kwaliteit van uw ChatGPT-reacties kunt verbeteren.

Midjourney is een kunstmatig intelligentiesysteem dat de laatste tijd voor ‘koorts’ zorgt in de online community en de kunstenaarswereld vanwege zijn buitengewoon mooie schilderijen die niet onderdoen voor die van echte kunstenaars.

Dagen nadat China de uitbraak had aangekondigd, bleef het AI-systeem van BlueDot, met toegang tot wereldwijde gegevens over de verkoop van vliegtickets, nauwkeurig de verspreiding van het Wuhan Corona-virus naar Bangkok, Seoul, Taipei en Tokio voorspellen.