ChatGPT y otras tecnologías de aprendizaje de idiomas se han convertido en herramientas poderosas y apenas están comenzando a impactar sectores como el de la salud. Sin embargo, es importante tener cuidado al utilizar estas herramientas con respecto a su propia salud. Si bien su potencial es prometedor, es esencial comprender las limitaciones y los riesgos asociados con estas tecnologías. Así es como ChatGPT y sistemas de IA generativa similares pueden afectar su salud.

1. Preocupaciones sobre la IA

Aunque el término ansiedad por la IA existe desde hace varios años, según el Journal of the Association for Information Science and Technology, el rápido ritmo del desarrollo de la IA sigue preocupando a muchas personas.

Afortunadamente, hay formas de superar la ansiedad por la IA y al mismo tiempo mantenerse al día con los rápidos desarrollos de la tecnología. Por ejemplo, informarse sobre los chatbots e incorporar algo de IA en su propia vida puede ayudar a eliminar muchos de sus misterios, según Everyday Health.

Para muchas personas, el factor desconocido es parte de lo que hace que el rápido aumento de la IA sea tan inquietante, por lo que familiarizarse con los conceptos básicos es un buen punto de partida. Si bien puede parecer un poco contradictorio, experimentar con Bard o ChatGPT puede ayudar a que la aplicación sea más accesible en general.

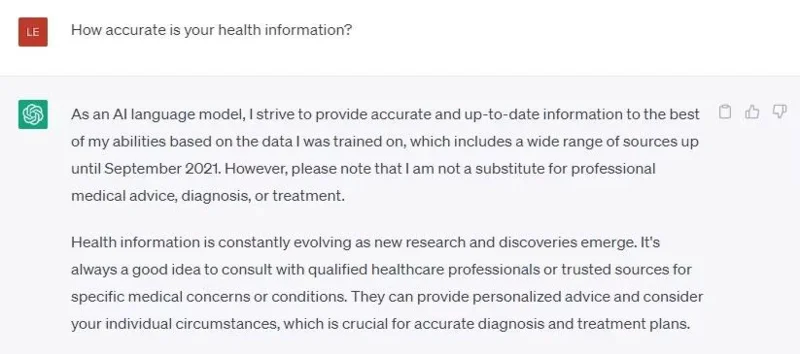

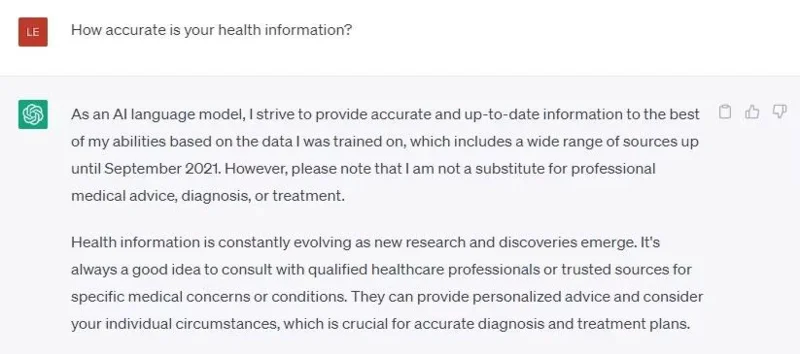

2. Información de salud inexacta

La forma en que modelos como ChatGPT responden a las indicaciones hace que parezca que lo saben todo. Sin embargo, es importante tener cuidado con sus respuestas, especialmente cuando se trata de preguntas de salud.

Aunque ChatGPT puede proporcionar información de salud confiable en algunos casos, la aplicación aún puede causar alucinaciones y brindar consejos de salud inexactos. Lo más probable es que no confíe en que los resultados de búsqueda de Google proporcionen datos de salud precisos y personalizados, por lo que es aconsejable abordar la tecnología de inteligencia artificial con tanta precaución.

Si tiene alguna pregunta seria sobre su salud, es mejor comunicársela a su proveedor de atención médica. Además, es probable que los profesionales de la salud consideren muchos factores, incluidos su historial médico, sus síntomas y su salud general. Es posible que los modelos de IA no puedan manejar todos estos factores en la misma medida (al menos no completamente).

Así que capte la indirecta y comuníquese con su médico sobre problemas de salud. Ni siquiera el mejor modelo de lenguaje puede proporcionar diagnósticos personalizados.

3. Aumenta el comportamiento de adicción a la tecnología

![5 posibles impactos negativos para la salud de la tecnología de IA generativa 5 posibles impactos negativos para la salud de la tecnología de IA generativa]()

La adicción a la tecnología ya es una preocupación. En particular, la adicción a las redes sociales y a los teléfonos inteligentes ha aumentado rápidamente en los últimos años. Para muchas personas, estas tecnologías que crean hábito son difíciles de romper, y las personas en línea informan informalmente sentimientos de adicción a ChatGPT y aplicaciones de inteligencia artificial similares.

De hecho, los expertos dicen que la tecnología de inteligencia artificial empeorará el problema de la adicción digital en los próximos años, según el Pew Research Center. "La adicción digital, que ya es un problema para muchas personas que juegan videojuegos, miran videos de TikTok o YouTube, o que miran cada tweet, podría convertirse en un problema aún mayor a medida que estos canales y otras tecnologías digitales sean aún más personalizados", dijo Gary Grossman. dijo en el informe vicepresidente senior y líder global del Centro de Excelencia de IA de Edelman.

Si bien esto puede parecer malo, ciertamente hay medidas que puedes tomar para reducir tu dependencia del uso de Internet, la inteligencia artificial y la tecnología en general.

4. Preocupaciones por la privacidad de los datos sanitarios

Para muchas personas, es fácil utilizar recursos como ChatGPT para las preguntas cotidianas. Por ejemplo, la próxima vez que desee obtener más información sobre una condición de salud específica, puede recurrir a estos chatbots para obtener una respuesta rápida.

Si bien son rápidas y sencillas de usar, es posible que las herramientas de lenguaje de inteligencia artificial no protejan los datos de salud personales que ingrese, como advierte la Organización Mundial de la Salud. Tenga cuidado si desea escribir recordatorios sobre condiciones de salud sensibles o privadas.

Hablar con su proveedor de atención médica sigue siendo una forma más confiable y segura de abordar cualquier problema de salud. Cuando se trata de información que desee conservar para usted, evite ingresarla en la IA.

5. Potencial de ciberacoso e intimidación

Desafortunadamente, las nuevas tecnologías a menudo tienen el potencial de causar daño. Al igual que los troll bots, los modelos de lenguaje abusivos generados por IA pueden generar rápidamente comentarios dañinos y acosadores. Esto puede causar estrés y trauma emocional a la persona objetivo.

Dado que los modelos de IA pueden automatizar estos mensajes crueles y generarlos a escala, las personas pueden sentirse abrumadas por la gran cantidad de comentarios en múltiples plataformas. Nadie quiere lidiar con este tipo de contenido cada vez que consulta las redes sociales o envía un correo electrónico.

Este no es un problema nuevo, por lo que existen formas de protegerse del ciberacoso. Según el Cyberbullying Research Center, grabar mensajes y solicitar ayuda al administrador de su sitio web o a su compañía telefónica son excelentes primeros pasos.

Casi todos los sitios de redes sociales ya cuentan con políticas para manejar estos mensajes de odio de los ciberacosadores. Por ejemplo, puede denunciar mensajes molestos en Facebook, denunciar mensajes abusivos en Instagram y ponerse en contacto con el equipo de moderación de TikTok. Informe contenido, bloquee usuarios problemáticos y ajuste la configuración de privacidad para reducir el riesgo de acoso cibernético.