A pesar de las impresionantes capacidades de ChatGPT , varias grandes empresas han prohibido a sus empleados utilizar este chatbot de IA.

En mayo de 2023, Samsung prohibió el uso de ChatGPT y otras herramientas de IA generativa . Luego, en junio de 2023, el Commonwealth Bank de Australia, junto con empresas como Amazon, Apple y JPMorgan Chase & Co, también implementaron la restricción. Algunos hospitales, bufetes de abogados y agencias gubernamentales también han prohibido a sus empleados utilizar ChatGPT.

Entonces, ¿por qué cada vez más empresas prohíben ChatGPT? Aquí hay 5 razones principales.

1. Fuga de datos

ChatGPT requiere una gran cantidad de datos para entrenarse y operar de manera efectiva. El chatbot ha sido entrenado utilizando grandes cantidades de datos obtenidos de Internet y seguirá entrenándose.

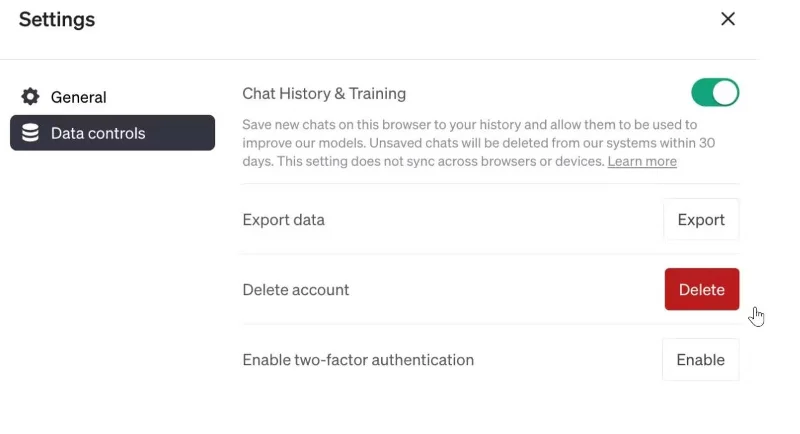

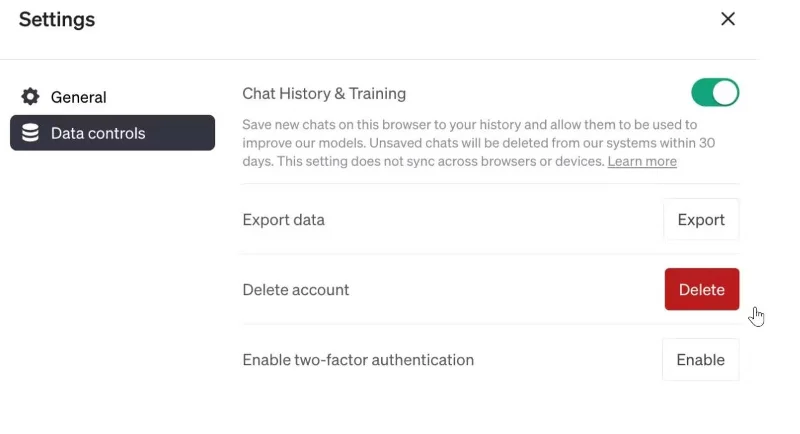

Según la página de ayuda de OpenAI, todos los datos, incluidos los detalles confidenciales del cliente, los secretos comerciales y la información comercial confidencial, que usted proporcione al chatbot se pueden revisar y utilizar para mejorar el sistema.

Configurar la autenticación multifactor en ChatGPT

Muchas empresas están sujetas a estrictas normas de protección de datos. Por lo tanto, son cautelosos a la hora de compartir datos personales con entidades externas, ya que esto aumenta el riesgo de fuga de datos.

Además, OpenAI no ofrece ninguna garantía de perfecta seguridad y protección de datos. En marzo de 2023, OpenAI confirmó un error que permitía a algunos usuarios ver los títulos de los chats en el historial de otros usuarios activos. Aunque este error se solucionó y OpenAI lanzó un programa de recompensas por errores, la empresa no garantiza la seguridad y privacidad de los datos del usuario.

Muchas organizaciones están optando por restringir el uso de ChatGPT por parte de sus empleados para evitar filtraciones de datos, que pueden dañar la reputación, provocar pérdidas financieras y poner en riesgo a sus clientes y empleados.

2. Riesgos de ciberseguridad

![5 razones por las que las empresas prohíben ChatGPT 5 razones por las que las empresas prohíben ChatGPT]()

Si bien no está claro si ChatGPT es realmente susceptible a los riesgos de ciberseguridad, es posible que su implementación dentro de una organización pueda crear vulnerabilidades potenciales que podrían ser aprovechadas por los ciberatacantes.

Si una empresa integra ChatGPT y hay una debilidad en el sistema de seguridad del chatbot, los atacantes pueden aprovechar la vulnerabilidad e infectarla con malware. Además, la capacidad de ChatGPT para generar respuestas similares a las humanas es un "huevo de oro" para los atacantes de phishing, que pueden apoderarse de cuentas o hacerse pasar por entidades legítimas para engañar a los empleados de la empresa para que compartan información confidencial.

3. Crea chatbots personalizados

![5 razones por las que las empresas prohíben ChatGPT 5 razones por las que las empresas prohíben ChatGPT]()

A pesar de sus funciones innovadoras, ChatGPT puede generar información falsa y engañosa. Por lo tanto, muchas empresas han creado chatbots de IA con fines laborales. Por ejemplo, el Commonwealth Bank de Australia pidió a su personal que utilizara Gen.ai, un chatbot de inteligencia artificial (IA) que utiliza información de CommBank para proporcionar respuestas.

Empresas como Samsung y Amazon han desarrollado modelos avanzados de lenguaje natural, para que las empresas puedan crear e implementar fácilmente chatbots personalizados basados en transcripciones existentes. Con estos chatbots internos, puede evitar consecuencias legales y de reputación asociadas con el mal manejo de datos.

4. Falta de regulaciones

En industrias donde las empresas están sujetas a protocolos y sanciones, la falta de orientación regulatoria de ChatGPT es una señal de alerta. Sin condiciones legales precisas que regulen el uso de ChatGPT, las empresas podrían enfrentar graves consecuencias legales al utilizar chatbots de IA para sus operaciones.

Además, la falta de regulación puede reducir la responsabilidad y la transparencia corporativas. Puede resultar confuso para la mayoría de las empresas explicar a sus clientes los procesos de toma de decisiones y las medidas de seguridad del modelo de lenguaje de IA.

Las empresas están restringiendo ChatGPT debido a preocupaciones sobre la posibilidad de violar las leyes de privacidad y las regulaciones específicas de la industria.

5. Uso irresponsable por parte de los empleados

![5 razones por las que las empresas prohíben ChatGPT 5 razones por las que las empresas prohíben ChatGPT]()

En muchas empresas, algunos empleados dependen únicamente de las respuestas de ChatGPT para crear contenido y realizar sus tareas. Esto crea pereza en el entorno laboral y sofoca la creatividad y la innovación.

Depender de la IA puede obstaculizar su capacidad de pensar críticamente. También puede dañar la reputación de una empresa porque ChatGPT a menudo proporciona datos inexactos y poco fiables.

Si bien ChatGPT es una herramienta poderosa, utilizarla para resolver consultas complejas que requieren experiencia en un dominio específico puede perjudicar las operaciones y la eficiencia de una empresa. Es posible que algunos empleados no recuerden verificar los hechos y verificar las respuestas proporcionadas por los chatbots de IA, considerando las proporcionadas por ChatGPT como una solución única para todos.

Para mitigar problemas como estos, las empresas están prohibiendo los chatbots para que los empleados puedan concentrarse en sus tareas y brindar soluciones sin errores a los usuarios.