Quizás hayas oído hablar de FaceApp, una aplicación móvil de edición de fotografías que está recibiendo gran atención en todo el mundo por su capacidad de aplicar inteligencia artificial (IA) para editar selfies con un grado de autenticidad extremadamente alto. O This Person Does Not Exist, otra aplicación de edición de fotografías que puede crear retratos interesantes basados en personajes gráficos ficticios generados por computadora. Estas son sólo dos de las muchas aplicaciones geniales con presencia de IA en tareas relacionadas con la edición y creación de fotografías. Entonces, ¿qué pasa con la edición de vídeo?

Recientemente, DeepMind, una filial de Alphabet que opera principalmente en el campo del desarrollo de inteligencia artificial, anunció un invento completamente nuevo llamado "Generación de video eficiente en conjuntos de datos complejos" (video basado efectivamente en conjuntos de datos complejos), promete traer muchos cambios en el campo de la edición y postproducción de vídeo en el futuro. Se trata básicamente de un algoritmo de IA que puede aprender a crear clips simples a partir de los vídeos a los que ha estado expuesto durante el proceso de formación.

DVD-GAN ahora puede generar automáticamente videos de muestra con diseños de objetos completos

DVD-GAN ahora puede generar automáticamente videos de muestra con diseños de objetos completos

Los investigadores de DeepMind afirmaron que su modelo con mejor rendimiento hasta la fecha, el Discriminador de Vídeo Dual GAN (DVD-GAN), era capaz de crear vídeos con una resolución de 256 x 256 píxeles, combinados con una alta resolución. La fidelidad es encomiable y la duración aumenta. a 48 fotogramas.

“Crear vídeos con un alto nivel de naturalidad y realismo es el mayor desafío para los modelos de IA actuales. Entre ellos, los obstáculos más importantes no son otros que la complejidad de los requisitos de recopilación y cálculo de datos. Por esta razón, muchos trabajos relacionados con la creación de videos en el pasado a menudo giraban en torno a conjuntos de datos relativamente simples o tareas en las que había información disponible en tiempo real. Actualmente, nos centramos en tareas de síntesis y predicción de vídeo, y nuestro objetivo es extender los resultados de los principales modelos de IA de creación de imágenes actuales al vídeo, mucho mejor en el lado complejo”, dijo un representante del equipo de investigación.

El equipo construyó su sistema en torno a una arquitectura de inteligencia artificial avanzada, al mismo tiempo que introdujo una serie de ajustes específicos de video, lo que permitió que el proceso de capacitación se lleve a cabo en base a Kinetic-600, un conjunto de datos que incluye videos "naturales", que son mucho más grandes en escala de lo habitual. Específicamente, los investigadores han aprovechado las redes generativas adversarias (GAN).

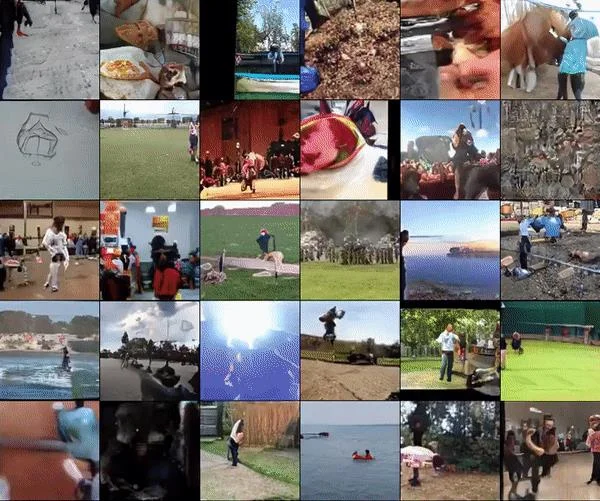

![El modelo de IA de DeepMind puede aprender a crear vídeos con solo mirar clips de YouTube El modelo de IA de DeepMind puede aprender a crear vídeos con solo mirar clips de YouTube]() Un conjunto de videoclips sintéticos de 4 segundos entrenados en 12 fotogramas de 128 × 128 de Kinetic-600.

Un conjunto de videoclips sintéticos de 4 segundos entrenados en 12 fotogramas de 128 × 128 de Kinetic-600.

Si no lo sabes, GAN es un sistema de IA que consta de dos partes separadas: la primera es una red generativa, que ayuda a crear muestras de entrenamiento (datos falsos), con el objetivo de crear el parecido más realista. . Y la segunda es la red Discriminativa: que intenta distinguir entre datos reales y datos falsos. Los sistemas GAN se han aplicado en muchas tareas intensivas, como convertir subtítulos en historias contextuales, especialmente en la creación de fotografías artificiales con un realismo extremadamente alto.

DVD-GAN contiene redes discriminativas duales: el algoritmo discriminativo puede revelar diferencias en el contenido y la estructura de un solo cuadro al muestrear aleatoriamente cuadros de resolución completa y luego procesarlos. Procesarlos individualmente y diferenciarlos a lo largo del tiempo proporciona señales de aprendizaje para generar movimiento. Un único módulo, denominado Transformer, permite la distribución de datos e información aprendidos en todo el modelo de IA.

En cuanto al corpus de entrenamiento Kinetic-600, se trata esencialmente de un conjunto de datos gigante, compilado a partir de más de 500.000 clips de YouTube de alta resolución con una duración de no más de 10 segundos. Estos videos fueron seleccionados inicialmente para reconocer acciones humanas, y los investigadores describieron este corpus como “diverso” y “sin restricciones”, factores que son particularmente relevantes en el entrenamiento de modelos abiertos similares al DVD-GAN de DeepMind. (En el campo del aprendizaje automático, existe un término "sobreajuste", que se utiliza para referirse a modelos que se ajustan demasiado a un conjunto particular de datos y, como resultado, no logran predecir las observaciones en el futuro de manera confiable) .

Según el informe del equipo de investigación, después de haber sido entrenado continuamente por el sistema Tensor Processing Units de tercera generación de Google durante un período de 12 a 96 horas, DVD-GAN ahora es capaz de generar videos por sí solo. El modelo posee diseños completos de objetos, movimientos y incluso estructuras complejas como reflejos en la superficie de los ríos, pistas de hielo... DVD-GAN ha tenido que "luchar" para crear objetos complejos en este ámbito de mayor resolución, donde el movimiento implica un número mucho mayor de píxeles. Sin embargo, los investigadores notaron que, después de ser evaluadas en UCF-101 (un conjunto de datos más pequeño de 13,320 videos de acciones humanas), las muestras de video generadas por DVD-GAN obtuvieron una buena puntuación: la puntuación inicial es 32,97, nada mal.

![El modelo de IA de DeepMind puede aprender a crear vídeos con solo mirar clips de YouTube El modelo de IA de DeepMind puede aprender a crear vídeos con solo mirar clips de YouTube]() La muestra de video que creó DVD-GAN logró una puntuación inicial de 32,97

La muestra de video que creó DVD-GAN logró una puntuación inicial de 32,97

“En el futuro, queremos enfatizar aún más los beneficios de entrenar modelos generativos en conjuntos de datos de video grandes y complejos, como Kinetic-600. Aunque todavía queda mucho trabajo por hacer antes de que se puedan generar videos realistas de manera consistente en una gama ilimitada de configuraciones, creemos que DVD-GAN es el trampolín perfecto para hacer realidad este sueño”, dijo un representante de la equipo de investigación.

¿Qué piensas sobre el modelo DVD-GAN AI de DeepMind? ¡Por favor deje sus comentarios abajo!

DVD-GAN ahora puede generar automáticamente videos de muestra con diseños de objetos completos

DVD-GAN ahora puede generar automáticamente videos de muestra con diseños de objetos completos Un conjunto de videoclips sintéticos de 4 segundos entrenados en 12 fotogramas de 128 × 128 de Kinetic-600.

Un conjunto de videoclips sintéticos de 4 segundos entrenados en 12 fotogramas de 128 × 128 de Kinetic-600. La muestra de video que creó DVD-GAN logró una puntuación inicial de 32,97

La muestra de video que creó DVD-GAN logró una puntuación inicial de 32,97